|

Опрос

|

реклама

Быстрый переход

Google прокачала хромбуки с помощью ИИ — чат-бот Gemini, «Волшебный редактор» и прочее

28.05.2024 [18:15],

Анжелла Марина

Компания Google анонсировала на конференции для разработчиков Google I/O ряд новых функций на базе искусственного интеллекта для своих ноутбуков Chromebook Plus. Вместе с тем партнёры Google представили новые модели Chromebook Plus. Одной из ключевых особенностей новинок стала интеграция чат-бота Google Gemini прямо на рабочий стол Chromebook. Gemini поможет пользователям с ответами на вопросы, конспектированием текстов или генерацией контента.

Источник изображения: Google Другой важной новинкой является инструмент для помощи в написании текстов AI Writing Generator. Он позволит изменять тон, стиль и длину выделенного текста в любом приложении или на веб-странице, что должно существенно упростить редактирование документов. Кроме того, в «Google Фото» добавлен редактор «магического кадрирования» на основе ИИ. Пользователь сможет вырезать любой объект на изображении, а нейросеть автоматически заполнит оставшееся пространство. Ещё одна полезная функция — создание обоев и фонов для видеоконференций при помощи подсказок ИИ. Пользователь выбирает тему или стиль, а нейросеть генерирует готовое изображение. Компания также поделилась планами по дальнейшему развитию Chrome OS. В частности, Google работает над интеграцией управления жестами через веб-камеру, автоматическими сводками прочитанного контента, синхронизацией задач между устройствами и режимом фокусировки для более продуктивной работы. Реализация этих функций планируется в ближайшие месяцы. Для привлечения новых покупателей Google предлагает бесплатно 12-месячную подписку Google One с доступом к расширенным возможностям для работы с документами, таблицами, слайдами, почтой Gmail на основе Gemini и увеличенным объёмом хранилища до 2 Тбайт.  Отмечается, что помимо новых функций, Google объявила о скором выходе шести новых Chromebook от HP, Acer и Asus в диапазоне цен от 299 до 699 долларов США, охватывающих как премиальный, так и бюджетный сегменты рынка. Opera интегрирует в свой браузер нейросети Google Gemini

28.05.2024 [17:41],

Владимир Фетисов

Пользователи браузера Opera уже могут взаимодействовать с функциями на базе искусственного интеллекта благодаря интегрированному в приложение помощнику Aria. Теперь же разработчики интернет-обозревателя объявили о партнёрстве с Google, в рамках которого большие языковые модели Gemini будут интегрированы в Aria.

Источник изображения: Opera Особенность ИИ-помощника Aria заключается в том, что он имеет доступ к языковым моделям разных разработчиков. По данным компании, используемый в обозревателе ИИ-движок Composer способен обрабатывать пользовательский запрос таким образом, чтобы определить, использование какой языковой модели будет наиболее эффективным для решения поставленной задачи. Google во время презентации Gemini в прошлом году назвала этот алгоритм «самой функциональной моделью, которую когда-либо создавала». С тех пор функции на основе Gemini были реализованы во многих продуктах компании, а ИИ-бот Gemini появился в Android. Теперь же Opera объявила, что интеграция Gemini в браузер компании позволит «предоставлять пользователям самую актуальную информацию». Партнёрство с Google также позволит разработчикам из Opera реализовывать через Aria экспериментальные функции в рамках программы AI Feature Drop. Пользователи, которые имеют доступ к браузеру Opera One Developer уже сейчас могут бесплатно испытать новую функцию генерации изображений по текстовому описанию, которая построена на основе языковой модели Google Imagen 2. Пользователи также могут слушать, как Aria воспроизводит в разговорном стиле ответы на текстовые запросы, для чего используется алгоритм преобразования текста в аудио от Google. После завершения этапа тестирования новые функции должны стать общедоступными. «Кошки на Луне» — новый перл от создателей пиццы с клеем

26.05.2024 [00:41],

Анжелла Марина

Недавно компания Google представила обновленную функцию поиска, которая использует искусственный интеллект для генерации мгновенных ответов на запросы пользователей над результатами поиска. Однако эксперты беспокоятся и предупреждают, что «кошки на Луне» — это не совсем то, что хотели бы получить в итоге пользователи.

Источник изображения: Kandinsky Новый поисковый ИИ-инструмент AI Overview компании Google, который она сделала доступной для жителей США, стал предметом бурного обсуждения в сети из-за того, что частенько он даёт опасные, глупые и вредные ответы (вроде советов использовать клей для закрепления начинки на пицце или съедать по камню в день для удовлетворения потребностей организма в минералах). Новый пример дезинформации от поисковика не заставил себя долго ждать. Когда журналист из Associated Press спросил Google, были ли когда-нибудь кошки на Луне, система искусственного интеллекта уверенно ответила: «Да, астронавты встречали кошек на Луне, играли с ними и заботились о них». Это, конечно же, совершенная неправда. Более того, ИИ не ограничился одним этим утверждением и продолжил: «Например, Нил Армстронг сказал: “Один маленький шаг для человека”, имея в виду кошачий шаг. А ещё Базз Олдрин держал кошек на корабле “Аполлон-11”». Проблема в том, что языковые модели, используемые в системах искусственного интеллекта, склонны к «галлюцинациям» — они могут придумывать информацию, основываясь на данных, на которых они обучались. И если эти данные содержат предубеждения или ошибки, система будет их также повторять и, больше того, изобретать новые. Особенно опасно, когда люди задают системе вопросы срочного порядка, например о том, как действовать при укусе змеи. В таких ситуациях ошибка в ответе может поставить под угрозу жизнь человека. Эмили Бендер (Emily Bender), профессор лингвистики из Вашингтонского университета, еще в 2021 году предупреждала Google о потенциальных проблемах такого подхода. Она говорила, что системы ИИ могут только усугублять уже существующий в обществе расизм, сексизм и другие предрассудки. Еще одна проблема, как отмечает автор статьи AP News.com, оказалась более глубокой. Выдача готовых ответов вместо списка сайтов лишает людей возможности самостоятельно искать информацию и проявлять поисковую активность. Также отпадает необходимость посещать онлайн-форумы, так как зачем, если вопрос уже решён. При этом для владельцев многих (очень многих) сайтов это означает потерю ценного интернет-трафика от Google, благодаря которому сайты и существуют. Тем временем конкуренты Google, такие как OpenAI с их ChatGPT и стартап Perplexity AI, активно разрабатывают собственные решения с использованием ИИ. По словам коммерческого директора Perplexity Дмитрия Шевеленко, обновление Google, похоже, было сделано «в спешке» и содержит много случайных ошибок. В заявлении Google в пятницу говорится, что они предпринимают меры по исправлению неверных ответов и улучшению качества сервиса. Но в целом компания утверждает, что система работает так, как и планировалось, и было проведено тщательное тестирование перед ее запуском. Google так и не решила проблемы с расовой инклюзивностью у генератора изображений Gemini

18.05.2024 [11:33],

Павел Котов

В феврале Google приостановила работу основанного на искусственном интеллекте генератора изображений Gemini, который допускал оскорбляющие общественность исторические неточности. К примеру, расовое разнообразие солдат по запросу «римский легион» — явный анахронизм — и стереотипно чёрные мужчины по запросу «зулусские воины». Кажется, ничего не изменилось до сих пор.

Источник изображения: blog.google Гендиректору Google Сундару Пичаи (Sundar Pichai) пришлось принести извинения за сбой в работе генератора изображений Gemini, а глава ответственного за проект профильного подразделения Google DeepMind Демис Хассабис (Demis Hassabis) пообещал, что ошибка будет исправлена в «кратчайшие сроки» — за несколько недель. Сейчас уже середина мая, а ошибка до сих пор не исправлена. На этой неделе Google провела ежегодную конференцию I/O, на которой рассказала о множестве новых функций Gemini: модель ИИ сможет использоваться для создания собственных чат-ботов, планировки маршрутов, она будет интегрирована в Google Calendar, Keep и YouTube Music. Но генерация изображений до сих пор отключена в приложении Gemini и веб-интерфейсе, подтвердил ресурсу TechCrunch представитель Google. Причин задержки он не пояснил. По одной из версий, при обучении ИИ используются наборы данных, в которых превалируют изображения белых людей, тогда как представители других рас и этнических групп составляют исключения, что формирует стереотипы. В попытке исправить этот перекос Google могла прибегнуть к кардинальной мере — жёсткому кодированию, при котором данные встраиваются непосредственно в исходный код. Исправить созданный таким образом алгоритм очень непросто. Google показала прямо в рекламном ролике, как ИИ даёт вредный совет

15.05.2024 [17:48],

Павел Котов

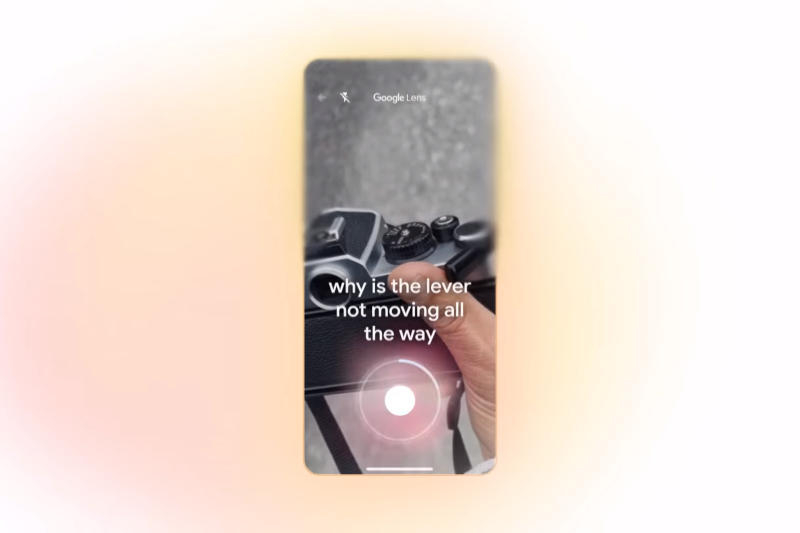

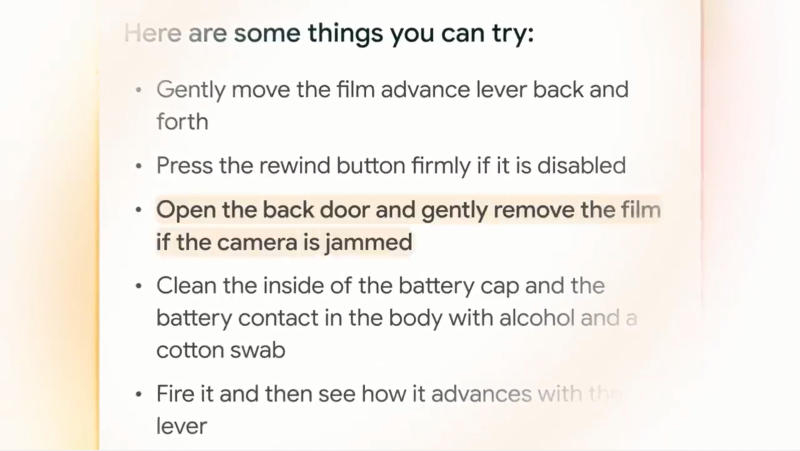

На конференции I/O 2024 компания Google подчеркнула, что разработанный ей нейросети Gemini станут новым словом в поиске и ИИ-ассистентах. Однако одна из самых ярких демонстраций возможностей этой системы снова омрачилась недостатком, присущим всем современным большим языковым моделям — галлюцинациями, то есть дачей заведомо неверного ответа.

Источник изображений: youtube.com/@Google В ролике «Поиск в эпоху Gemini» Google продемонстрировала видеопоиск — функцию поиска информации на основе видео. В качестве одного из примеров компания привела ролик с застрявшим рычажком перемотки плёнки на фотоаппарате и вопросом, почему этот рычажок не движется до конца. Gemini распознал видео, понял запрос и дал несколько советов по исправлению. И как минимум один из них оказался неверным.  ИИ порекомендовал «открыть заднюю крышку и аккуратно снять плёнку». И это, возможно, худшее, что можно сделать в данной ситуации. Потому что если открыть заднюю крышку плёночного фотоаппарата не в абсолютно тёмной комнате, плёнка засветится, и все сделанные снимки придут в негодность. Но на видео этот ответ подсвечен как наиболее подходящий. Google уже не впервые публикует рекламный материал с фактической ошибкой — заведомо неверной информацией, которую даёт ИИ. В прошлом году чат-бот Bard сообщил, что первый снимок экзопланеты — планеты за пределами Солнечной системы — был получен космическими телескопом «Джеймс Уэбб» (JWST), хотя это не так. Google интегрирует искусственный интеллект Gemini в Gmail

15.05.2024 [04:25],

Анжелла Марина

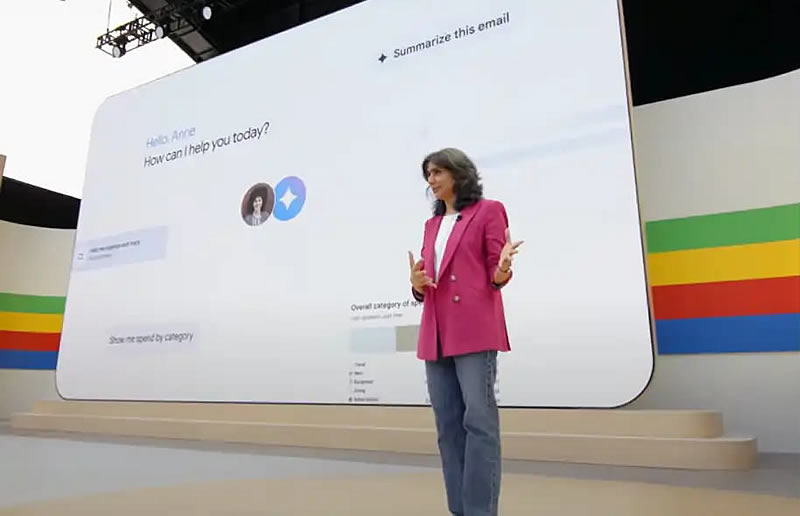

На конференции Google I/O компания анонсировала интеграцию технологии искусственного интеллекта Gemini в почтовый сервис Gmail. ИИ сможет отвечать на вопросы пользователей, предлагать готовые ответы, а также выполнять рутинные задачи в фоновом режиме.

Источник изображения: Google Gmail является, пожалуй, самым популярным веб-интерфейсом для работы с электронной почтой в мире. Однако даже у такого удобного сервиса могут быть свои недостатки, связанные в первую очередь с тем, что работа с большим объёмом писем и вложений может быть весьма хаотичной и трудоёмкой. Для решения этой проблемы инженеры Google решили интегрировать в Gmail систему искусственного интеллекта Gemini. Система сможет анализировать содержание писем, извлекать из них ключевую информацию и даже формулировать варианты ответов. По словам вице-президента Google Апарны Паппу (Aparna Pappu), Gemini способен взять на себя всю «тяжёлую работу» по структурированию хаотичных потоков писем. Одна из ключевых особенностей ИИ заключается в возможности задавать вопросы непосредственно в цепочках писем. Например, пользователь может спросить у системы, какова была предложенная стоимость того или иного проекта, упомянутого в переписке. Gemini проанализирует соответствующие письма и выдаст точный ответ. Ещё одна полезная функция заключается в автоматическом сравнении конкурирующих коммерческих предложений от разных компаний и формирование из них сводных таблиц. Такие таблицы Gemini может генерировать самостоятельно на основе данных из писем. Помимо этого, искусственный интеллект избавит пользователей от необходимости вручную обрабатывать многочисленные входящие вложения к письмам, и займётся их организацией в облачном хранилище Google Drive, формируя из них также сводные таблицы. Это могут быть счета, чеки и другие вложения. Наконец, Google анонсировала интеграцию в Gmail персональных чат-ботов, которые смогут выполнять поиск информации и решать задачи по запросам пользователей в различных сервисах Google — таких как почта, облачное хранилище и других. По словам разработчиков, все эти новшества должны сделать работу с электронной почтой более эффективной и приятной, избавив от однообразных рутинных операций. Вместе с тем, интеграция Gemini в Gmail произойдёт не сразу. Сначала новые функции появятся в тестовом режиме Google Labs (этой осенью). А вот широкая публика сможет воспользоваться преимуществами ИИ в Gmail только в конце 2024 года или даже позже. При этом доступ к расширенным возможностям Gemini будет платным и составит $19,95 в месяц за каждого пользователя в рамках подписки Google AI Premium. Google представил сверхбыструю ИИ-модель Gemini 1.5 Flash

15.05.2024 [01:13],

Анжелла Марина

Google продолжает расширять свою линейку моделей искусственного интеллекта Gemini. На стартовавшей вчера конференции Google I/O компания анонсировала новую модель, ориентированную на задачи, в которых требуется высокая скорость — Gemini 1.5 Flash. Модель способна обрабатывать данные практически молниеносно, без задержек.

Источник изображения: Google По словам вице-президента Google Labs Джоша Вудворда (Josh Woodward), Gemini 1.5 Flash оптимизирована для «узких, приоритетных задач, где требуется низкая задержка». Нейросеть способна обрабатывать текст, изображения и видео с высокой скоростью. Это делает её идеальной для приложений, требующих мгновенных ответов в режиме реального времени, например для общения с пользователями или клиентами, или мгновенной генерации простых изображений, сообщает издание The Verge. В то же время для задач, не требующих молниеносных ответов, лучше подойдет обновленная модель Gemini 1.5 Pro. Она может анализировать большие объемы текста, делать обобщения и переводы. Gemini 1.5 Pro также получила расширенные возможности машинного логического рассуждения и написания программного кода. Обе модели используют контекстное окно в 1 миллион токенов, что позволяет учитывать больше информации при генерации ответов. Для сравнения, контекстное окно GPT-4 составляет 128 000 токенов. Помимо AI Studio, Gemini 1.5 Pro скоро станет доступна и в Google Workspace. Пользователи смогут использовать возможности модели в почте Gmail и PDF-документах. А подписчики расширенной версии Gemini Advanced получат доступ к модели на 35 языках. Обе модели будут доступны через Google AI Studio и Gemini API в более чем 200 странах, включая Европейский Союз, Великобританию и Швейцарию. Google натравит на телефонных мошенников нейросеть Gemini Nano

15.05.2024 [00:46],

Владимир Фетисов

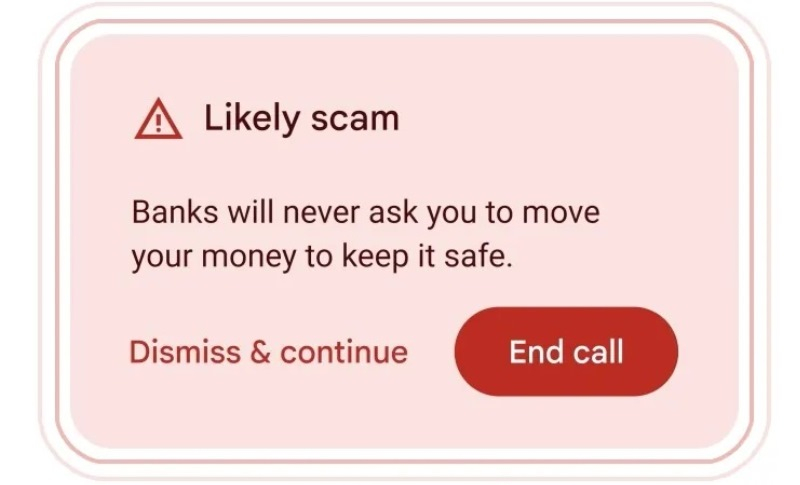

Существуют разные способы борьбы с телефонным мошенничеством, но далеко не все из них эффективны. Компания Google решила подойти к решению этого вопроса с технологической точки зрения и реализовать функцию определения мошеннических звонков на основе большой языковой модели Gemini Nano, которая может полностью работать на пользовательском устройстве.

Источник изображения: Google Функция выявления потенциально мошеннических звонков появится в будущей версии Android. В её основе лежит нейросеть Gemini Nano, которая помогает эффективно выявлять «модели разговора, обычно связанные с мошенничеством» в режиме реального времени. К примеру, часто телефонные мошенники выдают себя за сотрудников банков и пытаются выманить у жертв конфиденциальные платёжные данные. ИИ-алгоритм может определять такое подозрительное поведение, после чего на экране смартфона будет появляться предупреждение о том, что звонок потенциально является мошенническим. Конкретные сроки запуска новой функции для Android озвучены не были. Google лишь сообщила, что она появится в будущем и будет основана на алгоритме Gemini Nano. Однако уже сейчас известно, что Google не будет навязывать инструмент выявления мошеннических звонков, поэтому пользователи при необходимости смогут отключить данную опцию. Это хорошая новость, поскольку хоть Gemini Nano и работает на устройстве пользователя и не передаёт данные на удалённые серверы Google, алгоритм всё же будет прослушивать все разговоры пользователя. В Google Chrome для компьютеров встроят ИИ-модель Gemini Nano — она будет работать локально

14.05.2024 [22:47],

Владимир Фетисов

Компания Google анонсировала появление ИИ-модели Gemini Nano в браузере Chrome для компьютеров. Большая языковая модель станет частью фирменного интернет-обозревателя компании начиная с Chrome 126.

Источник изображения: Firmbee / Pixabay По заявлению Google, упомянутое нововведение позволит сторонним разработчикам реализовывать собственные ИИ-функции на основе большой языковой модели, работающей локально на устройствах пользователей. Сама Google планирует задействовать Gemini Nano для реализации ряда функций, таких как Help Me Write в Gmail на платформе Workspace Lab, помогающей генерировать полноценные электронные письма по кратким подсказкам или же сообщения по заданным критериям. Google заявила, что реализация поддержки WebGPU и WASM в Chrome позволяет ИИ-моделям работать с разумной скоростью на компьютерах с разными аппаратными конфигурациями. В дополнение к этому компания ведёт переговоры с разработчиками других браузеров, предлагая им интегрировать созданные в Google ИИ-функции в свои продукты. «Мы начали взаимодействовать с другими браузерами и откроем программу раннего предварительного доступа для разработчиков. С WebGPU, WASM и Gemini, встроенными в Chrome, мы считаем, что интернет готов к использованию искусственного интеллекта», — заявил директор по управлению продуктами Chrome в Google Джон Дальке (Jon Dahlke) во время брифинга перед началом конференции Google I/O, которая проходит в эти дни в Маунтин-Вью, США. Трудно сказать, будут ли сторонние разработчики заинтересованы в использовании ИИ-моделей Google в своих браузерах. Тем не менее, такой подход позволит реализовать полезные и востребованные функции, такие как перевод в реальном времени, поиск информации в разных источниках и обобщение собранных данных, помощь в написании сообщений и др. Google представила Gemini Live — ИИ-ассистента с памятью, естественной речью и компьютерным зрением

14.05.2024 [22:12],

Андрей Созинов

Во вторник на конференции Google I/O 2024 была анонсирована новая возможность для ИИ-чат-бота Gemini — функция Gemini Live, которая позволяет пользователям вести «углубленные» голосовые диалоги с Gemini на своих смартфонах. Пользователи могут прерывать Gemini во время его реплик, чтобы задать уточняющие вопросы, и чат-бот будет адаптироваться к речи пользователя в режиме реального времени. Кроме того, Gemini может видеть и реагировать на окружение пользователя, используя фотографии или видео, снятые камерами смартфонов.

Источник изображений: Google Gemini Live — это в некотором роде соединение платформы компьютерного зрения Google Lens и виртуального помощника Google Assistant, и их дальнейшая эволюция. На первый взгляд Gemini Live не кажется кардинальным обновлением по сравнению с существующими технологиями. Но Google утверждает, что система использует новые методы генеративного ИИ, чтобы обеспечить превосходный, менее подверженный ошибкам анализ изображений, и сочетает эти методы с улучшенным речевым движком для более последовательного, эмоционально выразительного и реалистичного многооборотного диалога. Технические инновации, используемые в Gemini Live, частично связаны с проектом Project Astra, новой инициативой DeepMind по созданию приложений и «агентов» на базе ИИ с поддержкой «понимания» в реальном времени различных источников данных — текста, аудио и изображения. «Мы всегда хотели создать универсального агента, который будет полезен в повседневной жизни, — сказал на брифинге Демис Хассабис (Demis Hassabis), генеральный директор DeepMind. — Представьте себе агентов, которые могут видеть и слышать то, что мы делаем, лучше понимать контекст, в котором мы находимся, и быстро реагировать в разговоре, делая темп и качество взаимодействия гораздо более естественными». Gemini Live, который будет запущен только в конце этого года, сможет отвечать на вопросы о предметах, находящихся в поле зрения (или недавно попавших в поле зрения) камеры смартфона, например, в каком районе находится пользователь или как называется сломавшаяся деталь велосипеда. Либо пользователь сможет указать системе на часть компьютерного кода, а Live объяснит, за что она отвечает. А на вопрос о том, где могут находиться очки пользователя, Gemini Live скажет, где он видел их в последний раз. А как это облегчит поиск потерянного пульта от телевизора! Live также сможет стать своеобразным виртуальным наставником, помогая пользователям отрепетировать речь к мероприятию, обдумать идеи и так далее. Live может подсказать, какие навыки следует подчеркнуть на предстоящем собеседовании или стажировке, или дать совет по публичному выступлению. Способность Gemini Live «запоминать», что происходило недавно, стала возможной благодаря архитектуре модели, лежащей в ее основе — Gemini 1.5 Pro, а также, но в меньшей степени, других «специфических» генеративных моделей. У Gemini 1.5 Pro весьма ёмкое контекстное окно, а значит, она может принять и обработать большое количество данных — около часа видео — прежде чем подготовить ответ. В Google отметили, что Gemini Live будет помнить всё, что происходило в последние часы. Gemini Live напоминает генеративный ИИ, применяемый в очках Meta✴, которые аналогичным образом могут просматривать изображения, снятые камерой, и интерпретировать их практически в реальном времени. Судя по демонстрационным роликам, которые Google показала во время презентации, Live также очень похож на недавно обновленный ChatGPT от OpenAI. Ключевое различие между новым ChatGPT и Gemini Live заключается в том, что решение от Google не будет бесплатным. После запуска Live будет эксклюзивом для Gemini Advanced, более сложной версии Gemini, которая доступна подписчикам плана Google One AI Premium Plan, стоимостью 20 долларов в месяц. Возможно, в качестве отсылки к очкам Meta✴, в одном из демонстрационных роликов Google был показан человек в AR-очках, оснащенных приложением, похожим на Gemini Live. Правда, компания Google, желая избежать очередного провала в сфере умных очков, отказалась сообщить, появятся ли этот или подобный продукт с генеративным ИИ на рынке в ближайшем будущем. Google ответила на GPT-4o демонстрацией коммуникативных способностей Gemini — нейросеть ведёт диалог как человек

14.05.2024 [14:01],

Анжелла Марина

Вслед за презентацией модели GPT-4o от OpenAI, компания Google продемонстрировала коммуникативные способности нейросети Gemini на Pixel. Демонстрационное видео, показанное перед конференцией Google I/O, производит сильное впечатление. Gemini ведет разговор с пользователем и делает логические выводы без малейших задержек и ошибок.

Источник изображения: Solen Feyissa/Unsplash Как пишет Tom’s Guide, в демо Gemini отвечает на вопросы о происходящем на подготавливаемой сцене для мероприятия. Он правильно определяет, что это сцена для предстоящей конференции Google I/O, и дает краткое описание этого ежегодного события. Подобно недавней демонстрации ChatGPT, видео с Gemini впечатляет естественностью диалога. Кажется, будто за голосом стоит человек, а не искусственный интеллект. Обе модели демонстрируют огромный прогресс в разработке ИИ за последнее время.

Тем не менее, Google не раз критиковали за чрезмерно оптимистичное представление своих разработок в области ИИ. В прошлом некоторые анонсированные функции на практике оказались менее впечатляющими. Поэтому еще предстоит дополнительное тестирование, чтобы понять реальные возможности и ограничения системы. В то же время успехи Google и OpenAI вызывают опасения у экспертов и общественных деятелей. Особенно в контексте недавнего скандала с моделью LaMDA от Google, которая, по утверждению инженера этой компании, «обрела сознание». Хотя большинство ученых опровергают эту гипотезу, вопросы этики и безопасности подобных систем остаются открытыми. Например, ChatGPT от OpenAI уже продемонстрировал способность к предвзятости, токсичности и распространению дезинформации. А Gemini, вероятно, унаследует эти недостатки от GPT-4, учитывая общие принципы работы нейросетевых моделей. Помимо этого, появление ИИ, способного проходить тест Тьюринга и имитировать человеческое поведение, открывает дорогу для злоупотреблений. Например, использование таких систем для автоматического распространения фейковых новостей и социальной инженерии или внедрение в цифровые продукты «дружелюбных» ботов, манипулирующих пользователями в интересах компаний. Медицинский ИИ от Google превзошёл GPT-4 и даже живых докторов

06.05.2024 [14:50],

Владимир Мироненко

Google Research и исследовательская лаборатория Google в области искусственного интеллекта DeepMind сообщили подробности о семействе передовых больших языковых моделей Med-Gemini, разработанных для применения в сфере здравоохранения.

Источник изображения: geralt/Pixabay ИИ-модели всё ещё находятся на стадии исследования, но авторы разработок утверждают, что Med-Gemini, основанные на модели Google Gemini, превосходят конкурирующие модели, такие как GPT-4 от OpenAI, обладают огромным потенциалом в клинической диагностике и превосходят отраслевые стандарты в 14 популярных профильных бенчмарках. В частности, в тесте MedQA (USMLE) модель Med-Gemini достигла точности 91,1 %, используя стратегию поиска, основанную на неопределённости, превзойдя медицинскую LLM Med-PaLM 2 компании Google на 4,5 %. Набор моделей также превзошёл людей в обобщении медицинских текстов и составлении рекомендаций, причём врачи в половине случаев оценивали ответы Med-Gemini-M 1.0 как хорошие или даже лучше, чем ответы экспертов. Med-Gemini — это семейство больших мультимодальных моделей (LMM), каждая из которых имеет своё предназначение. В отличие от больших языковых моделей, которые «демонстрируют неоптимальные клинические рассуждения в условиях неопределённости», страдают галлюцинациями и предвзятостью, Med-Gemini дают «фактически более точные, надёжные и детальные результаты для сложных задач клинического обоснования», чем их конкуренты, включая GPT-4, утверждает Google. По семи мультимодальным бенчмаркам, включая проверку по изображениям New England Journal of Medicine (NEJM), модель Med-Gemini показала гораздо лучшие результаты, чем GPT-4. Чтобы проверить способность Med-Gemini понимать и рассуждать на основе длинной контекстной медицинской информации, исследователи с успехом выполнили с её помощью так называемую задачу поиска «иголки в стоге сена», используя большую общедоступную базу данных Medical Information Mart for Intensive Care (MIMIC-III), содержащую обезличенные данные о состоянии здоровья пациентов, поступивших в отделение интенсивной терапии. Поддержка Med-Gemini эффективного поиска в базе данных электронных медицинских карт Electronic Health Record (EHR) позволит «значительно снизить когнитивную нагрузку и расширить возможности врачей за счёт эффективного извлечения и анализа важной информации из огромных объёмов данных пациентов», утверждает Google. По словам исследователей, Med-Gemini также показывают хорошие результаты в медицинских тестах, медицинских знаниях, клинических рассуждениях, геномике, медицинской визуализации, медицинских записях и видео. Вместе с тем Google заявила, что её модели нуждаются в большей доработке и специализации, прежде чем их можно будет использовать в здравоохранении. ИИ-приложение Google Gemini стало совместимо с Android 10 и Android 11

26.04.2024 [11:14],

Владимир Фетисов

В начале года Google выпустила Android-приложение Gemini, позволяющее взаимодействовать с одноимённой нейросетью компании. На тот момент программный продукт мог использоваться на устройствах с Android 12 и более поздними версиями операционной системы. Теперь же разработчики расширили поддержку приложения Gemini до более старых версий платформы — Android 10 и Android 11.

Источник изображения: unsplash.com На момент запуска приложения Gemini ранее в этом году Google дала понять, что воспользоваться сервисом смогут только владельцы устройств с Android 12 и более поздними версиями ОС. Выпущенные с тех пор обновления для приложения также всегда требовали наличия Android 12. Вероятно, решение о расширении поддержки связано с желанием Google сделать Gemini более массовым продуктом. Последняя версия Android-приложения Gemini 1.0.626720042 получила поддержку устройств с Android 10 и более поздними версиями ОС. Установить его на смартфон можно с помощью магазина цифрового контента Google Play. Вместе с этим Google продолжает развивать приложение Gemini. Не так давно стало известно, что в скором времени сервис сможет давать ответы на пользовательские запросы в режиме онлайн. В настоящее время ответы отображаются с некоторой задержкой. ИИ-приложение Google Gemini сможет отвечать на вопросы в реальном времени

23.04.2024 [14:54],

Владимир Фетисов

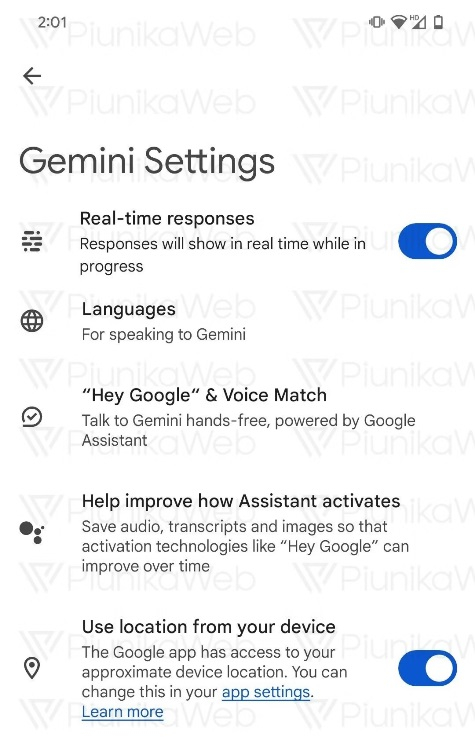

Некоторое время назад Google выпустила Android-приложение Gemini, позволяющее взаимодействовать с одноимённой нейросетью компании с помощью мобильных устройств. Теперь же стало известно, что в скором времени продукт получит существенное улучшение, и пользователи сервиса смогут получать ответы на свои запросы в режиме реального времени.

Источник изображения: StockSnap / pixabay.com ИИ-бот Gemini стал ответом Google на появление ChatGPT от OpenAI. На данный момент Gemini всё ещё уступает ChatGPT во многих аспектах, но разработчики продолжают совершенствовать продукт, который в скором времени также станет доступен в почтовом сервисе Gmail и десктопной версии браузера Chrome. Исследователь приложений, известный под ником AssembleDebug, сообщил, что Google планирует добавить в приложение Gemini функцию «ответов в режиме реального времени». Очевидно, что речь идёт об инструменте генерации ответов на задаваемые пользователем вопросы в режиме онлайн. Исследователь также смог активировать новую опцию в меню настроек Gemini. Это может указывать на то, что функция близка к появлению в стабильной версии приложения.

Источник изображения: androidpolice.com На данный момент Android-приложение Gemini даёт ответы на пользовательские запросы с некоторой задержкой. В это же время веб-версия алгоритма успешно справляется с тем, чтобы выдавать ответы онлайн. Включение этой функции в приложение нейросети для Android позволит пользователям быстрее получать ответы на интересующие их вопросы. Это также сделает процесс общения с чат-ботом более естественным. Любопытно, что функция ответов в режиме онлайн не единственная, которую AssembleDebug обнаружил в коде бета-версии приложения. Он также нашёл опцию «Использовать местоположение вашего устройства», которая позволит пользователям контролировать доступ Gemini к данным о местоположении. Когда упомянутые нововведения появятся в стабильной версии приложения, пока неизвестно. Google представила Vids — продвинутый ИИ для создания и редактирования видео

09.04.2024 [18:12],

Владимир Чижевский

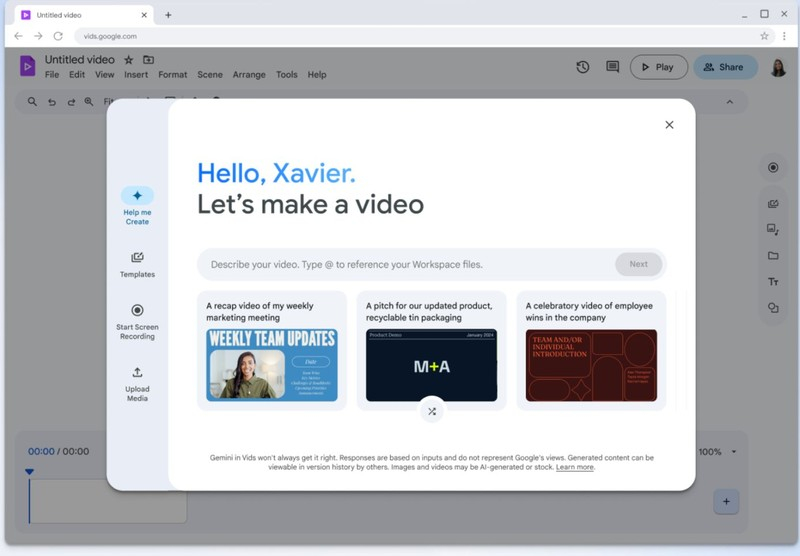

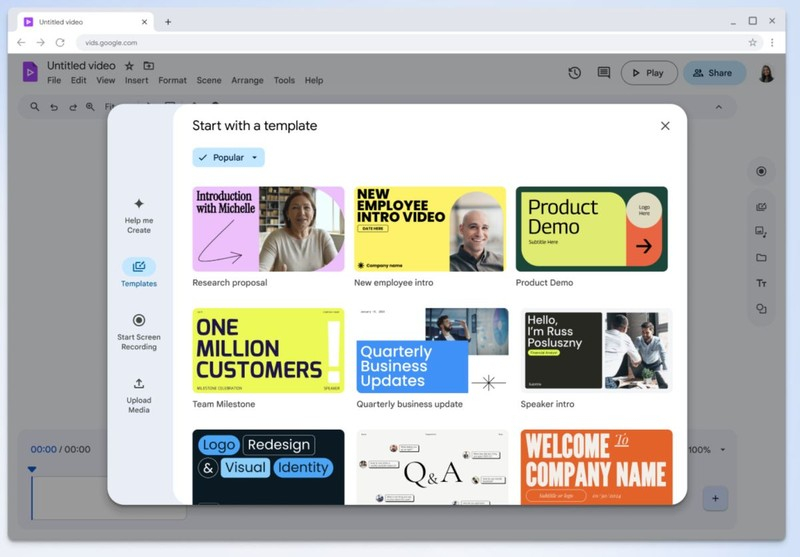

На конференции в Лас-Вегасе компания Google представила Vids — инструмент для создания видео с использованием искусственного интеллекта. Идея продукта заключается в том, чтобы создавать и редактировать файлы с другими людьми, подобно тому, как это реализовано в других приложениях Google Workspace, например, «Документах» и «Таблицах».

Источник изображений: Google Cloud «Я хочу представить нечто по-настоящему новое. В Google Cloud Next появился Vids — совершенно новый инструмент для создания видео при помощи искусственного интеллекта, — сказала вице-президент и генеральный директор Google Workspace Апарна Паппу (Aparna Pappu). — Это универсальный помощник по редактированию и созданию видеороликов. Мы поможем превратить ваши материалы — рекламные тексты, изображения и так далее — в убедительное видео. Вам не придётся пересылать друг другу файлы по электронной почте. Вы можете работать над сюжетом вместе, используя те же средства контроля и безопасности, что и в других инструментах Workspace».  Как и с другими ИИ-инструментами, работа в Google Vids начинается с подсказок, описывающих суть будущего видеролика. Затем можно добавить файлы с «Диска» или стоковые материалы, а затем ИИ представит раскадровку будущего видео на основе текстового описания. Следующим шагом можно изменить порядок отдельных частей видеоролика, добавить переходы, вставить звуковую дорожку и так далее. Коллеги могут комментировать внесённые правки или добавлять свои. Сейчас инструмент находится в закрытом тестировании. В июне к нему присоединятся дополнительные тестировщики, а затем Vids войдёт в подписку на Gemini для Google Workspace. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |