NVIDIA представила Chat with RTX для запуска ИИ-чат-ботов локально на ПК

NVIDIA выпустила предварительную версию приложения Chat with RTX, которое позволяет запускать локально на ПК чат-бота c генеративным ИИ на основе большой языковой модели (LLM). Чат-бот способен создавать сводки и выдавать релевантные ответы на основе видеороликов и документов пользователя. Chat with RTX работает на ПК под управлением Windows с видеокартами NVIDIA GeForce RTX 30-й или 40-й серии, оснащёнными как минимум 8 Гбайт видеопамяти.

Источник изображений: NVIDIA

Chat with RTX умеет обрабатывать видео YouTube — достаточно просто ввести URL-адрес, чтобы получить от чат-бота краткое содержание в текстовом виде. Chat with RTX позволяет выполнять поиск по расшифровке видео. По отзывам экспертов, поиск в видеороликах занимает считанные секунды. При этом отмечены случаи, когда чат-бот по непонятной причине использовал для поиска содержание другого ролика вместо запрошенного. Это явно указывает на ошибки ранней демоверсии.

Исследователи находят Chat with RTX полезным при обработке PDF-файлов. Утверждается, что чат-бот от NVIDIA в этой задаче проявил себя лучше, чем Microsoft Copilot, без проблем извлекая ключевую информацию. Эксперты также отметили, что Chat with RTX даёт ответ практически мгновенно, без задержек, которые обычно наблюдаются при использовании облачных чат-ботов ChatGPT или Copilot. При помощи чат-бота тестировщикам удалось создать релевантный набор данных по судебному делу «FTC против Microsoft» и обобщить всю стратегию Microsoft в отношении Xbox Game Pass.

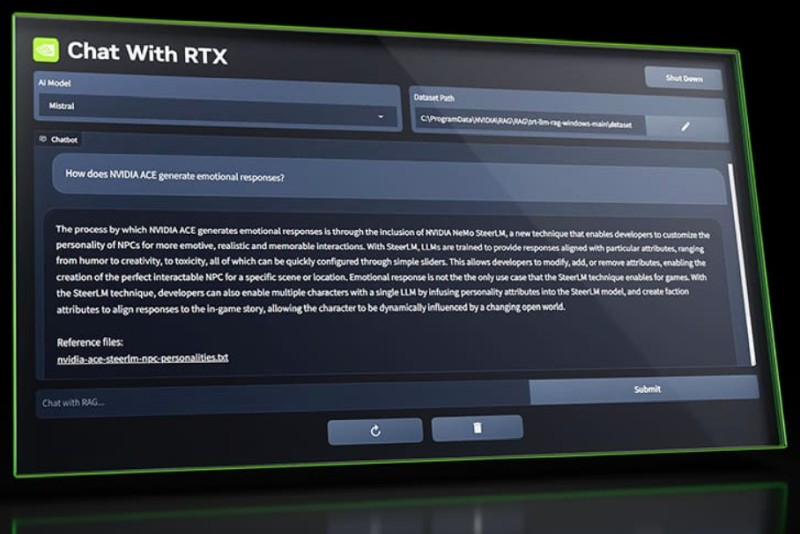

При инсталляции Chat with RTX на ПК пользователя устанавливается веб-сервер и экземпляр Python, который использует LLM Mistral или Llama 2. Тензорные ядра на графическом процессоре NVIDIA RTX применяются для ускорения обработки запросов. Установка Chat with RTX на ПК с процессором Intel Core i9-14900K и видеокартой NVIDIA GeForce RTX 4090 продолжается около 30 минут. На диске приложение занимает около 40 Гбайт, а интерпретатор Python при работе потребляет около 3 Гбайт ОЗУ. После запуска пользователь получает доступ к чат-боту через веб-интерфейс, а в командной строке отображается ход выполнения и коды ошибок.

Эксперты отмечают, что Chat with RTX пока больше всего напоминает раннюю демоверсию для разработчиков и компьютерных энтузиастов. Существует целый ряд известных проблем и ограничений. Попытка проиндексировать с помощью Chat with RTX папку с 25 000 документов привела к сбою приложения, потребовавшему сброса всех настроек для восстановления работоспособности. Кроме того, чат-бот создал файлы JSON внутри всех папок, которые индексировал, что не всегда уместно. Chat with RTX также не запоминает контекст, поэтому новый запрос не может опираться на содержание предыдущего.

Тем не менее, Chat with RTX — это хорошая техническая демонстрация возможностей и перспектив локально установленного на компьютере пользователя чат-бота с ИИ. Найдётся достаточно людей, которые не хотят для анализа личных данных использовать подписные облачные службы ИИ, такие как Copilot Pro или ChatGPT Plus.