|

Опрос

|

реклама

Быстрый переход

OpenAI представила Sora 2 — ИИ-генератор видео с реалистичной физикой и логикой, а также возможностью встроить в ролик самого себя

30.09.2025 [21:35],

Андрей Созинов

OpenAI анонсировала Sora 2 — флагманскую ИИ-модель для генерации видео и аудио, которую в компании позиционируют как огромный качественный скачок по сравнению с оригинальной Sora и сравнивают с GPT-3.5, ставшей революционной для генерации текста. Разработчики отмечают, что новая модель приближает ИИ-симуляцию мира к уровню, когда искусственный интеллект начинает «понимать» физику и динамику объектов почти так же, как человек.

Источник изображения: OpenAI Если ранние модели для генерации видео часто создавали правдоподобную «картинку», но не справлялись с элементарной логикой движений — например, могли «телепортировать» баскетбольный мяч в корзину при промахе, то Sora 2 моделирует именно поведение объектов. Промах — значит, мяч отскочит от щита. Фигурист, делающий тройной аксель, может ошибиться и упасть. Система научилась имитировать не только успех, но и провал — ключевое требование для создания реальных симуляторов мира и продвинутых роботов. Разработчики обещают, что теперь не будет странных деформаций объектов и нарушений логики сцены в угоду соблюдению промпта. Контролируемость — ещё один акцент, отмечаемый OpenAI. Модель Sora 2 уверенно справляется со сложными многошаговыми сценами, удерживая непротиворечивое состояние объектов, локаций и света. В качестве примера приводятся ролики, где фигуристка выполняет сложную программу из нескольких элементов с котом на голове, или где герой аниме вовлечён в зрелищную битву. Всё это — с сохранением целостности мира, связности кадров и даже эмоций на лицах персонажей. Sora 2 умеет работать с несколькими стилями: реалистичным, кинематографичным и аниме. Как универсальная система генерации видео и аудио, Sora 2 способна создавать сложные фоновые звуковые ландшафты, речь и звуковые эффекты с высокой степенью реалистичности. Для этого достаточно короткой видеозаписи: модель точно воспроизведёт внешность, мимику и даже голос, органично интегрируя их в любую сцену. Эта возможность универсальна и работает для любого человека, животного или объекта, отмечает пресс-релиз OpenAI. Одновременно с выпуском Sora 2 компания OpenAI запускает социальное iOS-приложение Sora. В нём пользователи смогут генерировать ролики и делиться ими с друзьями, а также делать ремиксы на работы друг друга, находить новые видео в настраиваемой ленте Sora и добавлять себя или своих друзей с помощью функции «камео». С помощью «камео» можно попасть в любую сцену Sora с поразительной точностью — нужно только через само приложение записать короткое видео с собой и свой голос для подтверждения личности и захвата образа. «На прошлой неделе мы запустили приложение внутри OpenAI. Наши коллеги уже сообщили нам, что благодаря этой функции они завели новых друзей в компании. Мы считаем, что социальное приложение, построенное вокруг функции “камео”, — лучший способ ощутить всю магию Sora 2», — отметила OpenAI в пресс-релизе. OpenAI подчеркнула, что этическое и ответственное использование станет важной частью новой платформы. Пользователь сам будет решать, кто и как может использовать его «камео»; любое видео с участием пользователя можно удалить в любой момент. Контент с откровенно вредным содержанием или созданный без согласия людей блокируется на уровне алгоритмов и модераторов. Приложение Sora уже доступно для скачивания пользователям iPhone в США и Канаде, регистрация проходит через систему приглашений. Через несколько недель Sora 2 станет доступна в веб-версии. Базовая версия бесплатна и имеет «щедрые лимиты», а подписчики ChatGPT Pro вскоре получат доступ к экспериментальной модели Sora 2 Pro с повышенным качеством. Монетизация пока туманна: единственный план — брать деньги за дополнительные генерации при высоком спросе. Расширение географии сервиса и открытие доступа через API входят в планы на ближайшее время. Nothing продолжает нейрофикацию — запущен ИИ-генератор мини-приложений по текстовым описаниям

30.09.2025 [17:30],

Павел Котов

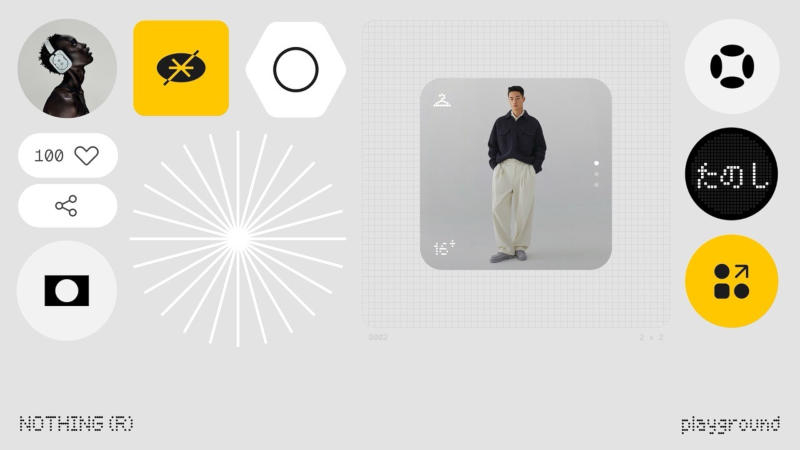

Разработка приложений с использованием искусственного интеллекта становится всё более популярной, и в Nothing, видимо, решили сыграть на модной тенденции. Накануне компания представила Playground — основанное на ИИ средство разработки мини-приложений с помощью простых текстовых запросов с последующим развёртыванием этих приложений на платформе Essential Apps.

Источник изображений: nothing.community Пока Playground позволяет создавать с нуля лишь виджеты — например, трекер рейсов, показ времени предстоящей встречи или виртуального питомца; можно адаптировать существующие приложения Essential Apps под свои нужды. Имеющим подготовку пользователям доступно редактирование кода. Полноэкранные приложения создавать пока не получится, отметили в Nothing, потому что технология развита недостаточно. В недавнем интервью глава компании Карл Пей (Carl Pei) посетовал, что мобильное ПО развивается не очень быстро, а в Nothing уже хотят заняться разработкой устройств с ИИ и ПО для них. «Меня всегда беспокоило, почему мы не улучшаем ПО? Многие смотрят на то, что делают крупные компании вроде Apple и следуют их примеру, потому что так безопаснее. Мне кажется, обновление ПО происходит медленно. Мы считаем, что с прорывом в области ИИ операционные системы изменятся и станут более персонализированными. В наших устройствах очень много контекста, но сейчас мы им не пользуемся», — заявил он.  Nothing уже приобрела некоторую известность на рынке смартфонов, но по масштабам она пока уступает таким гигантам как Google, Huawei, Oppo, Xiaomi, OnePlus, Apple и Samsung, довольствуясь долей менее 1 % по версии IDC. Пэй находит позицию своей компании выгодной: Nothing хочет заняться устройствами, предназначенными для работы с ИИ, и если ей удастся реализовать эту задачу на смартфонах, то проще будет и с узкоспециализированными гаджетами. Аналитики, однако, указывают, что проекты ПО подобного рода пока не снискали популярности — у таких приложений проблемы с безопасностью и поддержкой. С ними согласен и господин Пэй — он напомнил, что простоте в разработке приложений должна сопутствовать безопасность. «Нашими устройствами пользуются миллионы. Поэтому всё, что мы выпускаем, должно быть простым в обращении и не содержать ошибок. И нам важно поддерживать высокий уровень безопасности этих приложений», — пояснил он. Сейчас эти ИИ-инструменты доступны бесплатно, о платном варианте компания не говорит. Сейчас ей важнее наладить контакты с сообществом пользователей и поощрять тех, кто делает ценный вклад. Opera выпустила ИИ-браузер Neon и потребовала за его тестирование плату

30.09.2025 [15:08],

Владимир Мироненко

Opera запустила тестирование браузера с ИИ Neon. В нём примет участие ограниченный круг пользователей, которые будут платить за это $19,9 в месяц. Остальным желающим опробовать новый веб-обозреватель компания предложила присоединиться к листу ожидания.

Источник изображения: 9to5mac.com Компания представила «агентный браузер» Neon, не вдаваясь особо в подробности, в мае этого года. Теперь известно о ряде новых функций браузера от Opera, которые помогут пользователям максимально эффективно использовать его агентские возможности. Например, функция «Задачи» предназначена для анализа контекста открытых вкладок, будь то документ, веб-страница или поисковый запрос, и использования этой информации для сбора данных и выполнения действий с несколькими источниками одновременно. «Можно представить это так, как будто Opera Neon создаёт мини-браузер для каждой вашей задачи, где ИИ понимает, что вы делаете, и помогает вам в этом контексте, не обращаясь к информации из других элементов браузера», — сообщила Opera. Есть также функция «Карточки», с помощью которой можно сохранять часто используемые подсказки–инструкции для ИИ-агентов, а не вводить их с нуля для повторяющихся задач. Пользователи также могут комбинировать, сопоставлять и объединять карточки в цепочку для более сложных задач. «Это как иметь набор любимых моделей поведения ИИ, готовый к использованию в любой момент. Сравниваете продукты на разных вкладках? Добавьте карточки с подробными сведениями и сравнительными таблицами в подсказку. Или, если вы делаете заметки к встрече, объедините карточки с ключевыми решениями, пунктами действий и последующими действиями, и Opera Neon отобразит всё важное в правильном формате», — рассказала компания. Также предлагается магазин карточек, который позволяет использовать карточки, загруженные сообществом. Функция Neon Do реализует, так называемый, агентный просмотр, отвечая за просмотр веб-страниц в рамках выполнения задачи. При этом Neon Do работает в рамках реального сеанса пользователя в браузере, осуществляя навигацию от его имени и собирая данные из его реального контекста. Как сообщает 9to5mac, есть также функция Make, которая позволяет создавать небольшие приложения на основе запросов и потребностей пользователя, и Chat для взаимодействия пользователя с Neon в зависимости от контекста просматриваемой веб-страницы. Opera отметила, что Neon был разработан с учётом принципа конфиденциальности. Это означает, что данные авторизации и платёжная информация хранятся на устройстве и не используются для обучения ИИ-моделей. Выручка OpenAI выросла на 16 % до $4,3 млрд в первом полугодии — до окупаемости ещё далеко

30.09.2025 [13:31],

Алексей Разин

Амбициозный стартап OpenAI готовится привлекать на своё развитие сотни миллиардов долларов, но пока он далёк от окупаемости. Даже информация о финансовых потоках компании, поступающая из сторонних источников, подаётся весьма ограниченно, чтобы не смущать потенциальных инвесторов. В первом полугодии OpenAI удалось выручить $4,3 млрд, что на 16 % больше, чем в аналогичном периоде предыдущего года.

Источник изображения: Unsplash, Levart_Photographer Новые данные о динамике финансовых показателей OpenAI приводит Reuters со ссылкой на информацию, предназначавшуюся акционерам компании, опубликованную изданием The Information. Расходы компании за период составили $2,5 млрд, а с учётом инвестиций в исследования и разработки к этой сумме необходимо добавить ещё $6,7 млрд. К концу первого полугодия OpenAI располагала $17,5 млрд в форме денежных средств и высоколиквидных активов. Если учесть, что по итогам текущего года в целом OpenAI надеется выручить $13 млрд и потратить на операционные нужды около $8,5 млрд, то в способности компании обеспечивать свои потребности финансовыми ресурсами пока сомневаться не приходится. Напомним, что уровень ежемесячной выручки в $1 млрд стартап достиг ещё по итогам июля текущего года. Тогда компания рассчитывала по итогам всего года потратить около $8 млрд. Получается, что теперь эта цель сместилась вверх ещё на $500 млн. Уверенности в хороших перспективах бизнеса OpenAI инвесторам недавно придала сделка с Nvidia на $100 млрд, но фокус заключается в том, что значительную часть этих средств вторая компания получит обратно в виде платежей за аренду своих ускорителей вычислений. Microsoft добавила «вайб-воркинг» в Office — ИИ-агента для создания сложных документов и таблиц по указаниям пользователя

30.09.2025 [12:36],

Павел Котов

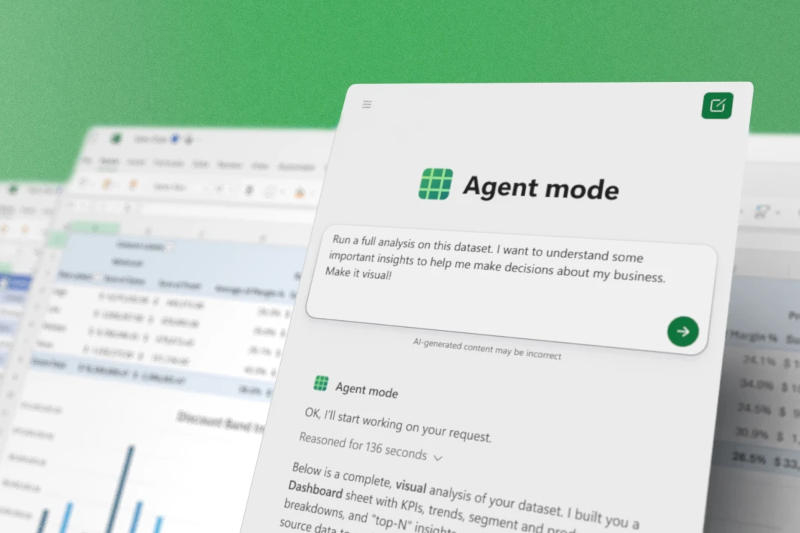

Microsoft запустила в Excel и Word режим агента с искусственным интеллектом (Agent Mode), позволяющий автоматически создавать по одному текстовому запросу сложные электронные таблицы и текстовые документы. В чате Copilot также дебютировала функция Office Agent, работающая на основе моделей Anthropic — она позволяет быстро создавать презентации PowerPoint и документы Word.

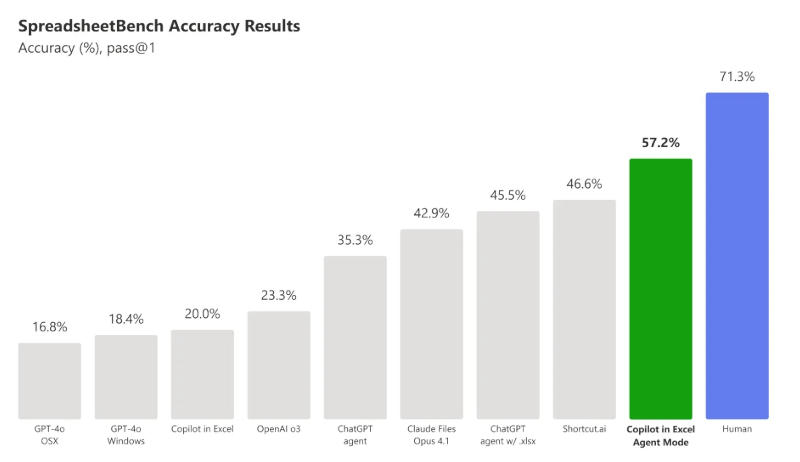

Источник изображений: microsoft.com Режим агента в Excel и Word — это более мощный вариант помощника Copilot, который уже присутствует в программах офисного пакета. Одна из задач агента состоит в том, чтобы сделать доступными для пользователей сложные функции Excel. ИИ-агент работает на базе модели OpenAI GPT-5. Получив сложную задачу, он разбивает её на этапы, составляет план и пояснения к нему, позволяя пользователю следить за своей работой. Каждый этап он, в свою очередь, делит на конкретные задачи, и каждое действие агента отображается на боковой панели. ИИ-агент в Excel набрал 57,2 % в тесте SpreadsheetBench, предназначенном специально для оценки способности моделей редактировать электронные таблицы. Это выше, чем показали Shortcut.ai, агент ChatGPT и Anthropic Claude Files Opus 4.1, но ниже результата человека, у которого 71,3 %. Режим агента в Word — это не просто редактирование и составление сводок текста. Агент готовит черновики материалов, предлагает уточнения и указывает, что может понадобиться при составлении документа. Можно свести рабочие данные за несколько месяцев в единый отчёт, подвести итоги месяца и быстро установить различия с предыдущим отчётом.  Office Agent на базе моделей Anthropic работает в чате Copilot вне пакета офисных приложений, но позволяет прямо в чате создавать презентации PowerPoint и документы Word. В случае PowerPoint пользователь получает презентацию с логичной структурой, при составлении которой ИИ может обращаться к источникам среди веб-ресурсов и в процессе демонстрирует предварительные версии слайдов. Примечательно, что в программах пакета Office основными выступают модели OpenAI, но всё большее место в экосистеме Microsoft занимают модели другого разработчика — Anthropic. Разработчик интегрировал Office Agent в чат Copilot, обращаясь к API Anthropic на базе Amazon Web Services — прямого конкурента Microsoft. Это, возможно, объясняет, почему глубокой интеграции моделей этого разработчика в офисном пакете пока нет. Режим ИИ-агента в Word и Excel уже доступен участникам программы тестирования экспериментальных функций Frontier — нужна подписка Microsoft 365 Copilot или Microsoft 365 Personal/Family. Пока он дебютировал только в веб-версиях приложений, но вскоре появится и в их десктопных вариантах. Office Agent тоже работает пока только для пользователей программы Frontier для подписчиков тех же Microsoft 365 Copilot и Microsoft 365 Personal/Family в США. Сделка по выходу с биржи обернулась для Electronic Arts долгом на $20 миллиардов — новые владельцы собираются сокращать расходы за счёт ИИ

30.09.2025 [12:11],

Дмитрий Рудь

Анонсированная накануне сделка на $55 млрд по переходу в частный статус обернётся для американского издателя и разработчика Electronic Arts многомиллиардным долгом и необходимостью быстро адаптироваться. Напомним, выкупать EA взялся консорциум инвесторов: инвестиционные компании Silver Lake и Affinity Partners, а также Суверенный фонд (PIF) Саудовской Аравии. Сделку планируют закрыть в первом квартале 2027 финансового года. В пресс-релизе упоминается, что $20 млрд из $55 млрд — заёмные средства (то есть долг), предоставленные банком JPMorgan Chase. Ожидается, что $18 млрд из этой суммы будут профинансированы к моменту закрытия сделки. Аналитик компании Circana Мэт Пискателла (Mat Piscatella) назвал долг Electronic Arts «шокирующе большим». По данным Financial Times, «справляться с большой долговой нагрузкой» новые владельцы компании собираются в том числе за счёт ИИ. Как передают источники Financial Times, новое руководство рассчитывает, что ИИ позволит «значительно сократить операционные расходы» Electronic Arts и увеличить прибыль компании в ближайшие годы. Что сделка означает для игр Electronic Arts, неясно. Более 70 % прибыли компании приносят сервисы вроде Madden NFL, EA Sports FC, Apex Legends и The Sims 4, в то время как Dragon Age: The Veilguard руководство разочаровала. В аналитической компании GlobalData отметили, что из-за растущих долгов EA становится всё менее новаторской, но сделка позволит устроить компании стратегическую перезагрузку и чаще идти на риск. OpenAI собралась создать подобие TikTok, но с 10-секундными вертикальными ИИ-видео от Sora 2

30.09.2025 [11:57],

Владимир Мироненко

Компания OpenAI готовится выпустить отдельное приложение для размещения коротких видеороликов, созданных с помощью ИИ-генератора видео Sora 2, сообщил ресурс Wired.

Источник изображения: Zac Wolff/unsplash.com Приложение предлагает ленту для публикации видео в вертикальном формате продолжительностью до 10 секунд с навигацией свайпом для прокрутки. В правой части ленты находится строка меню, позволяющая пользователям ставить лайки, комментировать или делать ремиксы видео. Также есть страница с предложениями «Для вас», работающая на основе алгоритма рекомендаций. Сервис не поддерживает возможность загрузки фото или видео, снятых камерой смартфона или из других приложений. В приложении Sora 2 есть функция подтверждения личности, которая позволяет пользователям подтверждать своё сходство. После верификации сходства пользователь может использовать его в видео. Другие пользователи также могут использовать их образы в клипах. Например, кто-то может создать видео, где он катается на американских горках в тематическом парке с другом. Пользователи будут получать уведомления при каждом использовании их образа, даже если клип останется в черновике и не будет опубликован в дальнейшем, сообщают источники Wired. OpenAI запустила приложение для внутренних нужд на прошлой неделе, и оно получило «исключительно положительные отзывы от сотрудников», пишет ресурс. Новый видеосервис OpenAI станет конкурентом похожим предложениям Meta✴ и Google. На прошлой неделе Meta✴ представила платформу Vibes для коротких ИИ-видео. Немногим ранее Google объявила об интеграции с YouTube специальной версии ИИ-модели Veo 3 для генерации видео. В свою очередь, TikTok занял более осторожную позицию в отношении контента, генерируемого ИИ. Недавно видеосервис пересмотрел свои правила относительно того, какие видео, созданные ИИ, можно размещать на платформе. В частности, запрещается размещение контента, создаваемого ИИ, который «вводит в заблуждение относительно вопросов общественной важности или наносит вред отдельным лицам». Новая ИИ-модель DeepSeek cделает работу с длинным контекстом вдвое дешевле и быстрее

30.09.2025 [10:46],

Владимир Мироненко

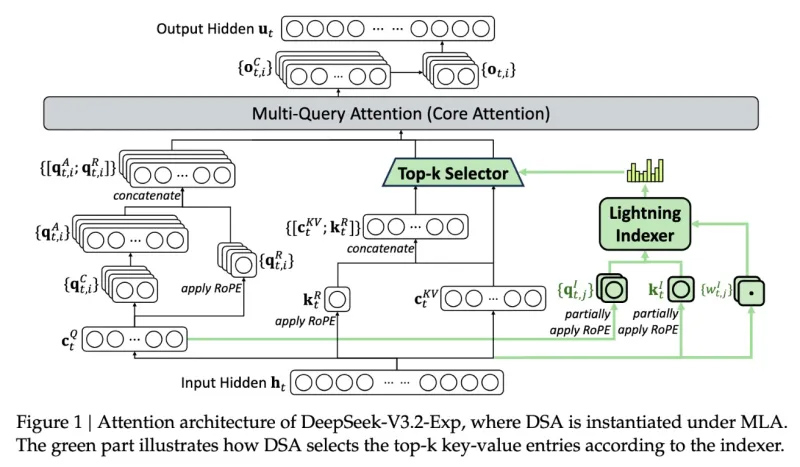

Инженеры DeepSeek представили новую экспериментальную модель V3.2-exp, которая обеспечивает вдвое меньшую стоимость инференса и значительное ускорение для сценариев с длинным контекстом.

Источник изображения: DeepSeek/TechCrunch «В качестве промежуточного шага к архитектуре следующего поколения, V3.2-Exp дополняет V3.1-Terminus, внедряя DeepSeek Sparse Attention — механизм разреженного внимания, предназначенный для исследования и валидации оптимизаций эффективности обучения и вывода в сценариях с длинным контекстом», — сообщила компания в публикации на платформе Hugging Face, отметив в сообщении в соцсети X, что цены на API снижены более чем на 50 %. С помощью механизма DeepSeek Sparse Attention (DSA), который работает как интеллектуальный фильтр, модель выбирает наиболее важные фрагменты контекста, из которых с использованием системы точного выбора токенов выбирает определённые токены для загрузки в ограниченное окно внимания модуля. Метод сочетает крупнозернистое сжатие токенов с мелкозернистым отбором, гарантируя, что модель не теряет более широкий контекст. DeepSeek утверждает, что новый механизм отличается от представленной раннее в этом году технологии Native Sparse Attention и может быть модифицирован для предобученных моделей. В бенчмарках V3.2-Exp не уступает предыдущей версии ИИ-модели. В тестах на рассуждение, кодирование и использование инструментов различия были незначительными — часто в пределах одного-двух пунктов, — в то время как рост эффективности был значительным, пишет techstartups.com. Модель работала в 2–3 раза быстрее при инференсе с длинным контекстом, сократила потребление памяти на 30–40 % и вдвое повысила эффективность обучения. Для разработчиков это означает более быструю реакцию, снижение затрат на инфраструктуру и более плавный путь к развёртыванию. Для операций с длинным контекстом преимущества системы весьма существенны, отметил ресурс TechCrunch. Для более надёжной оценки модели потребуется дальнейшее тестирование, но, поскольку она имеет открытый вес и свободно доступна на площадке Hugging Face, пользователи сами могут оценить с помощью тестов, насколько эффективна новая разработка DeepSeek. Kioxia: спрос на NAND будет расти на 20 % в год благодаря ИИ

30.09.2025 [09:42],

Алексей Разин

Не секрет, что ранее благоволивший главным образом производителям ускорителей вычислений и памяти типа HBM бум систем искусственного интеллекта начал увеличивать спрос и на ёмкие накопители, будь то HDD или SSD. Компания Kioxia убеждена, что в ближайшие несколько лет спрос на память типа NAND будет расти на 20 % ежегодно.

Источник изображения: Kioxia Подобные темпы будут обеспечиваться сохраняющейся потребностью владельцев центров обработки данных в расширении вычислительных мощностей для инфраструктуры искусственного интеллекта. Исходя из такого прогноза, Kioxia на ежемесячной основе планирует свои расходы на строительство новых производственных линий и предприятий. В этом признался Bloomberg исполнительный вице-президент Kioxia Томохару Ватанабэ (Tomoharu Watanabe). «Спрос высок, особенно со стороны гиперскейлеров, которым нужны чипы для нужд систем генеративного искусственного интеллекта», — заявил представитель компании. Он также добавил, что в модернизации нуждаются центры обработки данных, которые были введены в эксплуатацию пять или шесть лет назад. Некоторым из операторов ЦОД не хватает жёстких дисков, как заявил Ватанабэ. Kioxia на этой неделе запустила вторую очередь своего завода по производству флеш-памяти в префектуре Иватэ, а поставки его продукции в виде передовых чипов памяти она собирается начать в следующем полугодии. В ближайшие пять лет Kioxia намеревается удвоить объёмы выпуска памяти на своих предприятиях в префектурах Иватэ и Миэ. Спрос на NAND со стороны операторов облачной инфраструктуры должен уже в четвёртом квартале текущего года поднять цены на память данного класса на 5–10 % в последовательном сравнении, как считают эксперты TrendForce. SimpleOne DAY 25: ESM, Low-code и GenAI в крупнейших компаниях России

30.09.2025 [09:36],

Андрей Созинов

24 октября в Москве, на площадке LOFT HALL #1, состоится ежегодная конференция SimpleOne DAY 25 — одно из ключевых событий для профессионалов в сфере цифровизации бизнеса. Организаторы ожидают более 400 участников, среди которых — ИТ-директора, архитекторы, интеграторы и представители крупнейших российских компаний.

Источник изображения: SimpleOne Гости конференции смогут узнать о практическом опыте внедрения и масштабирования решений ITSM и ESM на примере таких компаний, как «Петрович-Тех», МТС Банк, Банк «Санкт-Петербург», «Систэм Электрик», Соцтех, РАНХиГС и других. Особое внимание будет уделено новым подходам к автоматизации: от low-code и no-code до pro-code-инструментов, которые помогают ускорять бизнес-процессы и сокращать издержки. В рамках отдельного блока участники обсудят реальные кейсы применения генеративного искусственного интеллекта (GenAI) — где и как он уже приносит пользу бизнесу. В числе докладчиков и партнёров — представители компаний «Медиа-тел», «Т1 Интеграция», AUXO, «Инфосистемы Джет» и других лидеров отрасли. Помимо насыщенной деловой программы, участников ждёт демонстрация новых возможностей платформы SimpleOne, планов по развитию, а также интерактивная демо-зона. Мероприятие пройдёт в неформальной атмосфере с возможностями для общения и обмена опытом: организаторы подготовили нетворкинг-сессии, живую музыку и фуршет. Участие бесплатное, но требуется предварительная регистрация до 17 октября — количество мест ограничено. Подать заявку на участие и ознакомиться с подробной программой можно на сайте SimpleOne. Пять причин полюбить смартфон HONOR X7d

30.09.2025 [09:00],

Андрей Созинов

HONOR X7d — это смартфон, который сочетает прочный корпус, долгую работу без подзарядки и современные ИИ-функции. Модель ориентирована на пользователей, которым нужен универсальный смартфон для любых условий: от работы и путешествий до семейных будней, а также для тех, кто не готов идти на компромиссы между надёжностью, автономностью и удобством. Слоган новинки лаконичен: «Надёжный — и точка».

Источник изображений: HONOR Прочность и защита HONOR X7d создавался для активных пользователей, ведущих подвижный образ жизни. Поэтому новинка выделяется высокой прочностью и надёжностью. Корпус смартфона обладает усиленными углами и прошёл независимое тестирование на прочность, выдержав падения с высоты до 2 метров (под прямым углом на твёрдую поверхность). Устройство удостоено престижного сертификата SGS 5 звёзд, что подтверждает его устойчивость к механическим воздействиям в реальных сценариях: будь то случайный урон дома или на работе, на улице или в дороге. Ещё смартфон соответствует классу защиты IP65, что означает полную пыленепроницаемость, а также устойчивость к брызгам и струям воды. Производитель заявляет, что смартфон способен выдержать кратковременное погружение на глубину до 0,5 метра, не теряя работоспособности, что особенно важно для активных людей, туристов, родителей маленьких детей или просто для тех, кто часто попадает в непредсказуемые погодные условия. Дополнительный плюс — возможность управления мокрыми руками благодаря продуманной технологии сенсора. HONOR X7d не подведёт ни на улице под дождём, ни на кухне, ни в мастерской. Мощная батарея Вторую причину обратить внимание на HONOR X7d по достоинству оценят все, кто устал жить от розетки до розетки. В смартфоне установлена огромная двухъячеечная батарея на 6500 мА·ч — одна из самых ёмких в своём классе. В реальной жизни это означает до двух полных дней использования смартфона в стандартных сценариях: звонки, мессенджеры, соцсети, навигация и даже просмотр видео. Даже при активной съёмке или постоянном использовании интернета энергии хватит на весь день с запасом.  Важно, что батарея HONOR X7d спроектирована для работы в течение как минимум пяти лет — аккумулятор очень медленно деградирует и почти не теряет ёмкость даже при частых циклах зарядки. Устройство сохраняет работоспособность при температурах от –20 °C до +55 °C: смартфон можно смело брать в горы, в жаркие страны или на лыжную прогулку. Дополняет ёмкий аккумулятор быстрая зарядка HONOR SuperCharge мощностью 35 Вт, которая позволяет оперативно восполнить запас энергии — например, утром перед выходом из дома или в обеденный перерыв. Умная ИИ-кнопка, сервисы Google и интеллектуальные инструменты HONOR X7d стал первым смартфоном в своём ценовом сегменте с выделенной ИИ-кнопкой. По умолчанию короткое нажатие может запускать любое выбранное пользователем приложение или ускорять работу системы — сценарии легко настраиваются. Эта функция особенно удобна для тех, кто часто пользуется определёнными программами: камерой, навигацией, мессенджером или фонариком. Нужное действие всегда под рукой — даже в перчатках или на ходу. Работает HONOR X7d на операционной системе Android 15 с фирменной оболочкой MagicOS 9.0. Как и у всех смартфонов Honor, здесь применён полноценный Android со всеми сервисами Google.  Кроме того, смартфон поддерживает полный набор ИИ-инструментов:

Продвинутая камера на 108 Мп HONOR X7d оснащён продвинутой основной камерой 108 Мп, которая гарантирует высочайшую детализацию и позволяет делать яркие, насыщенные снимки даже ночью. Трёхкратный цифровой зум, портретный режим с мягким боке, автоматическая корректировка цвета и экспозиции с помощью встроенных ИИ-алгоритмов делают фотографии выразительными и профессиональными без лишних настроек.  Функции AI-редактирования позволят довести каждый кадр до совершенства: стереть нежелательные объекты, расширить пейзаж, скорректировать цвет или восстановить закрытые глаза на групповом фото. Всё редактирование происходит прямо в галерее смартфона, экономя ваше время и ресурсы. Большой и плавный экран  HONOR X7d оснащён большим 6,77-дюймовым экраном с частотой обновления 120 Гц и разрешением 1610 × 720 пикселей. Крупный дисплей обеспечивает комфорт при чтении, просмотре видео, сёрфинге в интернете и играх. Высокая частота обновления гарантирует плавные анимации и прокрутку. Яркость до 700 кд/м² обеспечивает удобное использование смартфона на улице в солнечные дни, а функция умной регулировки яркости и тонов делает использование комфортным и днём, и вечером: оттенки становятся теплее, снижая нагрузку на глаза и не мешая выработке мелатонина для сна. Заключение Cмартфон HONOR X7d создан для тех, кто не готов идти на компромиссы в надёжности, автономности и функциональности. Усиленный корпус, влагозащита, большая батарея, умные ИИ-инструменты и мощная камера — веские причины обратить внимание на эту модель. Эра синтетических звёзд началась: ИИ-актриса Тилли Норвуд уже получает роли и набирает популярность

30.09.2025 [08:10],

Алексей Разин

Возможности современных систем генеративного искусственного интеллекта не ограничиваются созданием реалистичных статичных образов людей и коротких роликов, им вполне по силам создание целых виртуальных актёров. Агентство Xicoia утверждает, что порождённая ИИ актриса Тилли Норвуд (Tilly Norwood) стремительно набирает популярность как у зрителей, так и у профильных агентств.

Источник изображения: Xicoia Об этом сообщила на Цюрихском кинофестивале основательница родственной студии Particle6 актриса, комик и писательница Элин ван дер Вельден (Eline van der Velden), как отмечает Variety. Она является главой специализированной студии Particle6, которая занимается производством контента с использованием технологий искусственного интеллекта. Агентство Xicoia будет продвигать виртуальных актёров на соответствующем рынке, и Тилли Норвуд (Tilly Norwood) является первым персонажем, которого агентство готово предлагать создателям контента. В ближайшие несколько месяцев будут сделаны очередные заявления в этой сфере. По словам ван дер Вельден, на первых порах люди удивлялись самой идее создания виртуальных актёров, а теперь их интересы готовы представлять на рынке труда в кинематографической сфере серьёзные агентства. Ещё в июле этого года на странице в одной из популярных социальных сетей виртуальная актриса Тилли Норвуд сообщила о выходе своей первой работы, которой стала роль в комедийной сценке AI Commissioner. Элин ван дер Вельден заявила, что студия, создавшая Норвуд, желает ей блистательного будущего: «Мы хотим, чтобы Тилли стала следующей Скарлетт Йоханссон или Натали Портман, в этом заключается цель наших действий». По словам основательницы студии, производители контента двигаются в сторону использования ИИ в силу экономических факторов. Создатели кинокартин и телепроектов ощущают, по её мнению, что ИИ не ограничивает их творческие идеи с точки зрения бюджета на съёмку — нет никаких преград для творчества, а потому ИИ будет влиять на отрасль в положительном ключе. Нужно лишь изменить точку зрения людей на этот вопрос. Как добавила ван дер Вельден, аудитории важна сама история, а не наличие у кинозвезды пульса: «Тилли уже привлекает интерес агентств и поклонников. Эра синтетических актёров не грядёт, она уже наступила». Живые актёры новость о появлении ИИ-актрисы встретили в штыки. Звезда «Крика» Мелисса Баррера предложила бойкотировать компании, которые берут на работу цифровых артистов. Её поддержали Кирси Клемонс, Мара Уилсон и другие коллеги. «А как же сотни живых молодых женщин, чьи лица вы использовали для генерации её? Вы не могли нанять ни одну из них?» — задала риторический вопрос Мара Уилсон. OpenAI встроила онлайн-шоппинг в ChatGPT: покупать товары теперь можно не выходя из чата

30.09.2025 [07:42],

Алексей Разин

На рынке США компания OpenAI предложила клиентам определённых торговых площадок функцию интеграции онлайн-шоппинга в диалоговое окно своего ChatGPT, чтобы они могли находить нужные товары через чат-бот и там же совершать покупки. Этим самым OpenAI вторгается в сферу коммерческих интересов Amazon и Google, помимо прочих.

Источник изображения: Unsplash, CardMapr.nl Как отмечает TechCrunch, нововведение доступно зарегистрированным пользователям планов ChatGPT Pro, Plus и Free на территории США, которые могут покупать товары с площадок Etsy и Shopify, хотя в последнем случае поддержка нововведения пока находится в состоянии реализации. ChatGPT выступает в роли агента, готового передать платёжную информацию от покупателя продавцу в зашифрованном виде, если пользователь чат-бота определится со своим выбором и пожелает совершить покупку. Удобство заключается в том, что покупателю не нужно будет открывать отдельное окно или приложение, и сделку можно будет оформить прямо из ChatGPT. Поддерживаются платёжные системы Apple Pay, Google Pay, Stripe и банковские карты. Нельзя сказать, что OpenAI стала пионером в этой области, поскольку Perplexity подобные функции реализовала в своей экосистеме ещё в прошлом году. Microsoft также позволяет продавцам интегрировать функцию покупки товаров в Copilot. При этом OpenAI собирается открыть для разработчиков исходный код протокола ACP, который позволит им интегрировать опцию моментальной покупки через Stripe в свои программные интерфейсы. Компании Google и Amazon, которые долгое время выступали крупными агентами в сфере онлайн-торговли, теперь получат нового амбициозного конкурента. Тем более, что они также предлагают разработчикам ПО для торговых площадок протокол AP2, позволяющий интегрировать функцию покупки через ИИ-агента. Президент OpenAI: человечеству потребуется 10 млрд ИИ-ускорителей — по одному на каждого жителя Земли

30.09.2025 [06:58],

Алексей Разин

Сейчас стартап OpenAI использует любую возможность для привлечения не только финансовых ресурсов, но и заключения контрактов с поставщиками тех же ускорителей вычислений, коим является Nvidia. Президент компании Грег Брокман (Greg Brockman) убеждён, что человечеству потребуется до 10 млрд ускорителей вычислений, и каждого жителя планеты буквально будет обслуживать отдельный ИИ-чип.

Источник изображения: Nvidia Своими соображениями президент OpenAI поделился в интервью CNBC, в котором также приняли участие генеральный директор компании Сэм Альтман (Sam Altman), а также глава и основатель Nvidia Дженсен Хуанг (Jensen Huang). По мнению Альтмана, масштабы сотрудничества с Nvidia по своей значимости для человечества окажутся важнее программы доставки до Луны американских астронавтов, которую NASA реализовало в прошлом веке. Альтман видит будущее человечества с неразрывным присутствием «супермозга», созданного искусственным интеллектом и активно влияющего на повседневную жизнь людей. Брокман же считает, что ИИ будет действовать в качестве «агента, который работает на опережение, пока вы спите». Каждый работающий житель Земли, по его мнению, будет использовать ресурсы как минимум одного ускорителя вычислений при выполнении своих должностных обязанностей. «Вам действительно захочется, чтобы у каждого человека был свой собственный выделенный GPU», — охарактеризовал свой прогноз Брокман. Сейчас подобное предсказание может казаться нереалистичным, но достаточно вспомнить, что в начале девяностых годов прошлого века один из основателей Microosft Билл Гейтс (Bill Gates) указывал на неизбежность появления компьютера не только в каждом домохозяйстве, но и на каждом рабочем столе. В какой-то мере его предсказание сбылось, пусть даже если вместо компьютеров в их классической форме речь идёт о смартфонах, которые помещаются в карман. Брокман считает, что сейчас отрасль ИИ на три порядка отстаёт от потенциальных потребностей в вычислительных мощностях, и для создания постоянно функционирующей глобальной системы искусственного интеллекта человечеству может потребоваться до 10 млрд ускорителей вычислений. По сути, это даже больше, чем проживает людей на Земле (8,2 млрд человек). Мир, по мнению Брокмана, движется к состоянию, при котором экономику подпитывают вычисления. Вычислительных мощностей сейчас не хватает, как он считает, а наличие достаточно мощных центров обработки данных в будущем станет определять состоятельность экономики целых стран. В какой-то мере они заменят валюту в качестве источника ресурсов для развития экономики. Геймер собрал внутри Minecraft рабочий ChatGPT — на это ушло 439 млн блоков

29.09.2025 [23:37],

Николай Хижняк

Игра Minecraft представляет собой «песочницу», ограниченную только вашим воображением и творческими способностями, что в полной мере демонстрируется в видео от YouTube-блогера sammyuri. Используя механику материала редстоун из оригинальной версии Minecraft, геймер сумел создать функциональную небольшую языковую модель ИИ, работающую внутри игры.

Источник изображений: YouTube / sammyuri Если вы видели предыдущие примеры экстремальной инженерии в Minecraft, то наверняка знакомы с работами sammyuri. Его последний проект, получивший название CraftGPT, занимает объём 1020 × 260 × 1656 блоков (439 млн). Он настолько большой, что для его демонстрации в видео понадобился мод District Horizons. Небольшая языковая модель имеет 5 087 280 параметров и была обучена на Python с помощью набора данных TinyChat. По данным некоторых пользователей, отметившихся в комментариях к видео, языковая модель CraftGPT примерно в 23 раза меньше модели GPT-1 и примерно в 175 тыс. раз меньше модели GPT-3. Несмотря на заявленные характеристики, sammyuri советует смягчить ожидания от CraftGPT: модель часто может отклоняться от темы и выдавать грамматически неверные ответы или просто ответы, не соответствующие запросу. Кроме того, CraftGPT — очень медленная модель. Даже несмотря на использование высокопроизводительного сервера Minecraft Redstone для увеличения тикрейта в 40 000 раз, CraftGPT может генерировать ответ примерно за два часа. Без увеличения тикрейта ждать ответа пришлось бы более 10 лет. Те, кто хочет попробовать CraftGPT, могут скачать все необходимые файлы на GitHub. Sammyuri рекомендует использовать ПК с объёмом ОЗУ не менее 32 Гбайт, в идеале — 64 Гбайт. На GitHub также есть инструкции по настройке и несколько полезных советов по максимально эффективному использованию небольшой языковой модели. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |