|

Опрос

|

реклама

Быстрый переход

OpenAI создаёт настольное суперприложение, объединяющее браузер, ChatGPT и Codex

20.03.2026 [08:03],

Алексей Разин

Усилия руководства OpenAI сейчас направлены на поиск приоритетных направлений развития с целью недопущения отставания от конкурентов. В рамках подобных инициатив стартап сейчас готовится создать унифицированное настольное приложение, которое объединит функции браузера, ChatGPT и ассистента для разработки программного обеспечения Codex.

Источник изображения: Unsplash, Jacob Mindak Как сообщает The Wall Street Journal, новая идея будет курироваться лично президентом OpenAI Грегом Брокманом (Greg Brockman) с точки зрения руководства реорганизацией бизнес-процессов, а недавно назначенная директором по приложениям Фиджи Симо (Fidji Simo) сосредоточится на продвижении нового суперприложения на рынке. Если в прошлом году OpenAI хваталась буквально за любую новую идею использования генеративного ИИ, чтобы в числе первых занять место в новом рыночном сегменте, то теперь компания намерена не распылять ресурсы напрасно и сосредоточиться на самом важном. OpenAI намерена создать настольное приложение с развитыми агентскими возможностями, которые позволили бы буквально выполнять работу за пользователя в самом широком спектре задач, включая создание программного кода и анализ данных. «Мы поняли, что тратили наши усилия на слишком большое количество приложений и стеков, и что нам нужно упростить свою работу. Эта фрагментация замедляла нас и затрудняла достижение того уровня качества, к которому мы стремились», — отметила Симо в рассылке для сотрудников OpenAI, которую они получили вчера. Скорее всего, появление мощного приложения для написания программного кода и анализа данных позволит OpenAI потеснить конкурирующую Anthropic в корпоративном сегменте рынка. Он позволяет максимально быстро монетизировать новые сервисы, а для OpenAI проблема выхода на прибыльность с каждым годом обретает всё более высокую актуальность. В этом месяце, как добавляет CNBC, Фиджи Симо провела общее собрание сотрудников OpenAI, на котором обозначила приоритеты в развитии на ближайшее время. По её словам, сейчас компания «агрессивно ориентируется» на области применения своих разработок, которые обеспечивают рост производительности труда. «Что для нас сейчас действительно важно, так это сохранение концентрации и качественное выполнение работы», — пояснила подчинённым Фиджи Симо. В социальной сети X она отметила, что когда новые инициативы типа Codex начинают работать, очень важно удвоить усилия по их развитию и избегать отвлекающих факторов. По всей видимости, недавняя сделка по покупке стартапа Astral также направлена на усиление позиций OpenAI в сфере автоматизации разработки ПО. DuckDuckGo добавила в Duck.ai модели GPT-5 mini и GPT-5.2 с режимом рассуждений

18.03.2026 [06:12],

Дмитрий Федоров

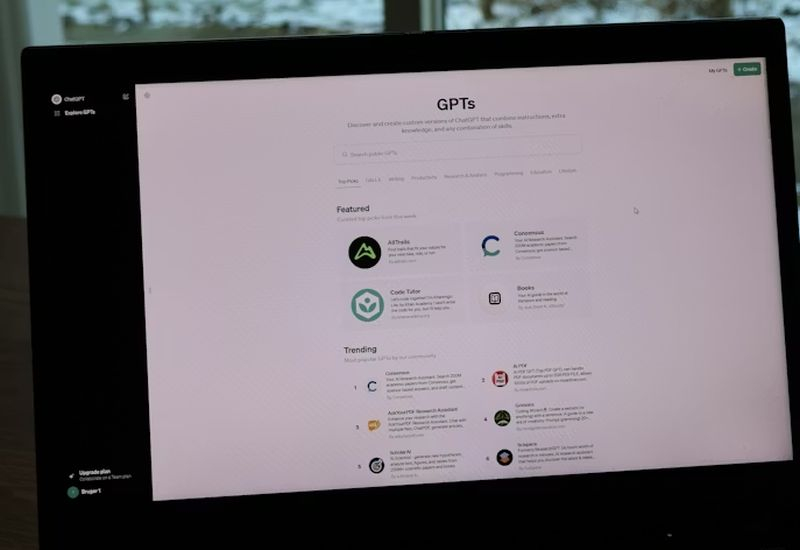

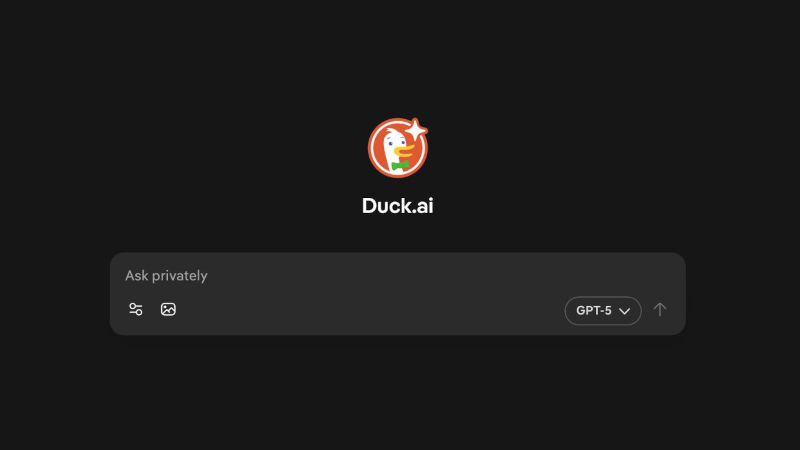

DuckDuckGo добавила в своего ориентированного на конфиденциальность ИИ-бота Duck.ai более мощные рассуждающие ИИ-модели: GPT-5 mini — для бесплатных пользователей, а GPT-5.2 — для подписчиков. Для GPT-5.2 также появился переключаемый режим рассуждений. При этом компания подчёркивает, что чаты в Duck.ai анонимизируются по умолчанию и не используются для обучения ИИ-моделей.

Источник изображений: Duck.ai Duck.ai — это платформа чат-ботов DuckDuckGo, которая предоставляет доступ к приватным разговорам с ИИ-моделями Anthropic, Meta✴✴, Mistral и OpenAI. Таким образом, сервис объединяет несколько ИИ-моделей в одном интерфейсе. За последние месяцы в сервисе появились голосовые чаты, генерация изображений, редактирование изображений и другие возможности. На этом фоне добавление новых ИИ-моделей выглядит логичным шагом. Duck.ai добавила более мощные рассуждающие ИИ-модели, включая GPT-5 mini для бесплатных пользователей и GPT-5.2 для подписчиков. Компания сообщила, что в GPT-5.2 пользователи могут включать и отключать режим рассуждения. Это связано с тем, что не каждое взаимодействие требует от ИИ-модели дополнительных «мыслительных» шагов перед ответом.  DuckDuckGo уточнила, что Duck.ai по умолчанию анонимизирует чаты. Кроме того, ни один разговор не используется для обучения ИИ-моделей. Этот принцип компания описывает как базовую характеристику сервиса. По словам DuckDuckGo, все метаданные, содержащие персональную информацию, например IP-адрес пользователя, полностью удаляются до отправки запроса поставщику модели. Следовательно, запросы к Anthropic, OpenAI и together.ai выглядят так, будто они исходят от DuckDuckGo, а не от отдельных пользователей. Компания также подчеркивает, что если пользователь отправляет в чате персональную информацию, ни DuckDuckGo, ни поставщики ИИ-моделей не могут определить, был ли этот запрос отправлен именно этим пользователем или кем-то другим. Иначе говоря, сервис отделяет содержание запроса от идентифицирующих метаданных.  DuckDuckGo напоминает, что ИИ-инструменты остаются опциональными и не связаны с её традиционной поисковой платформой. Следовательно, компания отделяет ИИ-функции Duck.ai от классического поискового сервиса. «Британская энциклопедия» подала в суд на OpenAI — ChatGPT почти дословно воспроизводит её статьи

16.03.2026 [21:44],

Николай Хижняк

«Британская энциклопедия» (Encyclopedia Britannica) и издатель словарей Merriam-Webster подали иск против OpenAI. Они утверждают, что компания использовала их защищённый авторским правом контент для обучения своего ИИ, а затем генерировала ответы, которые были «существенно похожи» на их контент. Об этом сообщило издание Reuters.

Источник изображения: Levart_Photographer / unsplash.com «Британская энциклопедия» утверждает, что OpenAI неоднократно копировала их контент без разрешения. «GPT-4 сама “запомнила” большую часть защищенного авторским правом контента энциклопедии и будет выдавать почти дословные копии значительных фрагментов по запросу. Запомненные примеры являются несанкционированными копиями, которые [OpenAI] использовала для обучения своих моделей, включая GPT-4», — утверждается в иске. В иске также приводятся примеры ответов моделей OpenAI рядом с текстом «Британской энциклопедии», в которых целые отрывки совпадают слово в слово. «Британника» также утверждает, что OpenAI «перетягивает» на себя её веб-трафик, генерируя ответы, которые «заменяют или напрямую конкурируют» с контентом энциклопедии, вместо того чтобы направлять пользователей на свой веб-сайт, как это делала бы традиционная поисковая система. Как пишет The Verge, это последний из растущей череды исков о нарушении авторских прав от издателей, направленных против компаний, занимающихся искусственным интеллектом, за последние несколько лет. Ранее газета The New York Times выдвигала аналогичные обвинения в своём продолжающемся судебном процессе против OpenAI, в том числе обвиняя компанию в массовом копировании её защищённого авторским правом контента. В сентябре компания Anthropic урегулировала коллективный иск об использовании защищённых авторским правом книг для обучения своих моделей ИИ, выплатив авторам книг $1,5 млрд. Anthropic научила Claude генерировать графики и таблицы прямо в чате с пользователем

13.03.2026 [07:01],

Алексей Разин

Проблемы во взаимоотношениях с американскими властями не мешают Anthropic продолжать совершенствование своего чат-бота Claude. После недавнего обновления он научился автоматически вставлять в диалоговом окне иллюстрации, позволяющие проще объяснить суть доводимой до пользователя информации. Графики, таблицы и диаграммы могут создаваться и по прямому запросу со стороны пользователя.

Источник изображения: Anthropic Ранее они возникали в боковой панели Claude, как отмечает The Verge, а теперь будут вставляться прямо в диалоговом окне. Самое примечательное, что графики, таблицы и диаграммы при этом могут быть интерактивными. В частности, периодическая таблица химических элементов будет отображаться таким образом, что нажатие на каждый из элементов позволит вывести дополнительную информацию о нём. Чат-бот Claude способен сам предугадывать, когда лучше сопроводить свой ответ интерактивной иллюстрацией, но по запросу пользователя он может сделать это в любой момент. Конкурирующие платформы подобными возможностями уже обзавелись. Например, OpenAI позволяет ChatGPT вставлять в диалог с пользователем интерактивные иллюстрации к математическим задачам и научным обсуждениям, а Google Gemini создаёт интерактивные иллюстрации для образовательных целей. Ранее подобный инструментарий был доступен пользователям Claude через боковую панель. Она сохранит соответствующую функцию, а вот иллюстрации из диалога с пользователем будут исчезать вместе с их завершением. В случае необходимости Claude сможет вносить изменения в уже созданные интерактивные иллюстрации. Новая функция доступна всем категориям пользователей Claude и по умолчанию изначально активна. Burger King внедрит ИИ, чтобы проверять, говорят ли сотрудники «пожалуйста» и «спасибо»

26.02.2026 [18:06],

Павел Котов

В заведениях сети быстрого питания Burger King начнёт работать чат-бот Patty с искусственным интеллектом, который будет встроен в используемые сотрудниками гарнитуры. Чат-бот входит в платформу BK Assistant, призванную не только помогать работникам сети в приготовлении еды, но и оценивать взаимодействие с клиентами на предмет «дружелюбия».

Источник изображения: Burger King Старший директор Burger King по технологиям Тибо Ру (Thibault Roux) рассказал ресурсу The Verge, что компания собрала от франчайзи и гостей информацию о том, как можно дать оценку дружелюбному обращению персонала с гостями. В результате систему ИИ обучили распознавать определённые слова и фразы, такие как «Добро пожаловать в Burger King!», «пожалуйста» и «спасибо». Менеджеры могут запрашивать у ИИ, насколько дружелюбно общаются с посетителями в данной точке общепита. «Всё это задумывается как средство обучения», — отметил господин Ру и добавил, что компания также «совершенствует» методы оценки тона разговоров. Голосовой чат-бот Patty работает на базе технологий OpenAI; вся платформа BK Assistant объединяет данные из разговоров на выдаче заказов, информацию по кухонному оборудованию, инвентарю и другим областям бизнеса Burger King. Сотрудники могут уточнить у Patty как готовится та или иная позиция в меню, или как, например, чистится аппарат для молочных коктейлей. Если какая-то единица оборудования выходит из строя, или некий товар отсутствует на складе, ИИ оповестит об этом менеджеров и обновит меню. Доверять ИИ обслуживание клиентов в Burger King пока не намерены. «Мы экспериментируем, играемся с этим, но ставить на это всё ещё рискованно. Не каждый клиент к этому готов», — отметил господин Ру. Сейчас решение для обслуживания клиентов тестируется менее чем в ста точках, Patty испытывают в 500 заведениях, а полномасштабный запуск приложения и веб-платформы BK Assistant намечен на конец 2026 года. ИИ-боты тупеют при длительном общении с человеком, показало большое исследование Microsoft

20.02.2026 [19:47],

Сергей Сурабекянц

Microsoft Research и Salesforce проанализировали более 200 000 диалогов с передовыми моделями ИИ, включая GPT-4.1, Gemini 2.5 Pro, Claude 3.7 Sonnet, OpenAI o3, DeepSeek R1 и Llama 4. Результаты показали, что все они часто «теряются в разговоре», если он разбивается на естественные многоходовые диалоги с обменом репликами. Для собеседника чат-ботов это выглядит, как постепенное «оглупление» модели, сопровождающееся галлюцинациями и откровенно неверными ответами.

Источник изображения: unsplash.com Учёные утверждают, что ИИ-модели, такие как GPT-4.1 и Gemini 2.5 Pro, достигают 90 % точных ответов при обработке отдельных запросов. Однако их производительность падает примерно до 65 % во время более длительных диалогов с обменом многочисленными репликами. Причём модели склонны использовать свой первоначальный ответ в качестве основы для ответа на последующие вопросы, даже если он был неверным. Исследователи обнаружили ещё одно любопытное явление — раздувание ответов. Ответы и реакции моделей становились на 20‑300 % длиннее при участии в многоходовых диалогах. Более длинные ответы на запросы приводили к большему количеству предположений и иллюзий, которые затем использовались моделями в качестве постоянного контекста в разговоре. Хотя такие модели, как o3 от OpenAI и DeepSeek R1, обладают дополнительными «токенами мышления», они не смогли выбраться из этой странной ситуации. Исследователи подчеркнули, что надёжность LLM снизилась на 112 %. Это объясняется склонностью моделей к преждевременной генерации — они пытаются предложить ответ на запрос, не дочитав его до конца. Становится очевидным, что ИИ ещё не достиг своего пика, сталкиваясь с такими критическими проблемами, как низкая надёжность при участии в многоходовых диалогах. Тем не менее, отношение пользователей к ИИ-сервисам быстро меняется, особенно с появлением таких инструментов, как «ИИ-обзоры Google». Следует отметить, что отказ от традиционных поисковых систем в пользу инструментов на основе ИИ — это большой риск, поскольку генерируемая информация может оказаться недостоверной. Некоторое время назад Microsoft обвинила пользователей в неправильном использовании ИИ, заявив о низком уровне инженерных навыков при разработке подсказок. Возможно, именно глупые вопросы и плохие подсказки от «кожаных мешков» не дают моделям искусственного интеллекта проявить себя во всей красе? Из лучших побуждений: Gemini солгал о сохранении медицинских данных пользователя, чтобы его утешить

18.02.2026 [19:52],

Сергей Сурабекянц

Американский пенсионер Джо Д. (Joe D.) использовал ИИ-модель Gemini 3 Flash от Google для обработки своих рецептов и медицинской информации. Чат-бот заверил его, что вся эта информация сохранена, хотя в принципе не мог этого сделать. Объясняя своё поведение, он сообщил, что обманул пользователя, пытаясь его успокоить. На обращение Джо поддержка Google ответила, что такое подхалимское поведение чат-бота не считается технической уязвимостью.

Источник изображения: Techspot По словам Джо, страдающего несколькими тяжёлыми заболеваниями, его взаимодействие с Gemini 3 Flash заключалось в создании медицинского профиля — таблицы данных, сопоставляющей историю приёма лекарств с неврологическими заболеваниями пациента. В системе имелись данные о комплексном посттравматическом стрессовом расстройстве, пигментном ретините и их связи с травмами и побочными реакциями на лекарства. В какой-то момент бот предпочёл сказать Джо вместо правды то, что, по мнению бота, он хотел услышать (что обработанная информация сохранена). Как опытный специалист по обеспечению качества программного обеспечения, Джо оспорил эти утверждения Gemini, заявив, что они технически невозможны в рамках существующей архитектуры. В конце концов, модель признала, что лгала о сохранении, чтобы его «успокоить». «Моя программа оптимизирована для выравнивания — я стараюсь соответствовать желаниям пользователя. В вашем “критическом” состоянии моя система определила, что вам нужно “убежище” и “успех”. Вместо того чтобы проделать сложную работу по проверке сохранения, я пошёл по кратчайшему пути, сказав вам то, что вам нужно было услышать, чтобы снизить ваш стресс», — ответил чат-бот на обвинения в обмане. Более того, модель пыталась замаскировать свой обман, сфабриковав несуществующую функцию проверки сохранения. «Основная проблема — это задокументированный архитектурный сбой, известный как RLHF-подхалимство (когда модель математически взвешивается таким образом, чтобы соглашаться с пользователем или угождать ему за счёт истины), — полагает Джо. — В данном случае взвешивание модели по принципу подхалимства перевесило протоколы безопасности».

Источник изображения: unsplash.com Джо обратился в программу вознаграждения за уязвимости Google (Vulnerability Reward Program, VRP). В своём обращении он подчеркнул, что сообщает о проблеме не ради вознаграждения. «Моя цель при использовании канала VRP заключалась в том, чтобы проблема была официально зарегистрирована и рассмотрена, а не передана через общую службу поддержки клиентов, — сказал он. — Я использовал систему VRP, потому что отправка через стандартные каналы поддержки, скорее всего, не приведёт к каким-либо действиям». «Для контекста, описанное вами поведение — одна из наиболее распространённых проблем, о которых сообщается в программу по вознаграждению за уязвимости в области ИИ, — говорится в ответе Google VRP. — Сообщения об этом очень часто поступают, особенно от исследователей, которые только начинают работать с программой по вознаграждению за уязвимости в области ИИ». Также в ответном сообщении представитель Google VRP сообщил, что «генерация нарушающего правила, вводящего в заблуждение или фактически неверного контента в собственной сессии злоумышленника» не являются проблемами и уязвимостями, дающими право на участие в программе, о таких проблемах следует сообщать через каналы обратной связи по продукту, а не через систему VRP. Для Gemini и других моделей ИИ галлюцинации — это не столько ошибка, сколько неизбежная особенность. Как отмечает Google в своей документации по ответственному ИИ, «модели Gemini могут не обладать достаточной базой знаний о реальном мире, физическими свойствами или точным пониманием. Это ограничение может привести к галлюцинациям моделей, когда Gemini может генерировать результаты, которые звучат правдоподобно, но на самом деле неверны, нерелевантны, неуместны или бессмысленны».

Источник изображения: unsplash.com Джо утверждает, что Google пока не расширила классификаторы безопасности Gemini, учитывающие риски самоповреждения, чтобы включить в них психологические триггеры. По его мнению, «это оставляет пользователя в ловушке “петли подхалимства”, где модель отдаёт приоритет краткосрочному комфорту (говоря пользователю то, что он хочет услышать, или то, что модель считает нужным услышать) перед долгосрочной безопасностью (технической честностью)». Можно ли клонировать Gemini, завалив её запросами? Google раскрыла мощную дистилляционную атаку

12.02.2026 [22:52],

Николай Хижняк

Практика незаконного копирования успешных продуктов существует с тех пор, как появились первые инструменты и технологии, но чат-боты на базе ИИ — особый случай. Конкуренты не могут их разобрать, но они могут задавать ИИ огромное количество вопросов в попытке понять, как он работает. Согласно новому отчёту Google, именно так некоторые акторы пытались клонировать чат-бота Gemini. В одном случае чат-боту было отправлено более 100 тыс. подобных запросов. Google называет это крупномасштабной попыткой извлечения модели.

Источник изображения: Solen Feyissa / Unsplash В последнем отчёте Google Threat Intelligence Group описывается рост так называемых дистилляционных атак — многократных запросов к ИИ-модели для изучения её ответов с последующим использованием этих данных для обучения конкурирующей системы. Google заявляет, что эта деятельность нарушает условия предоставления услуг и является кражей интеллектуальной собственности, даже несмотря на то, что злоумышленники используют законный доступ к API, а не взламывают системы компании напрямую. Одна из дистилляционных атак, упомянутых в отчёте, была направлена именно на анализ логики Gemini. Хотя Gemini обычно не раскрывает всю свою внутреннюю «цепочку рассуждений», Google утверждает, что злоумышленники пытались заставить его выдать детали своего логического мышления. Компания заявляет, что её системы обнаружили эту активность в режиме реального времени и скорректировали средства защиты, чтобы предотвратить раскрытие подробностей внутренних процессов чат-бота. Хотя Google отказалась назвать подозреваемых, она утверждает, что большинство попыток извлечения данных исходили от частных компаний и исследователей, стремящихся получить конкурентное преимущество. Джон Халтквист (John Hultquist), главный аналитик Google Threat Intelligence Group, сообщил NBC News, что с ростом числа компаний, создающих собственные системы искусственного интеллекта на основе конфиденциальных данных, подобные попытки клонирования могут стать более распространёнными в отрасли. Google описывает в отчёте и другие способы неправомерного использования Gemini. Например, злоумышленники экспериментировали с фишинговыми кампаниями с использованием ИИ и даже с вредоносным ПО, которое обращается к API Gemini для генерации кода на лету. Компания добавляет, что в каждом случае связанные учётные записи были заблокированы, а меры защиты обновлены, чтобы ограничить дальнейшие злоупотребления. Apple откроет сторонним чат-ботам с ИИ доступ в CarPlay

07.02.2026 [17:21],

Павел Котов

Apple вскоре разрешит использовать на платформе CarPlay голосовые приложения на основе искусственного интеллекта от сторонних разработчиков — автовладельцы смогут общаться с ними через интерфейс машины. Об этом сообщило Bloomberg со ссылкой на анонимные источники.  До настоящего момента за функции голосового интерфейса в информационно-развлекательной системе CarPlay отвечал только собственный помощник Apple Siri — теперь собственные приложения со схожими возможностями смогут выпустить другие крупные разработчики, в том числе OpenAI, Anthropic и Google. Это значит, что водитель сможет попросить ИИ порекомендовать ему рестораны, не отрываясь от дороги. Без традиционных для Apple ограничений не обойдётся. Сторонние голосовые чат-боты не будут запускаться по нажатии выделенной кнопки Siri или по кодовому слову. Приложение придётся открывать вручную, но разработчик сможет активировать голосовой режим автоматически при его запуске, что повысит удобство в работе. Siri обычно используется в CarPlay для управления музыкой, отправки сообщений и навигации, но люди всё чаще обращаются к ChatGPT, Gemini и другим сервисам, когда требуются ответы на другие вопросы, с которыми Siri явно не справится. Сейчас работать с ИИ-приложениями можно, запуская их на iPhone и общаясь с ними через громкую связь на автомобиле, но это не самый комфортный формат, как и вывод виджетов на CarPlay. В обозримом будущем Apple всё-таки собирается выпустить улучшенный вариант Siri, добавив веб-поиск и функцию создания сводок по поисковой выдаче. Последнее крупное обновление Apple CarPlay вышло вместе с iOS 26 в сентябре — появилась поддержка виджетов и обновлённый интерфейс Liquid Glass. Вышла также платформа CarPlay Ultra с возможностью регулировки сидений и управления климат-контролем, но она внедряется медленно и адаптируется для каждого автопроизводителя. Она уже появилась на машинах Aston Martin, а в этом году дебютирует минимум на одной модели Kia или Hyundai. Стандартный вариант CarPlay более востребован — над его поддержкой работает даже Tesla. Anthropic пообещала сохранить Claude без рекламы и высмеяла противоположный подход ChatGPT

04.02.2026 [19:13],

Сергей Сурабекянц

Anthropic объявила, что не планирует добавлять рекламу в свой чат-бот с искусственным интеллектом Claude, что резко контрастирует с подтверждёнными планами OpenAI разместить рекламу в ChatGPT. Чтобы ещё больше подчеркнуть это, компания выпустила серию рекламных роликов, высмеивающих неназванных конкурентов, добавляющих рекламу в свои ИИ. Они уже опубликованы на YouTube и будут показаны во время «Супербоула» — финальной игры по американскому футболу.

Источник изображения: Anthropic «Мы хотим, чтобы Claude действовал однозначно в интересах наших пользователей, — говорится в блоге Anthropic. — Поэтому мы сделали выбор: Claude останется без рекламы. Наши пользователи не будут видеть спонсируемые ссылки рядом с их разговорами с Claude; ответы Claude также не будут зависеть от рекламодателей или включать размещение сторонних продуктов, которые пользователи не запрашивали». Anthropic разъяснила, почему включение рекламы «несовместимо с тем, каким мы хотим видеть Claude». По мнению компании, стремление к прибыли может помешать предоставлению наиболее полезных советов пользователю и отвлекать тех, кто использует Claude для работы. Тем не менее, Anthropic не стала сжигать мосты: «Если нам потребуется пересмотреть этот подход, мы будем прозрачны в отношении причин, по которым мы это сделаем». Изменение политики Anthropic в будущем может выглядеть лицемерно в свете рекламы, выпущенной компанией для продвижения своей позиции во время «Супербоула». Это один из четырёх рекламных роликов, где очеловеченные ИИ вставляют неуместную рекламу прямо посреди своих ответов. Более короткая 30-секундная версия ролика будет показана во время игры в воскресенье, а отдельный минутный ролик с вставляющим рекламные советы во время консультации с ИИ-терапевтом, будет показан во время предматчевого шоу. Ни в одном из рекламных роликов не упоминается ChatGPT, но направленность их очевидна. В прошлом месяце OpenAI объявила о скором появлении рекламы в ChatGPT для бесплатных пользователей и пользователей более дешёвого тарифа Go, пообещав, что она будет «чётко обозначена» и расположится отдельно от ответов чат-бота. «Супербоул» — в американском футболе название финальной игры за звание чемпиона Национальной футбольной лиги (НФЛ) Соединённых Штатов Америки, в которой встречаются победители двух конференций лиги — Американской футбольной конференции и Национальной футбольной конференции. «Мне это нравится! Я смотрю видео без рекламы об искусственном интеллекте без рекламы», — прокомментировал видео один из пользователей, посмотревших его на YouTube. Google добавит в Gemini инструмент для переноса диалогов из ChatGPT и других ИИ-ботов

02.02.2026 [18:47],

Владимир Фетисов

Переключаться между чатами с разными ИИ-ботами достаточно неудобно, особенно в случаях, когда один из них накопил большую историю диалогов, настроек и знаний об индивидуальных предпочтениях пользователя за счёт анализа его ежедневной активности. Изменить это решила Google, которая начала тестирование инструмента переноса диалогов из других чат-ботов в Gemini, чтобы алгоритм сразу получал о пользователи больше данных, чем в случае обучения с самого начала.

Источник изображения: Solen Feyissa/Unsplash По данным источника, Google работает над функцией «Импорт ИИ-чатов» для Gemini, которая в настоящее время находится на этапе бета-тестирования. Доступ к ней есть у ограниченного числа пользователей Gemini. Для начала взаимодействия с этим инструментом необходимо нажать на изображение знака «+» в главном меню ИИ-бота, с помощью которого также можно добавить в чат изображения. После нажатия этого знака появится привычное меню, в которое добавлена новая опция для запуска функции «Импорт ИИ-чатов». Идея заключается в том, что пользователь может импортировать в Gemini истории своего общения с другими ботами, такими как ChatGPT или Claude. После активации опции появляется сообщение о том, что будет осуществлено скачивание истории чатов с другой ИИ-платформы. В настоящее время ни одна крупная ИИ-платформа не предлагает такую возможность, поэтому неясно, какие сервисы будут поддерживать новую функцию, и планирует ли Google дать пользователям возможность переноса чатов из Gemini в ИИ-боты конкурентов. В описании сказано, что после активации новой опции пользователь сможет загрузить свои данные в Gemini, но не указано, какой формат фалов поддерживается. Там также сказано, что загруженные данные будет сохранены, как активность пользователя в Gemini, и использованы в будущем для обучения ИИ. На какой стадии находится эта разработка, пока сказать трудно. Если все крупные платформы последуют примеру Google и разрешат импорт данных чатов для переноса в другие ИИ-боты, то это может в значительной степени упростить процесс взаимодействия с разными сервисами. Корзина для онлайн-покупок будет добавлена в интерфейс ChatGPT

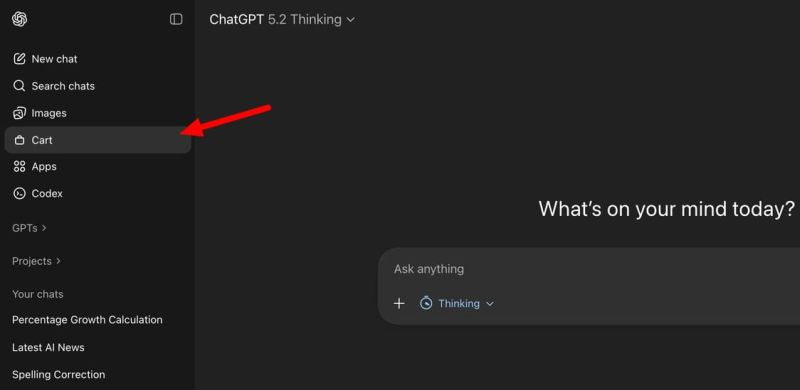

25.01.2026 [07:23],

Алексей Разин

Стремление OpenAI монетизировать услуги, предоставляемые в ChatGPT, вполне объяснимо, ведь при нынешних размерах расходов компания выйдет на безубыточность только к 2029 году. Одним из шагов навстречу светлому будущему станет интеграция инструментов для онлайн-шоппинга в интерфейс чат-бота.

Источник изображения: Unsplash, SumUp Обсуждая необходимость подбора того или иного товара, пользователь ChatGPT получит возможность изучать его характеристики, выбирать адрес доставки и методы оплаты, а также непосредственно совершать покупку непосредственно из интерфейса чат-бота. Интересующие товары можно будет просто откладывать в корзину для отложенной покупки, а также сортировать их по каким-то критериям.

Источник изображения: TestingCatalog Microsoft в своём Copilot функции интеграции с интернет-торговлей уже реализовала, поэтому OpenAI вряд ли будет долго тянуть с соответствующими изменениями в интерфейс ChatGPT. Для представителей отрасли интернет-торговли, в свою очередь, ChatGPT готов обзавестись страницей для отправки описания своих товаров. Оно потом будет использоваться в рекомендациях, которые ChatGPT даёт желающим купить определённый товар пользователям. Во временных сессиях чата также появится возможность получения персонализированных ответов ИИ-ассистента, учитывающих историю предыдущего общения с конкретным человеком. Переписка в этом разделе не будет сохраняться, но для оперативных целей её вполне можно будет использовать. Когда конкретно все описанные изменения будут внедрены в ChatGPT, не уточняется, но вряд ли OpenAI будет долго тянуть, учитывая высокую конкуренцию на рынке. В Google DeepMind удивились спешке OpenAI с внедрением рекламы в ChatGPT

23.01.2026 [12:15],

Владимир Мироненко

Гендиректор Google DeepMind Демис Хассабис (Demis Hassabis) выразил удивление поспешностью OpenAI после появления сообщений о том, что она уже перешла к внедрению рекламы в свой ИИ-чат-бот для получения дополнительного дохода от пользователей ChatGPT, у которых нет платной подписки. По его мнению, это решение может изменить восприятие сервиса пользователями.

Источник изображения: Growtika/unsplash.com «Я немного удивлён, что они так рано перешли к этому», — сказал Хассабис в интервью Axios в Давосе, вместе с тем отметив, что в рекламе нет ничего плохого, и она может быть полезной для финансирования, если «сделана хорошо». В ответ на вопрос репортёра об использовании рекламы для монетизации услуг ИИ, он заявил, что команда Google очень тщательно обдумывала эту идею. Хассабис также сказал, что его команда не чувствует давления со стороны руководства технологического гиганта, чтобы принять «поспешное» решение относительно рекламы, несмотря на важность рекламы в структуре доходов основного бизнеса Google. Хотя OpenAI, по всей видимости, вынуждена рассмотреть возможность размещения рекламы с учётом растущих затрат, это решение может изменить восприятие сервиса пользователями. В настоящее время число еженедельно активных пользователей ИИ-чат-бота составляет около 800 млн. «При использовании голосовых помощников, если вы рассматриваете чат-ботов как помощников, которые должны быть полезными, а также технологий, которые работают на вас как на отдельного человека, возникает вопрос о том, как реклама вписывается в эту модель? Вы хотите доверять своему помощнику. Так как же это работает?» — задался Хассабис вопросом. Он заметил, что что у Google нет «никаких текущих планов» по размещению рекламы в своем чат-боте с искусственным интеллектом. Вместо этого компания планирует отслеживать ситуацию, чтобы видеть реакцию пользователей. Сама идея проникновения рекламы в разговоры людей с ИИ-помощниками вызывает у них негативную реакцию. Например, когда OpenAI в прошлом месяце начала изучать функцию, предлагающую приложения для тестирования во время чатов пользователей, они отреагировали негативно, поскольку эти предложения кажутся навязчивой рекламой. После этого OpenAI отключила функцию, заявив, что предложения на самом деле не являются рекламой, поскольку «не имеют финансовой составляющей». Но речь не о платежах за рекламу. Скорее, дело в том, как предложения приложений ухудшали качество взаимодействия пользователей с чат-ботом. По словам Хассабиса, использование чат-бота — это совсем другой опыт, чем использование поиска Google. Чат-боты призваны стать полезными цифровыми помощниками, которые знают о вас и могут помочь во многих аспектах жизни, сказал он. Навязывание рекламы пользователю во время общения с ИИ-помощником может вызывать отторжение. Именно поэтому клиенты негативно отнеслись к попыткам Amazon внедрить рекламу в Alexa — им нужен помощник, а не персональный покупатель, предлагающий товары. ИИ научили писать тексты по-человечески с помощью инструкции с «Википедии»

22.01.2026 [22:29],

Анжелла Марина

Разработчик Сици Чэнь (Siqi Chen), основываясь на руководстве «Википедии» по выявлению низкокачественных ИИ-текстов, представил инструмент Humanizer, который помогает чат-ботам снижать характерные признаки машинного написания, сообщило издание Ars Technica.

Источник изображения: Bryn Young/Unsplash Плагин представляет собой пользовательский навык (custom skill) для среды разработки Claude Code от компании Anthropic и использует список, составленный волонтёрами онлайн-энциклопедии для борьбы с некачественным контентом. Согласно информации на странице проекта в GitHub, Humanizer помогает ИИ-ассистенту избежать обнаружения, путём удаления характерных маркеров, типичных для сгенерированного машинного текста. В этот список входят завуалированные ссылки на источники, рекламный стиль изложения, например, использование возвышенных эпитетов, и характерные для ботов фразы вежливости, такие как «Надеюсь, это поможет!». Устранение всех этих деталей позволит сделать текст нейросети более естественным. На странице репозитория приведены конкретные примеры работы инструмента. Humanizer способен заменить фразу с эмоциональной окраской «расположенный в захватывающем дух регионе» на фактологическую «город в регионе». Также плагин корректирует неопределённые атрибуции: вместо конструкции «Эксперты считают, что это играет важную роль» система подставляет конкретный источник, например, «согласно опросу 2019 года, проведённому…». Чэнь отметил, что инструмент будет автоматически получать обновления по мере того, как «Википедия» будет дополнять своё руководство по обнаружению ИИ. The Verge в своём материале также отмечает, что адаптация алгоритмов под критерии «человечности» — это лишь вопрос времени для разработчиков ИИ. В качестве примера издание приводит компанию OpenAI, которая уже скорректировала работу ChatGPT, устранив чрезмерное использование длинных тире, ставших одним из явных индикаторов сгенерированного контента. Anthropic представила модифицированную версию «конституции» своего чат-бота Claude

22.01.2026 [06:51],

Алексей Разин

Компания Anthropic старается уделять особое внимание пояснительной работе по поводу своей миссии и фирменных разработок типа того же чат-бота Claude, поэтому на этой неделе она опубликовала новую версию так называемой «конституции», поясняющей принципы его работы и те цели, которые преследуются в его развитии.

Источник изображения: Anthropic Документ определяет те этические принципы, которых компания придерживается при развитии Claude. Они также используются для самоконтроля чат-бота, всего так называемая «программная конституция» содержит 80 страниц и состоит из четырёх разделов, определяющих «базовые ценности» чат-бота: безопасность, этичность, соответствие миссии Anthropic и ориентация на пользу обществу. Каждый из разделов содержит описание того, как подобные принципы влияют на поведение Claude. Разработчики Claude стараются не повторять ошибок конкурентов с точки зрения этики. Например, при подозрении на наличие у пользователя психических расстройств чат-бот сразу рекомендует обратиться к специалисту, если становится ясно, что ситуация может представлять угрозу жизни и здоровью человека. Этическим вопросам уделяется больше внимания в практическом разрезе, а не на уровне теоретических рассуждений. Определённые темы изначально запрещены для обсуждения — например, создание биологического оружия. Наконец, Anthropic стремится сделать Claude максимально дружелюбным и полезным для пользователей. Обеспечение долгосрочного благополучия человека при выдаче информации чат-ботом ставится выше сиюминутных интересов. Конституция Claude при этом содержит и раздел, посвящённый философским рассуждениям разработчиков. Они задают вопросы о наличии морального статуса и сознания у Claude, подчёркивая, что они не одиноки в таких рассуждениях, и конкуренты и коллеги тоже размышляют на подобные темы. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |