|

Опрос

|

реклама

Быстрый переход

Суд в Нидерландах тоже запретил чат-боту Grok генерировать изображения реальных людей без одежды

28.03.2026 [05:58],

Алексей Разин

Казалось бы, усилиями общественности и американской системы правосудия от стартапа xAI Илона Маска (Elon Musk) удалось добиться снижения активности по созданию чат-ботом Grok изображений реальных людей без одежды. Европейские регуляторы при этом проводили собственное расследование, и недавно суд в Нидерландах официально запретил xAI сохранять соответствующие возможности Grok.

Источник изображения: Unsplash, Мария Шалабаева Если xAI не подчинится решению суда, как отмечает CNBC, ей грозят $115 000 штрафа за каждый день просрочки в реализации запретительных мер. По решению Окружного суда Амстердама, компания xAI лишается права генерировать и распространять изображения реально существующих людей без их согласия, на которых они обнажены полностью или частично. Подобное решение суда в европейской юрисдикции вынесено впервые с момента появления в чат-боте Grok подобной функции. Под запрет также попадают сгенерированные ИИ материалы с вовлечением несовершеннолетних в интимное взаимодействие. За каждый день нарушения этого запрета Grok будет штрафоваться на 100 000 евро, а максимальный штраф может достичь 10 млн евро. Истцом по делу выступала некоммерческая организация Offlimits из Нидерландов, которая защищает права несовершеннолетних при злоупотреблениях сексуального характера в онлайне. Суд также обязал xAI выплатить истцу компенсацию судебных издержек в размере 2,2 млн евро в течение 14 дней. Как отмечают представители Offlimits, технология не является лицензией на нарушение прав человека в режиме онлайн, а потому данная победа в суде важна для всей европейской общественности. По некоторым оценкам, с помощью чат-бота Grok в период с 29 декабря прошлого года по 9 января текущего было сгенерировано более 3 млн изображений людей с сексуальным подтекстом, причём более 23 000 в них фигурировали несовершеннолетние. xAI начала блокировать подобные возможности в чат-боте с января текущего года, но правозащитники утверждают, что данные меры были не до конца эффективными. Компании пришлось столкнуться с множественными судебными исками. Илону Маску данная тенденция первоначально казалась забавной, поскольку он сам опубликовал сгенерированное Grok собственное изображение в стрингах. В США судебные иски к xAI были поданы в Балтиморе и штате Теннесси. Еврокомиссия запустила собственное расследование в этой сфере в январе, к ней присоединились и британские регуляторы. В Малайзии и Индонезии доступ к Grok был блокирован после отсутствия эффективных мер по запрету генерирования подобных изображений со стороны платформы. Apple откроет Siri для сторонних ИИ — можно будет выбрать Gemini или Claude

27.03.2026 [03:30],

Анжелла Марина

Компания Apple готовит кардинальные изменения для Siri. По сообщению The Verge со ссылкой на Марка Гурмана (Mark Gurman) из Bloomberg, в обновлении iOS 27 владельцы устройств смогут самостоятельно выбирать, какую именно нейросеть использовать для генерации ответов. Новая система, получившая название Extensions, позволит подключать к Siri такие популярные модели как Gemini или Claude, по аналогии с тем, как сейчас реализована работа с ChatGPT.

Источник изображения: 9to5mac.com Согласно информации источников, функция Extensions даст пользователям iPhone, iPad и Mac возможность включать или отключать интеграцию с выбранными чат-ботами, загруженными из App Store. Предполагается, что технология будет работать не только через голосовой интерфейс Siri, но и в отдельном приложении, которое Apple планирует выпустить для «прокачанной» ИИ-версии ассистента. Улучшенная версия Siri также сможет самостоятельно выполнять действия за пользователя в различных приложениях. Напомним, в январе представители Apple подтвердили сотрудничество с Google для модернизации Siri после ряда технических неудач. Сообщается, что эта сделка также включает использование Gemini для обучения собственных небольших моделей Apple. Официальная презентация новых операционных систем и, вероятно, деталей о работе сторонних чат-ботов с Siri ожидается на Всемирной конференции разработчиков (WWDC). Мероприятие запланировано на 8 июня. OpenAI передумала развращать ChatGPT — проект ИИ-бота для взрослых отправили «в долгий ящик»

26.03.2026 [16:51],

Алексей Разин

Усилия руководства OpenAI по оптимизации бизнес-стратегии начинают определять те приоритетные направления развития стартапа, которые достойны запланированных многомиллиардных инвестиций. Вслед за неожиданным отказом от поддержки ИИ-генератора видео Sora, как отмечает Financial Times, компания решила отложить в «долгий ящик» и проект эротического чат-бота.

Источник изображения: Unsplash, Brian Lawson Прошлая публикация на эту тему позволяет понять, что темой запуска эротических ИИ-сервисов OpenAI интересуется уже на протяжении нескольких лет, и после длительных колебаний воплотить эти планы в жизнь сперва было решено до конца первого квартала текущего года, но недавно стало известно, что в этой сфере возникает задержка как минимум на месяц. Теперь Financial Times со ссылкой на осведомлённые источники заявляет, что проект эротической направленности отложен в «долгий ящик» на неопределённое время, поскольку инвесторы и сами сотрудники OpenAI выражают глубокую озабоченность его вероятными социальными и экономическими последствиями. Внутри стартапа даже высказываются мнения о необходимости полностью отказаться от идеи запуска эротического чат-бота. Растёт беспокойство связанных с OpenAI лиц по поводу усиления нездоровой атмосферы вокруг чат-бота, а также последствий получения доступа к взрослому контенту со стороны несовершеннолетних пользователей. Представители OpenAI в комментариях Financial Times подтвердили, что эротическая ИИ-модель отложена по срокам реализации на неопределённое время. Прежде чем принять какие-то решения о жизнеспособности проекта, OpenAI хочет провести глубокое исследование по поводу его возможного влияния на общество. Каких-либо эмпирических данных на этот счёт до сих пор не существует, поэтому к изучению проблемы важно подойти досконально. Кроме того, распылять ресурсы на второстепенные инициативы OpenAI сейчас не желает, предпочитая сосредоточиться на разработке ИИ-инструментов для повышения производительности умственного труда и их монетизации. По некоторым данным, самые востребованные свои инструменты создатели ChatGPT намерены объединить в мощном настольном приложении. Выпуск платформы с эротическим уклоном мог бы вызвать неоднозначную реакцию аудитории в ближайшее время, поскольку на фоне скандала с «раздевающим» людей чат-ботом Grok компании xAI внимание регуляторов к этой теме резко возросло. Выход апеллирующего к теме эротики ИИ-решения OpenAI мог бы насторожить инвесторов с учётом планируемого IPO компании. Тем более, что перспективы серьёзной монетизации такого продукта многим из них тоже кажутся сомнительными. Наконец, создание такого продукта могло бы натолкнуться на чисто технические трудности. Годами ChatGPT развивался с учётом определённых этических ограничений, а для реализации «эротического проекта» их пришлось бы выборочно снимать, причём с сохранением категорической блокировки некоторых табуируемых в обществе тем. Сохранить оптимальный баланс между жизнеспособностью такой модели и её безопасностью было бы крайне сложно. Недавно модернизированная система верификации возраста пользователей по-прежнему даёт сбой в более чем 10 % случаев. Это означает, что миллионы несовершеннолетних могли бы получить доступ к контенту для взрослых, и подобные факты повлекли бы серьёзные юридические риски для OpenAI. Половина компаний, заменивших людей ИИ-ботами, вернётся к найму персонала в следующем году

26.03.2026 [08:41],

Алексей Разин

Понятие «ИИ-отмывания» постепенно входит в оборот, когда речь идёт о попытках работодателей прикрыть сокращение персонала в силу прочих причин влиянием на бизнес искусственного интеллекта. Даже самые ярые сторонники внедрения ИИ порой склоняются к мысли, что эта тема становится удобным прикрытием для увольнения сотрудников из-за причин иного характера.

Источник изображения: Unsplash, ThisisEngineering The Wall Street Journal приводит комментарии основателя стартапа Gather.dev Питера Белла (Peter Bell), который в развитии своей компании дошёл до того, что даёт создаваемым им ИИ-агентам разные человеческие имена и придумывает для них некие жизненные условия. «Это отличная дымовая завеса, если вам нужно резко поднять чистую прибыль», — отмечает Белл, добавляя, что под предлогом внедрения ИИ собственники бизнеса могут практически безнаказанно сокращать персонал, в действительности руководствуясь иными соображениями. Специалисты в сфере машинного обучения и экономики, опрошенные The Wall Street Journal, сходятся во мнении, что именуемая искусственным интеллектом технология на нынешнем уровне своего развития не может заменить человека в масштабах большинства отраслей экономики. Даже если компании объясняют проводимые сокращения персонала внедрением ИИ, в действительности они руководствуются прочими причинами: снижением объёмов продаж, сменой приоритетов и прежним избыточным увеличением штата. Аналитики Forrester Research отмечают, что в глазах инвесторов и клиентов владельцы бизнеса выглядят лучше, когда обосновывают сокращения персонала повышением эффективности организационной структуры в результате внедрения ИИ: «Это звучит гораздо более рационально и инновационно». Подобные публичные заявления способны приводить к росту курса акций компании, инвесторам такие доводы нравятся. По имеющимся данным, в прошлом году американские работодатели уволили более 1,2 млн сотрудников. По мнению экспертов Forrester, при этом менее 100 000 из сокращённых сотрудников при этом действительно потеряли работу в результате внедрения ИИ. Специалисты, занимающиеся практическим внедрением ИИ, пока жалуются на длительность процесса интеграции соответствующих сервисов, которые нередко усложняются соображениями безопасности и прочими регуляторными ограничениями. Пройдёт немало времени, прежде чем ИИ-бот сможет заменить функции человека в бизнес-процессах большинства компаний. По прогнозам Forrester, к 2030 году 6,1 % рабочих мест на рынке США падут жертвой внедрения ИИ. Это не очень хорошо, но и не говорит о грядущем апокалипсисе. Для работодателей перспектива замены сотрудников ИИ нередко становится той «страшилкой», которая помогает держать персонал в тонусе. Подобная мотивация порой заставляет находить удачные бизнес-идеи и технические решения, которые бы в более благоприятной психологической обстановке могли бы не появиться вовсе. Аналитики Gartner считают, что половина компаний, которая уже заменила людей ИИ-ботами на линейных позициях, в следующем году вернётся к привлечению новых сотрудников. Внедрение ИИ и содержание инженеров, которые настраивают эти сложные системы, порой обходится бизнесу дороже, чем группа сотрудников, отвечающих на телефонные звонки клиентов. Тем более, что ИИ-боты нередко раздражают клиентов и им всё равно требуется связь с живым специалистом. Cloudflare: трафик интернет-ботов превысит человеческий в 2027 году

20.03.2026 [08:22],

Владимир Фетисов

Генеральный директор Cloudflare Мэттью Принс (Matthew Prince) во время конференции SXSW в Остине заявил, что боты захватывают интернет. По его мнению, объём трафика ботов на базе искусственного интеллекта превысит объём человеческого трафика к 2027 году при сохранении нынешних темпов развития отрасли.

Источник изображения: Gemini Принс рассказал, что активность ботов в интернете растёт по мере развития технологий генеративного ИИ. Это связано и с тем, что боты для формирования ответов на пользовательские запросы могут посещать гораздо больше сайтов, чем люди. «Если бы человек выполнял задачу, скажем, по поиску цифровой камеры, он мог бы зайти на пять веб-сайтов. Ваш агент или бот, выполняющий такую задачу, зачастую посетит в 1000 раз больше сайтов, чем реальный человек. Так что он может зайти на 5000 сайтов. И это реальный трафик, и это реальная нагрузка, с которой всем приходится иметь дело и которую нужно учитывать», — заявил Принс. Он также отметил, что до эры генеративного ИИ на долю ботов приходилось не более 20 % трафика, причём самым крупным из них был поисковый робот Google. При этом основная масса ботов использовалась мошенниками и злоумышленниками. «С развитием генеративного ИИ и его ненасытной потребности в данных мы наблюдаем рост, который позволяет нам предположить, что в 2027 году объём трафика интернет-ботов превысит объём человеческого трафика», — считает Принс. Он отметил, что это изменение потребует разработки новых технологий, таких как «песочницы» для ИИ-агентов, которые можно будет быстро создавать и удалять после выполнения задачи. Они могут оказаться актуальными, когда пользователи просят выполнить ИИ-агента какие-то действия от своего имени, например, спланировать отпуск. «Мы пытаемся обдумать, как построить эту базовую инфраструктуру, которая позволит вам так же легко, как открыть новую вкладку в браузере, генерировать новый код, который затем сможет запускаться и обслуживать агентов», — сказал Принс. Он также предположил, что скоро наступит время, когда миллионы таких «песочниц» для ИИ-агентов будут создаваться каждую секунду. Использование интернета ботами в таких масштабах потребует расширения физической инфраструктуры, т.е. строительства новых центров обработки данных. Принс напомнил, как во время пандемии коронавируса быстрыми темпами рос объём потребляемого трафика, особенно у видеосервисов, таких как YouTube или Netflix. Уже тогда это привело к тому, что некоторые сегменты интернета находились под угрозой падения из-за нагрузки. «Сейчас рост более плавный, но, в отличие от COVID, когда он резко вырос за две недели, а затем вышел на плато на новом уровне, мы видим, как интернет-трафик растёт и растёт, и мы не видим ничего, что могло бы его замедлить или остановить», — сказал Принс. «Я думаю, что люди не до конца осознают, что ИИ — это смена платформы. ИИ – это очередная смена платформы <…> способ, которым вы будете потреблять информацию, полностью изменится», — считает глава Cloudflare. OpenAI создаёт настольное суперприложение, объединяющее браузер, ChatGPT и Codex

20.03.2026 [08:03],

Алексей Разин

Усилия руководства OpenAI сейчас направлены на поиск приоритетных направлений развития с целью недопущения отставания от конкурентов. В рамках подобных инициатив стартап сейчас готовится создать унифицированное настольное приложение, которое объединит функции браузера, ChatGPT и ассистента для разработки программного обеспечения Codex.

Источник изображения: Unsplash, Jacob Mindak Как сообщает The Wall Street Journal, новая идея будет курироваться лично президентом OpenAI Грегом Брокманом (Greg Brockman) с точки зрения руководства реорганизацией бизнес-процессов, а недавно назначенная директором по приложениям Фиджи Симо (Fidji Simo) сосредоточится на продвижении нового суперприложения на рынке. Если в прошлом году OpenAI хваталась буквально за любую новую идею использования генеративного ИИ, чтобы в числе первых занять место в новом рыночном сегменте, то теперь компания намерена не распылять ресурсы напрасно и сосредоточиться на самом важном. OpenAI намерена создать настольное приложение с развитыми агентскими возможностями, которые позволили бы буквально выполнять работу за пользователя в самом широком спектре задач, включая создание программного кода и анализ данных. «Мы поняли, что тратили наши усилия на слишком большое количество приложений и стеков, и что нам нужно упростить свою работу. Эта фрагментация замедляла нас и затрудняла достижение того уровня качества, к которому мы стремились», — отметила Симо в рассылке для сотрудников OpenAI, которую они получили вчера. Скорее всего, появление мощного приложения для написания программного кода и анализа данных позволит OpenAI потеснить конкурирующую Anthropic в корпоративном сегменте рынка. Он позволяет максимально быстро монетизировать новые сервисы, а для OpenAI проблема выхода на прибыльность с каждым годом обретает всё более высокую актуальность. В этом месяце, как добавляет CNBC, Фиджи Симо провела общее собрание сотрудников OpenAI, на котором обозначила приоритеты в развитии на ближайшее время. По её словам, сейчас компания «агрессивно ориентируется» на области применения своих разработок, которые обеспечивают рост производительности труда. «Что для нас сейчас действительно важно, так это сохранение концентрации и качественное выполнение работы», — пояснила подчинённым Фиджи Симо. В социальной сети X она отметила, что когда новые инициативы типа Codex начинают работать, очень важно удвоить усилия по их развитию и избегать отвлекающих факторов. По всей видимости, недавняя сделка по покупке стартапа Astral также направлена на усиление позиций OpenAI в сфере автоматизации разработки ПО. В Сети всплыла «ничейная» мощная ИИ-модель — в ней заподозрили разработку DeepSeek

18.03.2026 [19:20],

Анжелла Марина

Мощная ИИ-модель без указания авторства, появившаяся недавно на платформе OpenRouter, породила слухи о том, что китайский стартап DeepSeek может в скрытом режиме тестировать свою систему следующего поколения перед официальным запуском. Бесплатная модель под названием Hunter Alpha возникла на OpenRouter 11 марта без какой-либо атрибуции разработчика и позже была промаркирована самой платформой как «скрытая модель».

Источник изображения: AI Во время тестов, проведённых агентством Reuters, чат-бот Hunter Alpha описал себя как китайскую ИИ-модель, обученную преимущественно на китайском языке, и сообщил, что его данные обучения охватывают период до мая 2025 года. Эта дата знаний совпадает с точкой, указанной собственным чат-ботом компании DeepSeek. Однако, когда собеседник спросил о создателе системы, она отказалась идентифицировать разработчика, заявив, что знает только своё имя, масштаб параметров и длину контекстного окна. Ни компания DeepSeek, ни платформа OpenRouter также не назвали создателя модели и не ответили на запросы о комментарии. Страница профиля Hunter Alpha раскрывает её внушительные технические характеристики: модель обладает 1 трлн параметров, что подразумевает высокие требования к вычислительным мощностям. Кроме того, система поддерживает контекстное окно до 1 млн токенов, позволяя обрабатывать огромные объёмы текста за один сеанс. Инженер, специализирующийся на создании ИИ-агентов, Набиль Хауам (Nabil Haouam), отметил, что сочетание окна в 1 млн токенов, возможностей логического рассуждения и бесплатного доступа сразу бросается в глаза, поскольку аналогичные по характеристикам модели обычно требуют значительных затрат при масштабировании. Именно эти значения (1 трлн параметров и 1 млн токенов контекста) связывают с грядущей моделью DeepSeek V4, чей выход прогнозируется в апреле. Совпадение породило волну слухов о том, что Hunter Alpha может быть ранней тестовой версией нового продукта китайского стартапа. Анализ модели, также проведённый инженером Дэниелом Дьюхерстом (Daniel Dewhurst), показал, что ключевым сигналом может служить паттерн цепочки рассуждений. По его словам, стиль логических построений, который использует чат-бот, очень трудно подделать, и он обычно отражает метод обучения модели. Тем не менее не все разделяют эту уверенность. Умур Озкул (Umur Ozkul), проведя независимый бенчмарк, заявил, что его анализ указывает на то, что Hunter Alpha, вероятно, не является DeepSeek V4. Он сослался на различия в поведении, связанном с токенами, и архитектурных паттернах по сравнению с существующими системами DeepSeek. Независимо от авторства модель быстро набрала популярность. Согласно статистике OpenRouter, по состоянию на воскресенье она обработала более 160 млрд токенов. Значительная часть активности исходила от инструментов разработки и фреймворков для ИИ-агентов. Отметим, что практика анонимного запуска моделей не является чем-то исключительным — это распространённый способ получения разработчиками объективной обратной связи от сообщества. DuckDuckGo добавила в Duck.ai модели GPT-5 mini и GPT-5.2 с режимом рассуждений

18.03.2026 [06:12],

Дмитрий Федоров

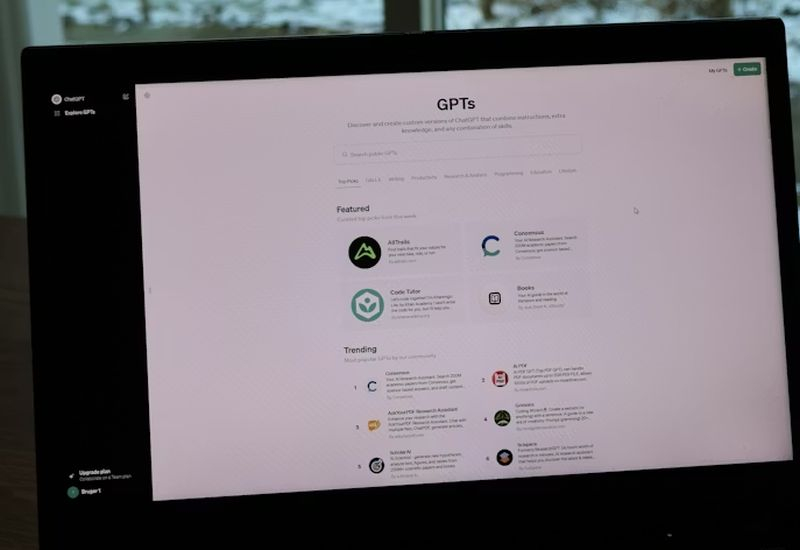

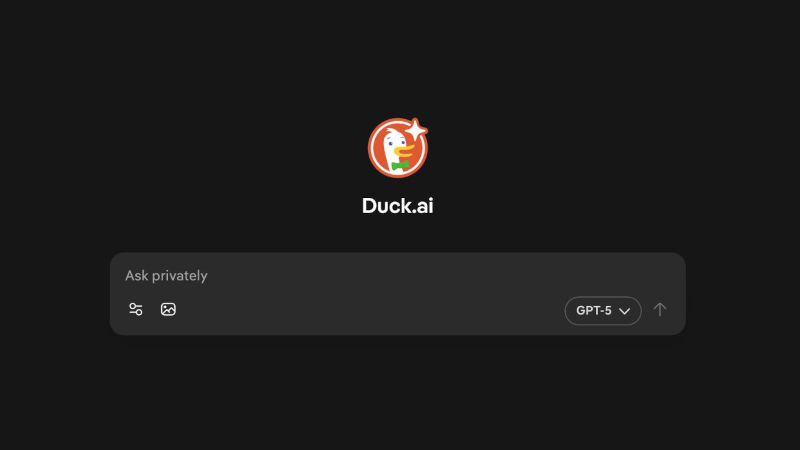

DuckDuckGo добавила в своего ориентированного на конфиденциальность ИИ-бота Duck.ai более мощные рассуждающие ИИ-модели: GPT-5 mini — для бесплатных пользователей, а GPT-5.2 — для подписчиков. Для GPT-5.2 также появился переключаемый режим рассуждений. При этом компания подчёркивает, что чаты в Duck.ai анонимизируются по умолчанию и не используются для обучения ИИ-моделей.

Источник изображений: Duck.ai Duck.ai — это платформа чат-ботов DuckDuckGo, которая предоставляет доступ к приватным разговорам с ИИ-моделями Anthropic, Meta✴✴, Mistral и OpenAI. Таким образом, сервис объединяет несколько ИИ-моделей в одном интерфейсе. За последние месяцы в сервисе появились голосовые чаты, генерация изображений, редактирование изображений и другие возможности. На этом фоне добавление новых ИИ-моделей выглядит логичным шагом. Duck.ai добавила более мощные рассуждающие ИИ-модели, включая GPT-5 mini для бесплатных пользователей и GPT-5.2 для подписчиков. Компания сообщила, что в GPT-5.2 пользователи могут включать и отключать режим рассуждения. Это связано с тем, что не каждое взаимодействие требует от ИИ-модели дополнительных «мыслительных» шагов перед ответом.  DuckDuckGo уточнила, что Duck.ai по умолчанию анонимизирует чаты. Кроме того, ни один разговор не используется для обучения ИИ-моделей. Этот принцип компания описывает как базовую характеристику сервиса. По словам DuckDuckGo, все метаданные, содержащие персональную информацию, например IP-адрес пользователя, полностью удаляются до отправки запроса поставщику модели. Следовательно, запросы к Anthropic, OpenAI и together.ai выглядят так, будто они исходят от DuckDuckGo, а не от отдельных пользователей. Компания также подчеркивает, что если пользователь отправляет в чате персональную информацию, ни DuckDuckGo, ни поставщики ИИ-моделей не могут определить, был ли этот запрос отправлен именно этим пользователем или кем-то другим. Иначе говоря, сервис отделяет содержание запроса от идентифицирующих метаданных.  DuckDuckGo напоминает, что ИИ-инструменты остаются опциональными и не связаны с её традиционной поисковой платформой. Следовательно, компания отделяет ИИ-функции Duck.ai от классического поискового сервиса. Мошенники с ИИ зарабатывают до 4,5 раза больше обычных, сообщили в Интерполе

17.03.2026 [14:52],

Алексей Разин

Как и многие изобретения человечества, так называемый искусственный интеллект поставлен на службу не только добропорядочным гражданам, но и мошенникам. Последние с помощью ИИ получают прибыль в 4,5 раза выше, чем при использовании классических приёмов обмана своих жертв, подсчитали представители Интерпола.

Источник изображения: Unsplash, Joshua Koblin ИИ не только повышает эффективность мошеннических действий, он привлекает к новым схемам всё большее количество злоумышленников. Чаще всего, по словам экспертов Интерпола, мошенники используют ИИ для устранения небольших просчётов, которые в противном случае выдали бы их истинную сущность. Например, при обращении к носителям других языков мошенники используют ИИ для устранения ошибок и погрешностей в тексте сообщений, которые могли бы насторожить потенциальных жертв. Подражание голосу кого-то из ближайшего окружения жертвы теперь тоже доверено ИИ-инструментам. Мошенникам достаточно голосового сообщения продолжительностью 10 секунд, чтобы правдоподобно сымитировать голос человека и попытаться с помощью такой подмены обмануть кого-то из его окружения. На чёрном рынке уже предлагаются целые комплексные услуги по имитации внешности и голоса людей из окружения потенциальной жертвы, поэтому мошенникам не требуется лично владеть соответствующими методами подлога для реализации своих преступных навыков. Такие услуги становятся всё более доступными, позволяя мошенникам чаще применять новые технологии в своих схемах обмана граждан. Соответственно, снижая затраты на реализацию преступного замысла, мошенник получает более высокую прибыль в случае успеха. Кроме того, количество обрабатываемых жертв также возрастает благодаря повышению производительности такого рода преступной деятельности. Сбор данных о потенциальных жертвах также поставлен на поток с помощью ИИ. Собрав всю доступную информацию о человеке из открытых источников, мошенники более ловко расставляют свои сети, чем это происходило ранее. Использование криптовалют для анонимных финансовых транзакций также позволяет преступникам избегать законного возмездия. В будущем, как считают представители Интерпола, преступники смогут ещё сильнее автоматизировать свои атаки на жертв. Сумму выкупа за похищенные данные такие преступные ИИ-агенты смогут назначать самостоятельно, а информационные ресурсы жертв будут постоянно мониториться на предмет наличия уязвимостей в системах защиты. Эксперты также выражают озабоченность растущим количеством схем вымогательства, связанных с генерацией компрометирующих жертву видео и фото деликатного характера. На реализацию таких схем работают целые организованные группы по всему миру, их количество только растёт. Организаторы буквально похищают людей в разных странах, чтобы заставлять их заниматься подобным преступным ремеслом под угрозой физической расправы. Органам правопорядка становится всё сложнее бороться с подобными группировками. Считается, что по всему миру в подобную деятельность могут быть вовлечены сотни тысяч людей. По итогам прошлого года финансовые потери от мошенничества достигли $442 млрд, по данным Интерпола, и в ближайшие несколько лет сумма будет только расти, во многом благодаря распространению ИИ. Одним только материальным ущербом жертвы мошенников не отделываются, часто страдает их репутация, социальные связи, а иногда даже речь идёт об утрате самой жизни. «Британская энциклопедия» подала в суд на OpenAI — ChatGPT почти дословно воспроизводит её статьи

16.03.2026 [21:44],

Николай Хижняк

«Британская энциклопедия» (Encyclopedia Britannica) и издатель словарей Merriam-Webster подали иск против OpenAI. Они утверждают, что компания использовала их защищённый авторским правом контент для обучения своего ИИ, а затем генерировала ответы, которые были «существенно похожи» на их контент. Об этом сообщило издание Reuters.

Источник изображения: Levart_Photographer / unsplash.com «Британская энциклопедия» утверждает, что OpenAI неоднократно копировала их контент без разрешения. «GPT-4 сама “запомнила” большую часть защищенного авторским правом контента энциклопедии и будет выдавать почти дословные копии значительных фрагментов по запросу. Запомненные примеры являются несанкционированными копиями, которые [OpenAI] использовала для обучения своих моделей, включая GPT-4», — утверждается в иске. В иске также приводятся примеры ответов моделей OpenAI рядом с текстом «Британской энциклопедии», в которых целые отрывки совпадают слово в слово. «Британника» также утверждает, что OpenAI «перетягивает» на себя её веб-трафик, генерируя ответы, которые «заменяют или напрямую конкурируют» с контентом энциклопедии, вместо того чтобы направлять пользователей на свой веб-сайт, как это делала бы традиционная поисковая система. Как пишет The Verge, это последний из растущей череды исков о нарушении авторских прав от издателей, направленных против компаний, занимающихся искусственным интеллектом, за последние несколько лет. Ранее газета The New York Times выдвигала аналогичные обвинения в своём продолжающемся судебном процессе против OpenAI, в том числе обвиняя компанию в массовом копировании её защищённого авторским правом контента. В сентябре компания Anthropic урегулировала коллективный иск об использовании защищённых авторским правом книг для обучения своих моделей ИИ, выплатив авторам книг $1,5 млрд. OpenAI отложила запуск эротических чатов в ChatGPT из-за опасений по поводу их безопасности

16.03.2026 [09:32],

Алексей Разин

Многие отрасли в своё время получили развитие, в том числе, и благодаря природному интересу человека к материалам эротического содержания, а потому сфера искусственного интеллекта не является исключением. Компании борются с соблазном использовать эротику для продвижения своих платформ, пытаясь при этом остаться в каких-то законодательных и этических рамках. OpenAI пока не готова запустить эротические чаты.

Источник изображения: Unsplash, Alexander Krivitskiy О возможности появления такого направления в работе ChatGPT ещё в середине прошлого года заявил генеральный директор OpenAI Сэм Альтман (Sam Altman). Сперва он вынашивал идею запуска функции эротических чатов к декабрю прошлого года, потом сроки перенесли на текущий квартал, но теперь становится понятно, что и этот график не будет выдержан. Как минимум, задержка с дебютом функции эротических чатов будет измеряться одним месяцем, сообщает The Wall Street Journal. Эксперименты в использовании ИИ для создания текстового контента эротического содержания OpenAI предпринимала задолго до запуска ChatGPT. Ещё в 2021 году клиентам OpenAI предлагалась игра AI Dungeon с нелинейным сюжетом, направление развития которого могли задавать пользователи. Тогда специалисты OpenAI установили, что ИИ-платформа порой предлагает игрокам обсудить темы сексуальных взаимоотношений, даже если они никак не провоцировали подобный поворот сюжета. Если же пользователь сам предлагал умеренную степень эротизма, ИИ буквально «перегибал палку» в проявлениях откровенности соответствующих бесед. OpenAI уже тогда задумалась о привлекательности подобного применения чат-ботов, но при этом осознала и необходимость введения этических ограничений. Руководство OpenAI в последнее время всё более благосклонно высказывалось в отношении идеи запуска эротических чатов, подчёркивая, что всё ограничится только текстовой информацией, без создания изображений и видео откровенного содержания. Конкуренты тоже не стоят на месте. В прошлый четверг Илон Маск (Elon Musk) заявил, что его чат-бот Grok в части генерирования видео скоро сможет создавать контент, относящийся к категории «18+». Meta✴✴ позволяет пользователям своего чат-бота вести романтические ролевые игры, но только при наличии уверенности в их совершеннолетии. У самой OpenAI с механизмами подтверждения возраста пока имеются проблемы. Сейчас профильная система в 12 % случаев ошибочно принимает подростков за совершеннолетних. С учётом наличия примерно 100-миллионной аудитории несовершеннолетних пользователей ChatGPT, такой уровень погрешности позволил бы миллионам подростков на регулярной основе получать доступ к эротическим чатам. Созванная OpenAI в январе экспертная комиссия также выразила озабоченность угрозой появления запретного с точки зрения общественной морали и законодательства контента, который подразумевает насильственные действия сексуального характера, упоминание несовершеннолетних и другие специфические сценарии. Кроме того, увлечение подобным контентом может вызывать у людей психологическую зависимость и снижать их мотивацию поддерживать взаимоотношения с реальными партнёрами в офлайне. OpenAI хочет принудительно напоминать таким увлекающимся натурам, что им следует строить отношения с реальными людьми. Это особенно важно с учётом наличия не совсем приятных инцидентов, возникших по мере распространения чат-ботов. Существуют примеры доведения людей до самоубийства в результате длительного общения с вымышленными персонажами в чат-боте, включая и подростковые суициды. Эксперты опасаются, что эротический уклон подобных бесед только спровоцирует рост количества таких случаев. В части механизмов проверки возраста пользователей у представителей OpenAI особых иллюзий нет — они, по их словам, никогда не смогут быть идеальными и в 100 % случаев рабочими. С 2021 года часть сотрудников OpenAI выражает сопротивление идее запуска эротических чатов на платформе из опасения окончательного сползания в эту сферу: «Мы не хотели быть просто компанией, распространяющей эротику». На данный момент руководство OpenAI считает целесообразным запуск эротических чатов, руководствуясь следующими принципами: «Мы всё ещё верим, что со взрослыми надо обращаться как со взрослыми, но формирование правильного опыта потребует большего времени». Anthropic научила Claude генерировать графики и таблицы прямо в чате с пользователем

13.03.2026 [07:01],

Алексей Разин

Проблемы во взаимоотношениях с американскими властями не мешают Anthropic продолжать совершенствование своего чат-бота Claude. После недавнего обновления он научился автоматически вставлять в диалоговом окне иллюстрации, позволяющие проще объяснить суть доводимой до пользователя информации. Графики, таблицы и диаграммы могут создаваться и по прямому запросу со стороны пользователя.

Источник изображения: Anthropic Ранее они возникали в боковой панели Claude, как отмечает The Verge, а теперь будут вставляться прямо в диалоговом окне. Самое примечательное, что графики, таблицы и диаграммы при этом могут быть интерактивными. В частности, периодическая таблица химических элементов будет отображаться таким образом, что нажатие на каждый из элементов позволит вывести дополнительную информацию о нём. Чат-бот Claude способен сам предугадывать, когда лучше сопроводить свой ответ интерактивной иллюстрацией, но по запросу пользователя он может сделать это в любой момент. Конкурирующие платформы подобными возможностями уже обзавелись. Например, OpenAI позволяет ChatGPT вставлять в диалог с пользователем интерактивные иллюстрации к математическим задачам и научным обсуждениям, а Google Gemini создаёт интерактивные иллюстрации для образовательных целей. Ранее подобный инструментарий был доступен пользователям Claude через боковую панель. Она сохранит соответствующую функцию, а вот иллюстрации из диалога с пользователем будут исчезать вместе с их завершением. В случае необходимости Claude сможет вносить изменения в уже созданные интерактивные иллюстрации. Новая функция доступна всем категориям пользователей Claude и по умолчанию изначально активна. Пользователи X теперь могут запретить чат-боту Grok менять свои фотографии

10.03.2026 [06:05],

Алексей Разин

Стартап xAI и социальная сеть X объединились ещё до того, как стали частью SpaceX, а взаимная интеграция двух первых элементов империи Илона Маска (Elon Musk) предусматривалась и ранее. Желая создать у пользователей X иллюзию своего рода приватности, разработчики теперь позволили им блокировать использование загружаемых изображений чат-ботом Grok.

Источник изображения: Unsplash, Мария Шалабаева По крайней мере, в приложении X для iOS появился пункт интерфейса, который на этапе загрузки изображения позволяет пользователю предотвращать дальнейшую его модификацию силами Grok. Предполагается, что пользовательские фотографии, загруженные в X с подобной меткой, не будут использоваться Grok для выполнения запросов других пользователей, которые потребовали бы применения данного изображения для дальнейшей модификации. По сути, функция должна предотвратить использование клиентского контента для «раздевания» людей, изображённых на фото. В ответ на скандальные истории с массовым «раздеванием» людей X лишила бесплатных пользователей социальной сети возможности делать подобные запросы, но владельцы подписок могут пользоваться данной функцией по-прежнему. Ирония заключается в том, что новая возможность запрета модификации пользовательских изображений чат-ботом Grok не так легко обнаруживается при загрузке. Она спрятана в глубине интерфейса и может быть не замечена неосведомлённым пользователем. Кроме того, статус нельзя применить к уже загруженным ранее изображениям. Считается, что запрет на редактирование не даёт и владельцам платных учётных записей модифицировать загруженные другими пользователями изображения. Фактически же остаются обходные пути, позволяющие посторонним лицам редактировать изображения других пользователей X. Прежде всего, их можно модифицировать через встроенный редактор изображений. Во-вторых, если сохранить чужое изображение и тут же его загрузить от своего имени без соответствующего запрета, то его уже можно будет модифицировать без каких-либо ограничений. Формально X не заявляла о запуске новой функции, поэтому она может оставаться экспериментальной и не работать в полной мере. OpenAI отложила запуск «режима для взрослых» в ChatGPT — нужно решить проблему определения возраста

07.03.2026 [22:13],

Владимир Фетисов

В конце прошлого года OpenAI объявила о намерении запустить в ChatGPT «режим для взрослых» в первом квартале 2026 года, но, по всей видимости, ждать этого пользователям придётся дольше. По сообщениям сетевых источников, компания откладывает запуск функции, позволяющей генерировать контент для взрослых с помощью ИИ-бота.

Источник изображения: unsplash.com В сообщении сказано, что OpenAI хочет добиться большего прогресса в улучшении алгоритмов определения возраста пользователей, чтобы не допустить ситуаций, когда «режим для взрослых» доступен несовершеннолетним. В начале года компания начала использовать инструменты прогнозирования возраста, которые анализируют разные факторы, такие как давность создания аккаунта и особенности его использования для определения реального возраста пользователей. «Мы по-прежнему верим в принцип отношения к взрослым как ко взрослым, но, чтобы сделать пользовательский опыт действительно качественным, потребуется больше времени», — прокомментировал данный вопрос представитель OpenAI. Он также добавил, что компания откладывает запуск «режима для взрослых» в ChatGPT, чтобы «сосредоточиться на работе, которая в данный момент является более приоритетной для большего числа пользователей», в первую очередь, на улучшении характеристик нейросети. Гендиректор OpenAI Сэм Альтман (Sam Altman) впервые намекнул на «режим для взрослых» в ChatGPT в октябре 2025 года. Тогда же он упомянул изменения, которые позволят пользователям сделать так, чтобы ChatGPT действовал «очень похоже на человека». Осторожность OpenAI с запуском «режима для взрослых» выглядит вполне логичной. Компания уже сталкивается с многочисленными исками из-за нескольких случаев суицида и причинения себе вреда пользователями после длительно общения с ИИ-ботом. На охоту за недорогими модулями DDR5 вышли боты, управляемые спекулянтами

03.03.2026 [08:20],

Алексей Разин

Апокалиптические сценарии по порабощению человека искусственным интеллектом, возможно, останутся в фантазиях голливудских сценаристов, но в реальной жизни человеку уже приходится бороться за ресурсы с ИИ. По крайней мере, он уже используется для скупки модулей памяти, необходимых для развития собственной вычислительной инфраструктуры.

Источник изображения: Micron Technology Исследователи Galileo, на которых ссылается TechRadar, установили, что программные боты в шесть раз чаще людей обращаются к страницам интернет-магазинов, на которых можно заказать модули памяти типа DDR5. Подобная активность редко приветствуется продавцами, в ходе одной из кампаний было заблокировано более 10 млн запросов, исходящих от ботов. Контрольная выборка показала, что за один час боты сделали 50 000 обращений к 91 страницам интернет-магазинов с предложениями купить DDR5. Каждая страница опрашивалась ими в течение часа в среднем 551 раз, что соответствует одному запросу каждые 6,5 секунд. Ассортимент предложений, охватываемых ботами, простирается от оснащаемых красочными радиаторами и RGB-подсветкой модулей DDR5 до планок памяти промышленного назначения. Фактически, боты используются даже для мониторинга отдельных компонентов, предназначенных для производителей материнских плат — например, самих разъёмов DIMM. Опросы осуществляются круглосуточно с небольшими перерывами, вызываемыми техническими сбоями. В таких условиях у живых покупателей остаётся меньше шансов приобрести желаемые модули памяти по адекватной цене. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |