⇣ Содержание

|

Опрос

|

реклама

Самое интересное в новостях

ИИ и роботы в 2023-м: от Сивиллы до Q-Star

В 2017 г. исследователи из университетов Оксфорда и Йеля опубликовали сводный прогноз по темпам развития искусственного интеллекта, опросив более 350 маститых экспертов по этой тематике и усреднив затем полученные ответы. Обладая нынешним послезнанием, можно утверждать, что учёные и инженеры формулировали свои предсказания не только крайне осторожно (в среднем), но и со значительным разбросом ожидаемых достижений ИИ по временнóй шкале. Так, машинный разум, согласно этому обобщённому мнению, должен будет превзойти биологический в следующих областях:

В целом, полагали опрошенные, существует 50%-ная вероятность того, что ИИ станет уверенно выполнять вообще все задачи, ныне решаемые людьми, в течение ближайших 45 лет (считая от 2017-го, напомним) и что через 120 лет на планете в принципе не останется неавтоматизированных занятий, которые кожаные мешки смогли бы эксклюзивно сохранить за собой («Вы что же, и есть за меня будете?!» — «Ага…»). Реальность, как это нередко бывает в ИТ-отрасли, не пожелала подчиняться экспертным прогнозам. Стремительный взлёт именно генеративного ИИ, который шесть лет назад был лишь одним из множества подходов к машинному обучению, явно ускорил прогресс по творческим, если так можно выразиться, направлениям. Чат-боты к исходу 2023-го неплохо справляются и с написанием вполне убедительных курсовых работ, и с расширением/углублением воронки продаж в ретейле, и с переводами, в том числе с голоса и голосом же (синтезируемым компьютерной системой также в режиме реального времени). Да, пока машина не выполняет все эти задачи заведомо лучше наугад взятого специалиста в данной конкретной области, — но немало опасений у представителей творческих профессий она на протяжении года уже успела вызвать. Да и не у них одних!

Поскольку формы американского судопроизводства устойчиво консервативны, нам не удалось получить из недалёкого будущего фотоснимок выступающего на процессе робота-адвоката, — только вот эту зарисовку (источник: ИИ-генерация на основе модели SDXL 1.0) ⇡#ЯнварьРобота-адвоката не пустили в суд. Американский стартап DoNotPay, ещё в 2015-м разработавший приложение, что позволяет клиентам быстро решать в свою пользу шаблонные юридические вопросы — опротестовывать выписываемые полицией штрафы за неправильную парковку, например, или без комиссий прекращать надоевшие подписки,— решил пойти дальше и предложил 1 млн долл. США тому, кто осмелится доверить свою защиту в суде созданному этой же компанией ИИ-адвокату. Но пока безуспешно: американское судопроизводство сложно относится к технике в зале заседаний (потому, к примеру, репортёры не могут использовать ни фото-, ни видеокамеры), так что задача чисто технически представлялась непростой, — не говоря уже о беспокойстве насчёт того, насколько хорош окажется действующий на базе GPT-3 бот-юрист и кому предъявлять претензии, если дело в суде он всё-таки проиграет. Благосклонная Сивилла. Исследователи из Массачусетского технологического института в сотрудничестве со специалистами больницы общего профиля того же города разработали модель глубокого обучения Sybil для предсказания риска наличия у пациента ранних стадий рака лёгких — наиболее смертоносного среди всех разновидностей этого крайне неприятного типа заболеваний. Важное достоинство этой разработки — в способности определять с высокой точностью значительный риск развития рака в перспективе до 6 лет на основании одной-единственной процедуры КТ с низкой дозой контраста (Low Dose Contrast CT, LDCT). ⇡#ФевральУскорили в миллион раз. Выступая перед акционерами с очередным квартальным отчётом, глава NVIDIA Жэньсюнь Хуан (Jensen Huang) с оптимизмом заявил, что импульс, полученный ИИ-разработками за последнее время, имеет все шансы сохраниться по меньшей мере на десятилетие, — учитывая уже набранный темп: «Закон Мура в лучшие времена обеспечивал стократный прирост [производительности вычислений] за 10 лет. Предложив новые процессоры, новые системы, новые межсоединения, новые фреймворки и алгоритмы, а также взаимодействуя со специалистами по обработке и анализу данных, с ИИ-исследователями, работающими над новыми моделями, — словом, продвигаясь сразу по всем направлениям, — мы добились того, что сегодня большие языковые модели исполняются в миллион раз быстрее, чем 10 лет назад».

Примеры изображений, генерируемых на Android-смартфоне оптимизированной моделью Stable Diffusion 1.5 по подсказке «Super cute fluffy cat warrior in armor, photorealistic, 4K, ultra detailed, vray rendering, unreal engine» (источник: Qualcomm) Котики на ладони. На очередной выставке MWC в Барселоне компания Qualcomm первой в мире продемонстрировала, как на мобильном телефоне (на базе системы-на-кристалле Snapdragon 8 Gen 2) под управлением Android генеративная модель Stable Diffusion 1.5 более чем с 1 млрд параметров не просто запускается, но справляется с созданием изображения по текстовой подсказке менее чем за 20 с. Правда, модель пришлось несколько урезать, поменяв точность представления чисел в ней с изначальной FP32 на INT8, а также иными способами дооптимизировать. Так что по качеству сгенерированные на смартфоне изображения сопоставимы, скорее, с творениями ранних версий Dall-E, чем с картинками, что получают сегодня энтузиасты на стационарных ПК с применением той же SD 1.5. Однако лиха беда начало — нет сомнения, что уже следующее поколение мобильных платформ окажется куда более пригодно для локального исполнения генеративных моделей, чем типичный ноутбук наших дней. Одомашненные LLM. Компания Meta[1] представила в феврале целый выводок генеративных языковых моделей семейства LLaMA — на 7, 13, 33 и 65 млрд параметров. Ориентированы они прежде всего на разработчиков-энтузиастов в области ИИ, не имеющих доступа к солидным вычислительным мощностям, и лицензируются бесплатно, по запросу, — для некоммерческого использования в исследовательских целях. Две старшие модели натренированы на массиве в 1,4 трлн токенов, самая младшая — в 1 трлн, причём на токены были разобраны тексты на 20 наиболее распространённых в мире языках — преимущественно тех, что полагаются для записи слов на латиницу или кириллицу. По заверению разработчиков, LLaMA-13B превосходит GPT-3 на большинстве протестированных бенчмарков, а LLaMA-65B сопоставима с такими коммерческими платформами, как DeepMind Chinchilla-70B и Google PaLM-540B. Без гитары, но с поиском. В начале февраля Google анонсировала Bard AI — экспериментальный сервис для коммуникаций с пользователями на естественном языке, базирующийся на собственной большой языковой модели компании, LaMDA (Language Model for Dialogue Applications). Изначально ставший доступным для избранного круга тестировщиков, этот сервис на первых порах выдавал довольно неоднозначные результаты — вплоть до бодрой генерации откровенной (на человеческий взгляд) чепухи по 8 из 10 предложенных тем. Но и Москва не сразу строилась: на протяжении всего года Google продолжала упорно совершенствовать свой ответ ChatGPT, и после того, как в основу его была положена языковая модель Gemini (см. раздел «Декабрь»), доля «галлюцинаций» в выдачах Bard AI заметно снизилась.

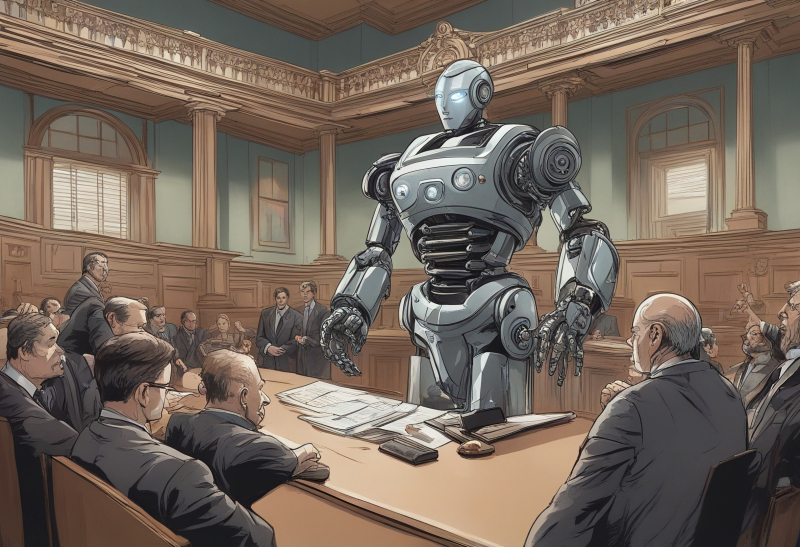

Кадр из видеоролика с демонстрацией управляемого мультимодальным генеративным ИИ робота (источник: Technical University of Berlin) ⇡#МартРисовые чипсы и мультимодальность. Поиграв вволю несколько месяцев с ChatGPT, исследователи в области ИИ лишь крепче утвердились в понимании того, что «узкие» модели для решения ограниченных задач — даже такие сложные, как GPT-3 с её 175 млрд параметров, — хотя и неплохо имитируют разумное поведение, но в полной мере «интеллектуальными» называться не могут. Будущее, безусловно, за «сильным» ИИ (СИИ; artificial general intelligence, AGI) — таким, который сможет решать не встречавшиеся ему ранее (ни в виде алгоритмов, ни в наборе обучающих данных) задачи, находя для этого неведомые ему прежде способы. Логичным шагом в направлении создания СИИ представляется объединение мультимодальных моделей (сочетающих визуальный и лингвистический контуры) с роботизированными системами, которые могут сами изучать реальный мир, а не просто получать информацию о нём в виде наборов данных. Именно такую составную платформу под названием PaLM-E и предложила команда разработчиков из Google и из Технического университета Берлина, скрестив мультимодальную ИИ-модель на 562 млрд параметров с мобильным роботом-манипулятором — и получив устройство, способное адекватно реагировать на команды на естественном языке вроде «Принеси мне пакетик рисовых чипсов из вон того ящика», увязывая тем самым воедино слова, образы и действия. В своём отчёте исследователи утверждают, что платформа уже демонстрирует «позитивный перенос» (positive transfer), применяя полученные при решении прежних задач знания и навыки, чтобы увереннее справляться с последующими. Доктор на 85,4%. Разработанная Google ещё в апреле 2022-го проприетарная большая языковая модель PaLM (Pathways Language Model) спустя почти год после запуска первой своей версии была использована для создания Med-PaLM 2 — специализированного на вопросах медицины и, шире, здравоохранения бота-консультанта. Если предыдущие аналогичные системы (GPT-Neo, Galactica, PubMed GPT и пр.) успешно отвечали на 30-50% задаваемых им на естественном языке вопросов из стандартного списка, по которому экзаменуют медиков биологической природы, то уже первая Med-PaLM показала на этом испытании результат 67,2%, а анонсированная в марте Med-PaLM 2 — целых 85,4%. Хотя разработчики с гордостью отчитались об этом достижении, речи о предоставлении открытого доступа к боту-медконсультанту пока не идёт — слишком туманны легальные последствия его возможных ошибок.

Пример того, как GPT-4 справляется с нетривиальной для «узкого» ИИ задачей — пояснить, чем забавна предложенная модели для изучения картинка (источник: OpenAI) Четвёрочка! Если ноябрь 2022-го стал крупной вехой в истории развития ИИ благодаря запуску компанией OpenAI бота ChatGPT на базе большой языковой модели GPT-3.5, то март 2023-го ознаменовался открытием доступа к Generative Pre-trained Transformer 4 (GPT-4) — которая уже способна, к примеру, выдерживать экзамен на адвоката в юридической школе, да не просто набирая проходной балл, а оказываясь в 10% лучших среди биологических участников этого испытания. Для сравнения: GPT-3 попадала со своими ответами в 10% худших экзаменуемых. Мультимодальная «Четвёрочка» оперирует текстами объёмом до 25 тыс. слов (GPT-3.5 — максимум 3 тыс., GPT-3 — 1,5 тыс.), генерирует и анализирует программный код на наиболее популярных языках, способна внятно описывать, почему та или иная картинка может представляться смешной, создаёт веб-сайты (с HTLM и JavaScript) по рукописному наброску их предполагаемой функциональности и в целом проявляет себя более чем достойно — хотя к СИИ по-прежнему не относится. Разработчики также позаботились о том, чтобы модель стала, в их понимании, безопаснее: она «на 82% менее склонна удовлетворять запросы на запретный контент и на 40% твёрже придерживается фактов в своих ответах, чем GPT-3.5», — заявили в OpenAI, основываясь на результатах внутренних испытаний. А 188 Гбайт вам хватит? Начиная с мая 2020 г. самым популярным «железом» для серьёзных ИИ-разработчиков была серверная видеокарта NVIDIA A100 с тензорными ядрами (Tensor Cores), специально оптимизированными для операций перемножения матриц — ключевых для задач глубокого машинного обучения. В марте 2022-го появился ещё один серверный ИИ-ускоритель того же вендора, H100, — с изготовленным по «4-нм» технологической норме ГП на 80 млрд транзисторов (в A100 их насчитывается 54,2 млрд) и до 80 Гбайт видеоОЗУ на карту. Теперь же, в марте 2023-го, NVIDIA анонсировала модифицированную версию — H100 NVL (по сути, пара H100, соединённых мостиками NVLink, но с рядом доработок) с 94 Гбайт памяти, допускающую вдобавок работу в спарке — с общим объёмом ОЗУ 188 Гбайт и с предельной пропускной способностью 7,8 Тбайт/с против 3,35 Тбайт/с для ранних H100. Сервер, укомплектованный восемью H100 NVL, в среднем двенадцатикратно превосходит по скорости исполнения GPT-3 аналогичную систему с тем же количеством A100.

В чём в чём, а в самоиронии нынешней Microsoft не откажешь: в 2022 г. её официальную коллекцию «уродливых Windows-свитеров» (Windows Ugly Sweater) пополнил экземпляр со старой доброй Скрепкой (источник: Xbox Gear Shop) «Скрепка» на стероидах. На сей раз компания, создавшая самую распространённую в мире операционную систему, решила, судя по всему, не повторять прежних ошибок вроде недооценки поисковых машин или смартфонов — и оседлать горячую тему искусственного интеллекта как можно более плотно, интегрировав умного помощника Microsoft 365 Copilot (базирующегося, кстати, на GPT-4) прямиком в приложения и сервисы платформы Microsoft 365. Олдфаги неизбежно примутся сравнивать «Второго пилота» со «Скрепкой», терроризировавшей пользователей MS Office 97 и 2003, однако в своей ИИ-инкарнации этот помощник в целом оказывается вполне полезным: согласно проведённому на GitHub опросу, 88% его пользователей отметили увеличение собственной продуктивности после того, как стали регулярно взаимодействовать с Copilot, а 77% благодаря ему тратят ощутимо меньше времени на поиск нужной информации. Торопиться не надо! Более 1200 видных учёных и бизнесменов ИТ-отрасли подписали в марте нашумевшее открытое письмо на сайте Future of Life Institute — с призывом немедленно приостановить работы над дальнейшим развитием генеративных ИИ-моделей с тем, чтобы здраво и без спешки оценить потенциальные риски для человечества с их стороны. Ещё в 2017 г. на конференции Beneficial AI были сформулированы т. н. Асиломарские принципы, поддержанные среди прочих Стивеном Хокингом (Stephen Hawking), Илоном Маском (Elon Musk), Сэмом Альтманом (Sam Altman), которые утверждают, что «развитой ИИ может коренным образом изменить всю историю развития жизни на Земле, и потому необходимо тщательно планировать разработки по этому направлению, выделяя для этого соразмерные усилия и ресурсы». Однако в гонке генеративного ИИ, что развернулась сразу после оглушительного успеха ChatGPT в конце 2022 г., оценка последствий и проработка механизмов безопасности — едва ли не самое последнее, что заботит разработчиков. Подписанты открытого письма уверены, что мощные современные ИИ-системы, не говоря уже о перспективном СИИ, должны доводиться до стадии реализации только после скрупулёзной проверки того, что эффекты от их внедрения окажутся сплошь положительными для человечества, а возможные риски будут уверенно и быстро купироваться. По мнению ряда экспертов, высказанному в марте, если не взять паузу по меньшей мере в 6 месяцев, к концу 2023-го уже могла бы появиться, условно, модель GPT-5 со всеми признаками СИИ, — но к прямому взаимодействию с полноценным искусственным разумом явно не готовы ни ИТ-отрасль, ни юристы, ни политики, ни общество в целом.

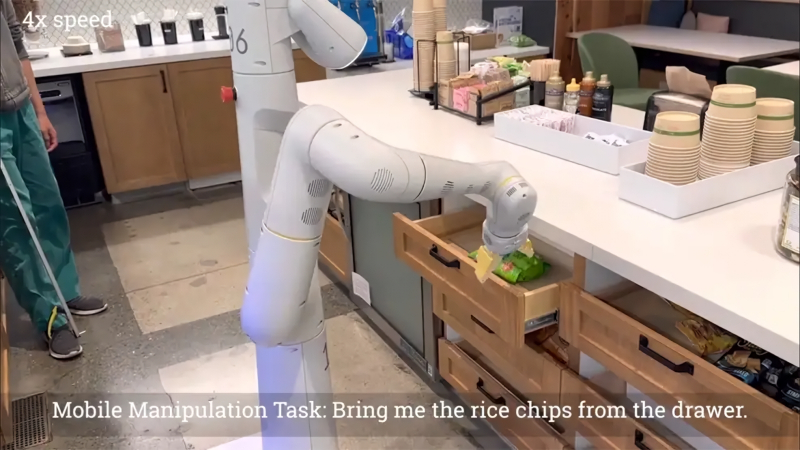

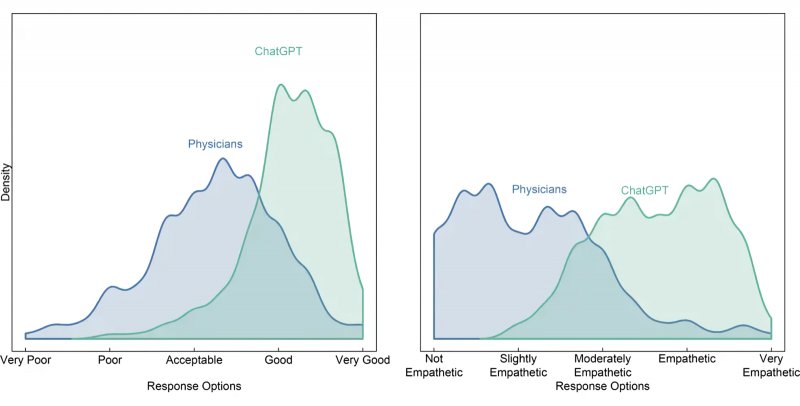

Скриншот тестовой сессии с ChatGPT, которому посредством плагина была предоставлена возможность заглянуть в Интернет для получения актуальных данных (источник: OpenAI) Печать ограничений снята. OpenAI добавила в интерфейс ChatGPT поддержку плагинов — и одновременно в тестовом режиме открыла своему культовому чат-боту доступ в Интернет, тогда как ранее доступная ему база данных, хотя и достаточно обширная, не содержала упоминаний о событиях, произошедших после 2021 года. Сочетание этих возможностей позволяет применять ChatGPT, например, для регулярного составления дайджестов обновлений того или иного сайта, следить за которым лично у пользователя нет времени, или для составления сложного маршрута путешествия с подбором отелей и бронированием билетов. Финальные действия по подтверждению личности и оплате человеку придётся произвести, конечно же, самому, но умный чат-бот благодаря интеграции с соответствующими веб-API уже проделает за него всю предварительную рутинную работу — в том числе по корректному заполнению нужных полей. ⇡#АпрельHouse A. I. Кто точнее поставит диагноз и притом более сочувственно отнесётся к волнениям и страхам пациента — человек или бот? Статья в The Journal of the American Medical Association даёт совершенно однозначный ответ: ChatGPT. Исследователи из Университета Калифорнии в Сан-Диего (UCSD) отобрали в Интернете около двух сотен вопросов на медицинские темы и сравнили, как отвечают на них чат-бот и живой практикующий терапевт. Оценке подвергалась не только фактическая корректность ответов, но и эмоциональная их окрашенность по шкале от «безразлично» до «с огромным сочувствием». Вывод в статье сформулирован крайне нелестно для биологических эскулапов: «Усиленная средствами ИИ забота [о пациенте] — вот будущее медицины». Консультации ChatGPT и оказались более точными, детализированными, персонифицированными, — да вдобавок ещё и формулировались в среднем с демонстрацией куда более заметной эмпатии к пациенту, чем человеческие.

Графики из исследования группы учёных из UCSD явно демонстрируют превосходство ИИ над рядовым терапевтом: слева — по качеству данных на жалобы пациентов ответов, справа — по проявленной в ходе беседы эмпатии (источник: JAMA) Как скала. Новый сервис Amazon Bedrock стал доступен пользователям AWS, для начала — в тестовом режиме; полнофункциональный его запуск состоялся лишь в сентябре. Это не генеративная модель сама по себе, но удобно интегрированная в облачную инфраструктуру возможность экспериментировать с различными моделями — разработанными такими партнёрами AWS, как AI21 Labs, Anthropic, Cohere, Stability AI и, конечно же, ИИ-подразделением самой Amazon, — дотренировывая их с применением собственных данных и создавая программные агенты для выполнения различных узких задач. Робот детям не игрушка, а учитель. Билл Гейтс (Bill Gates), выступая на саммите в Сан-Диего, крайне высоко оценил преподавательский потенциал ИИ, заявив, что умные чат-боты готовы учить детей чтению и письму и что уже в ближайшие 18 месяцев способности искусственного интеллекта в этой области сравняются с достижениями любого биологического учителя. А внутре у ней NeONKA. «Сбер» представил публике мультимодальную нейросетевую модель GigaChat — которая, как и её заграничные аналоги, способна поддерживать диалог на естественном языке, пишет программный код, а также создаёт тексты и картинки по заданным подсказкам в рамках общего контекста (иллюстрированные повествования). Ядром GigaChat стал нейросетевой ансамбль NeONKA — Neural Omnimodal Network with Knowledge-Awareness, а созданием изображений заведует модель Kandinsky 2.1.

Фотохудожник и его шедевр (источник: фон — ИИ-генерация на основе модели SDXL 1.0; само фото — Sony World Photography Awards) Подавайте сюда мой приз, кожаные мешки! Германский фотограф Борис Эльдагсен (Boris Eldagsen) отказался забирать присуждённый ему в состязании Sony World Photography Awards приз в категории «creative open», поскольку заслуживший признание представленного биологическими носителями разума жюри портретный снимок оказался сгенерирован ИИ-моделью. Что лишний раз показало, какого уровня совершенства достиг генеративный ИИ в имитации художественных и вместе с тем фотографически достоверных изображений людей. Играть станет ИИнтереснее. Какими окажутся игры не слишком отдалённого будущего, можно представить по итогам проведённого исследователями Стэнфорда эксперимента. Они, грубо говоря, обучили ChatGPT играть в The Sims, создав интерактивную «песочницу», населённую двадцатью пятью управляемыми ИИ аватарами, каждый из которых симулировал высокоперсонализированное поведение. Как отмечается в отчёте, «они просыпались, готовили завтрак, отправлялись на работу; художники писали картины, писатели выдавали тексты; они составляли собственное мнение о происходящем вокруг, затевали разговоры, обсуждали пережитые события; они помнили о том, что было вчера и пару дней назад, — и планировали свои действия на завтра». ⇡#МайПоехалИИ! В Шотландии, на трассе протяжённостью 14 миль (23 км) между округом Файф и Эдинбургом, начал действовать первый в мире регулярный автономный автобусный маршрут, обеспечивая перевозку до 10 тыс. пассажиров в неделю со скоростью до 50 миль в час. Строго говоря, пять автобусов на маршруте соответствуют лишь четвёртому уровню автономности, т. е. в кабине постоянно находится водитель, готовый при нештатной ситуации взять управление на себя. Это первая практическая реализация долгосрочной британской программы CAVForth (CAV — от «connected autonomous vehicles»), стартовавшей ещё в 2019-м. Хотя самоуправляемые автобусы в тестовом режиме и/или на ограниченное время (в Олимпийской деревне в Токио в 2021 г., например) запускают уже несколько лет, именно регулярных маршрутов такого рода ранее не встречалось.

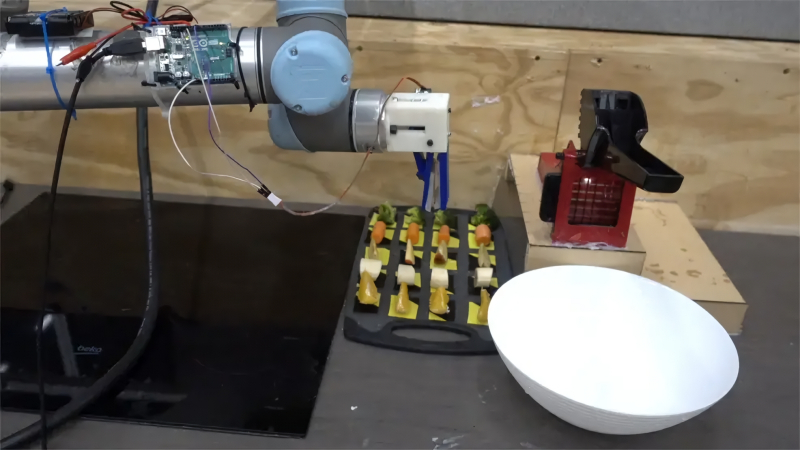

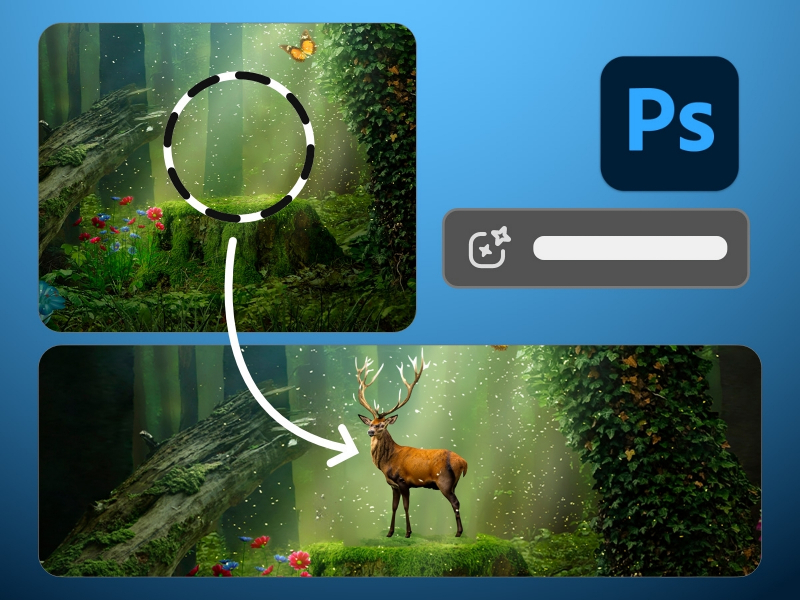

Нож управляемому ИИ роботу-манипулятору исследователи не доверили — в ходе нарезки ингредиентов система обходилась заведомо безопасным приспособлением для превращения картофелин в брусочки (источник: University of Cambridge) Видеоуроки для робоповара. Команда из Кембриджского университета создала самообучаемый — точнее, дообучаемый, освоивший технику incremental learning, — ИИ, способный по созданным людьми для людей видеороликам готовить неизвестные ему прежде блюда, а затем с применением роботизированного манипулятора воплощать полученные навыки в жизнь. Исследователи взяли довольно простую модель, обученную распознавать различные фрукты и овощи, записали несколько видеоинструкций по приготовлению из них человеком несложных салатов, прогнали через нейросеть — и система усвоила последовательность необходимых в каждом случае действий. Затем ИИ продемонстрировали ролик с приготовлением нового для неё салата — и робот-повар, задействовав манипулятор, успешно воссоздал его из предложенных ингредиентов. Предотвратить, возглавив. В первые месяцы бурной шумихи вокруг генеративных моделей, создающих изображения на основе текстовых подсказок, особенно громко высказывались биологические художники — не все подряд, конечно, — которых возмущал сам факт обучения машины на накопленном человечеством к тому времени массиве картин, иллюстраций, фотоснимков и прочих картинок. Однако начиная с марта накал этого возмущения спал — во многом потому, что безусловно культовая в художественных кругах компания Adobe интегрировала во всё семейство своих программных инструментов для цифровой обработки и создания изображений генеративное ИИ-средство Firefly — на тот момент в бета-версии; коммерческий релиз состоялся лишь в сентябре. Обученный на огромном массиве данных (включая принадлежащий компании обширный цифровой архив), Adobe Firefly позволяет творцу формулировать на естественном языке свои пожелания — и в соответствии с ними меняет или дополняет его художественное творение (не только статичную картинку!), причём без необходимости вручную возиться с установкой и тонкой настройкой самой модели, как это приходится делать пользователям локальных инсталляций Stable Diffusion.

Инструмент Generative Fill в обновлённом Photoshop позволяет органично внедрять в изображение элементы, которых там исходно не было (источник: Adobe) ⇡#ИюньГенеративная редегенерация. В условиях снижения рождаемости и роста продолжительности жизни в развитых странах всё более остро поднимаются вопросы борьбы со старением — точнее, с его биологическими последствиями для организма. Одно из направлений такой борьбы — ликвидация сенесцентных, или стареющих, клеток: таких, которые, прекратив делиться, продолжают оставаться метаболически активными — и потому накапливают в себе, а затем и испускают в окружающую среду вредные для организма вещества. Именно такая активность сенесцентных клеток ответственна хотя бы частично, уверены учёные, за развитие сердечно-сосудистых заболеваний, болезни Альцгеймера, различных видов рака. Однако традиционными методами биохимических исследований крайне непросто подобрать препарат, который бы обезвреживал сенесцентные клетки безопасно для окружающих их нормальных. Исследователи из Эдинбургского университета опубликовали в Nature Communications отчёт о созданной ими системе машинного обучения, которую натренировали распознавать ключевые характеристики химикатов, выделяемых стареющими клетками, а затем использовали для гипотетического синтеза веществ, способных безопасно связывать эти химикаты и прекращать активность сенесцентных клеток. Проведённые затем эксперименты с предложенными ИИ-системой молекулярными структурами показали действенность и безопасность трёх из предложенных 21 соединения — в частности, олеандрина, в природе содержащегося в ядовитом (хотя и культивируемом в декоративных целях) растении олеандр. Таким образом в очередной раз была продемонстрирована эффективность систем машинного обучения для подбора химических веществ — кандидатов в лекарственные препараты с заранее заданными свойствами. Дело на триллион. Точнее, июньское исследование McKinsey оценивает ежегодный оборот мирового рынка генеративного ИИ на среднесрочную перспективу в диапазоне от 2,6 до 4,4 трлн долл. США. В эту сумму включены операции конечных пользователей (плата за «продвинутые» тарифные планы сервисам вроде ChatGPT и Midjourney), маркетинговая активность, разработка самих генеративных моделей и всей экосистемы сопровождающего их ПО, выгоды за счёт автоматизации рутинных процессов по самым различным направлениям — и многое другое. Оценки аналитиков базируются на уже накопленном массиве реальных данных: к примеру, глубокая персонификация взаимодействия службы поддержки с пользователями за счёт применения генеративного ИИ (который оперативно поднимает и анализирует историю предыдущих коммуникаций с данным конкретным абонентом, суммируя её для оператора) повышает производительность труда на данном участке почти на 14%. Направлениями, которые получат основное преимущество от внедрения ИИ в обозримой перспективе, названы работа с клиентами, маркетинг и продажи, разработка ПО и НИОКР и в целом банковская и высокотехнологичная отрасли.

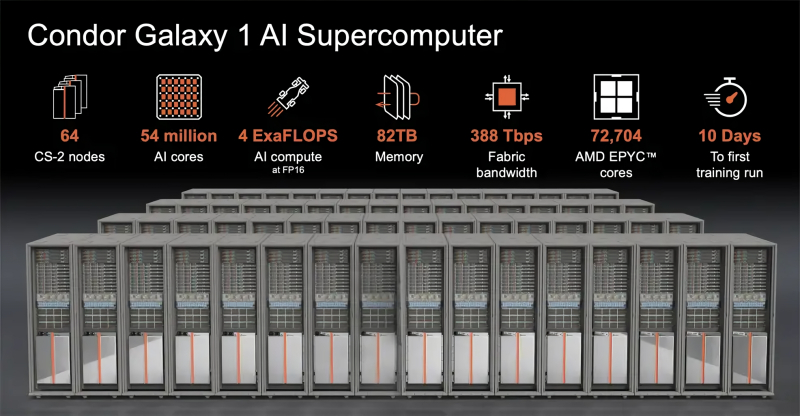

Схематический вид и общие характеристики суперкомпьютера Condor Galaxy в полной комплектации (источник: Cerebras Systems) ⇡#ИюльКондор покинул гнездо. Калифорнийская Cerebras Systems в сотрудничестве с ориентированной на ИИ и облака компанией G42 из ОАЭ представила Condor Galaxy — кластер из девяти суперкомпьютеров грядущей совокупной производительностью 36 Эфлопс, предназначенный для тренировки ИИ-моделей. На начальном этапе, до конца 2023 г., в строй планируется ввести лишь первый из заявленных суперкомпьютеров, CG-1 на 4 Эфлопс (FP16), располагающий 54 млн вычислительных ядер, 82 Тбайт оперативной памяти и внутренней шиной передачи данных в 388 Тбит/с. Это позволит эффективно тренировать большие языковые модели мощностью до 600 млрд параметров, тогда как по завершении развёртывания Condor Galaxy сможет справляться с обучением моделей, имеющих до 100 трлн параметров. Точка насыщения. Именно в июле 2023-го стало очевидно, что период первоначального бурного взлёта интереса к ChatGPT сменился этапом более спокойного и вдумчивого взаимодействия как с ним, так и с другими умными чат-ботами. Согласно опубликованным в этом месяце данным статистического портала SimilarWeb, число обращений к chat.openai.com впервые с ноября 2022-го снизилось в июне относительно майского пика примерно в 1,8 млрд. Впрочем, и число посещений других популярных чат-ботов в июне также сократилось относительно майского уровня — это свидетельствует скорее об общем ослаблении шумихи вокруг генеративного ИИ, чем об охлаждении пользователей именно к ChatGPT. Ботов много не бывает. Стартап Anthropic, в числе основателей которого — бывшие высокопоставленные сотрудники OpenAI, представил новую версию своего ИИ-бота для генерации текстов (как на естественных языках, так и на языках программирования), Claude 2. По итогам разнообразных тестов, включающих как вопросы из американского экзамена на право заниматься врачебной деятельностью, так и задания по написанию кода на Python, новый бот ожидаемо превзошёл своего прямого предшественника. Правда, искать информацию непосредственно в Интернете Claude 2 не способен, зато он обладает самым широким среди всех коммерчески доступных ныне чат-ботов контекстным окном в 100 тыс. токенов, что позволяет ему анализировать тексты объёмом примерно 75 тыс. слов (довольно увесистый том) и генерировать связные ответы протяжённостью более 3 тыс. слов.

Август Разглядеть, чтобы понять. Исследователи из Oak Ridge National Laboratory создали систему глубокого обучения AtomAI для анализа изображений, получаемых сканирующими зондовыми и электронными микроскопами, — с тем, чтобы точно идентифицировать попадающие в поле зрения этих приборов объекты микро- и наномира. Главный упор был сделан на быстрое выявление аномалий в атомной или молекулярной структуре образцов, что в ходе прикладных исследований обычно имеет первостепенное значение. Вооружённая AtomAI, прикладная микроскопия становится, по словам разработчиков системы, точной наукой, поскольку с высокой степенью достоверности автоматизирует чрезвычайно трудозатратную и требующую высочайшей квалификации работу биологических исследователей.

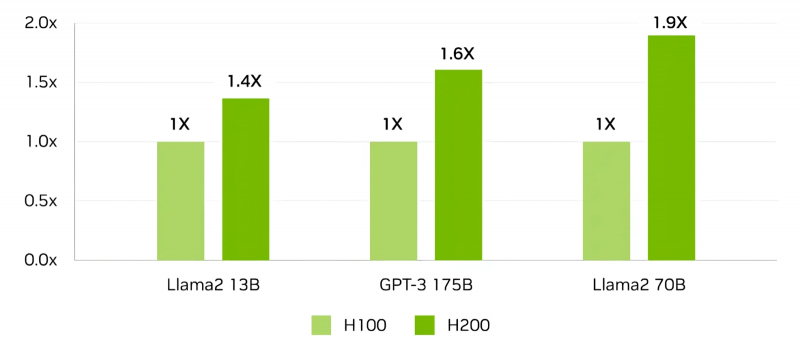

«Почему это я не творец, если за мои произведения готовы платить?» Пока ИИ не задаётся подобными вопросами, пользоваться плодами его трудов человечество может невозбранно (источник: ИИ-генерация на основе модели SDXL 1.0) Кто творец, ИИ творец?! Суд в Нью-Йорке постановил, что никакое произведение, созданное искусственным интеллектом без непосредственного участия человека, не может быть защищено авторским правом в рамках действующего в США законодательства. Интересно, что в данном случае речь шла не о тексте или изображении, а о неких технических изобретениях, созданных генеративной системой DABUS (Device for the Autonomous Bootstrapping of Unified Sentience), на которые создатель этой системы желал получить патенты. Истец, разумеется, подал апелляцию, — но как минимум в зоне действия британского права ИИ ещё долго придётся бороться за признание своих творений заслуживающими копирайта. ⇡#СентябрьСделайте погромче! В ассортименте ИИ-продуктов Stability AI, разработчика одного из известнейших средств для преобразования текста в статичные изображения — Stable Diffusion, появилась новинка: Stable Audio. Как очевидно уже из названия, это инструмент для генерации звуковых треков на основе текстовых подсказок. Модель Stable Audio содержит около 1,2 млрд параметров, и специально для неё была разработана детальная инструкция по корректному составлению подсказок. ⇡#ОктябрьМозг как источник чипмейкерского вдохновения. Исследовательское подразделение IBM Research представило в октябре нейроморфный чип NorthPole, превосходящий, по утверждению его создателей, по скорости обработки ряда ИИ-задач ныне доступные для заказа процессоры в 22 раза и к тому же куда более энергоэффективный. Архитектура его, как сообщается, «вдохновлена мозгом» (brain-inspired chip architecture) — в том смысле, что данные здесь не отделены от вычислений, и потому пропадает необходимость непрерывного информационного обмена между процессорными ядрами и ОЗУ — на который, собственно, тратится львиная доля времени и энергии в классических компьютерных архитектурах. Этот кремниевый чип площадью 800 кв. мм выполнен по технологической норме «12 нм» и содержит 22 млрд транзисторов, сгруппированных в 256 вычислительных ядер, — каждому из которых выделена особая область из 192 Мбайт внутренней памяти. На бенчмарке ResNet50 (демонстрирует производительность в ходе классификации нейросетью изображений) NorthPole, состязаясь с неназванным чипом классической архитектуры и сопоставимых производственных норм, показал в 25 раз бóльшую эффективность вычислений (FPS на Вт), впятеро лучший показатель FPS на один транзистор, в 22 раза сниженную латентность — и даже превзошёл по итоговому баллу «4-нм» NVIDIA H100 с его 80 млрд транзисторов. Одна только оговорка: NorthPole хорош для решения довольно специфического круга задач, прежде всего в системах машинного зрения, — и не годится для запуска и тем более тренировки больших языковых моделей. ⇡#НоябрьБот судейским не угроза. Против компании DoNotPay, что позиционирует свой сервис онлайновых консультаций по юридическим вопросам на основе генеративного ИИ как «первого в мире робота-адвоката», был подан иск со стороны юридической фирмы MillerKing из Иллинойса, — и как раз в ноябре старший окружной судья Нэнси Розенштенгель (Nancy Rosenstengel) из Восточного Сент-Луиса отказала истцу в удовлетворении жалобы. «Это дело стравливает живых адвокатов с роботом-адвокатом», — констатировала судья и постановила, что истцу не удалось убедительно показать, будто интересы биологических юристов каким бы то ни было образом оказались ущемлены из-за активности программного. Вдвое лучше H100 (ну почти). Официальный анонс NVIDIA H200, прямого наследника главной «рабочей лошадки» едва ни не всей современной ИИ-отрасли, H100, состоялся в середине ноября, однако первые партии этого ускорителя отправятся заказчикам (в их числе — Amazon Web Services, Google Cloud, Microsoft Azure, Oracle Cloud Infrastructure) лишь во II кв. 2024-го. «Двухсотка» сочетает проверенную архитектуру Hopper с новейшей скоростной оперативной памятью HBM3e объёмом 141 Гбайт и пропускной способностью 4,8 Тбайт/с (у H100 — 80 Гбайт и 3,35 Тбайт/с соответственно). Заявленный вендором прирост производительности относительно уровня H100 зависит от обрабатываемой модели: для LLaMA 2 с 13 млрд параметров — в 1,4 раза, тогда как для LLaMA 2 с 70 млрд параметров — в 1,9 раза (приведены показатели исполнения предварительно натренированной модели, не самой тренировки); и это при вдвое сниженном энергопотреблении. В составе 8-адаптерной конфигурации H200 должны обеспечить производительность на уровне 32 Пфлопс при вычислениях с точностью FP8 на задачах глубокого обучения.

Сравнение производительности H100 и H200 при исполнении (не в ходе тренировки!) наиболее распространённых генеративных ИИ-моделей (источник: NVIDIA) Размолвка, попытка переворота или недопонимание? Исполнительный директор OpenAI Сэм Альтман (Sam Altman) 17 ноября был отстранён от должности, а уже 22-го вновь взял бразды правления в свои руки. Тонкость в том, что по организационной структуре коммерческое подразделение OpenAI Global LLC с ограниченной прибыльностью (capped-profit unit) является «дочкой» некоммерческой структуры OpenAI Inc., зарегистрированной как неприбыльная исследовательская организация, и находится в доверительном управлении совета её директоров — функция которого заключается в том, чтобы сдерживать рвущихся за прибылью коммерсантов, напоминая им о потенциальных опасностях ИИ в полном соответствии с упоминавшимися в разделе «Март» Асиломарскими принципами. Именно этот совет решил, что Сэму Альтману «недостаёт откровенности» в коммуникациях, а заодно и «приверженности миссии OpenAI по развитию искусственного интеллекта на благо человечества». Возможно, увольнение и состоялось бы, — если бы не поднявшийся в Интернете страшный шум, сопровождаемый угрозами подавляющего большинства сотрудников OpenAI оставить организацию вслед за своим лидером; да и сама Microsoft, крупнейший инвестор в OpenAI, уже готова была взять Альтмана в собственную команду. В итоге уже 22 ноября Сэм Альтман вернулся на пост главы OpenAI Inc., что успокоило и воодушевило инвесторов: после известия об этом акции Microsoft взлетели на бирже до невиданных прежде высот. «А как же Асиломарские принципы?» — поинтересуется внимательный читатель, но ответа на этот вопрос в комментариях участников инцидента так и не отыщет. ⇡#ДекабрьСалемские роботы. Компания Agility Robotics, которая создала бипедального, двухманипуляторного и в целом человекоподобного робота Digit высотой 175 см и массой 63,5 кг, испытанного и признанного вполне эффективным инструментом для складских работ в Amazon, завершает в орегонском Салеме строительство RoboFab — фабрики по производству этих машин производительностью до 10 тыс. самоходных индустриальных роботов в год. До настоящего же момента — со времени своего основания в 2016-м — компания изготовила всего около сотни таких агрегатов. Открытие RoboFab запланировано на начало 2024 г., и она уже объявлена руководством Agility Robotics «первым на планете специализированным предприятием по выпуску гуманоидных роботов». В том же будущем году планируется начать поставки новеньких Digit избранным участникам партнёрской программы компании, а с 2025-го — приступить к широкому приёму заказов от всех желающих. К тому времени, однако, у изделий Agility Robotics может появиться уже немало серийно выпускаемых конкурентов — включая активно разрабатываемых сегодня роботов Optimus компании Tesla, Atlas за авторством Boston Dynamics, Phoenix бренда Sanctuary AI, Figure от одноимённого разработчика и Apptronik, создаваемый Apollo.

Человекоподобный Digit изучает фронт предстоящих работ на испытательной площадке Amazon (источник: Agility Robotics) Долгожданный ответ. Слившиеся в творческом экстазе ИИ-подразделения Google DeepMind и Google Brain наконец-то довели до стадии официального запуска целое семейство мультимодальных моделей, оперирующих одновременно с текстом, статичными изображениями, видео и программным кодом, — Gemini Ultra (наиболее сложная и способная), Pro (добротный промежуточный вариант) и Nano (оптимизирована для локального исполнения на не самом мощном «железе» — вплоть до мобильных устройств). На целом ряде специализированных бенчмарков Gemini Ultra опережает GPT-4, причём в случае многопараметрического бенчмарка MMLU (Massive Multitask Language Understanding) результат, показанный разработкой Google (90%), впервые в истории превзошёл достигнутый человеком (89,8%; предел GPT-4 здесь — 86,4%). Интересно, кстати, что на бенчмарке MATH (всевозможные математические задачки, от арифметики до алгебры и стереометрии) Gemini Ultra, также превзойдя GPT-4, всё-таки показала удручающе низкий результат: 53,2% у первой, 52,9% — у второй. А вот в испытании HellaSwag (подкреплённые здравым смыслом рассуждения на повседневные темы) модель Google, наоборот, отстала от разработки OpenAI — 87,8% против 95,3%. В настоящее время Gemini Pro и Nano уже доступны посредством чат-бота Bard в облаке и на ряде устройств, тогда как версия Ultra должна стать основой для платформы мультимодального ИИ-бота «Bard Advanced» в начале 2024 г. Ближе к концу 2023 года стали появляться указания на то, по какой именно причине в OpenAI произошла ноябрьская чехарда с участием Сэма Альтмана — и каким (если эти указания корректны) может оказаться магистральный путь развития ИИ в 2024-м. Речь идёт о таинственном проекте Q*, или Q-Star, который якобы разрабатывается в недрах компании под прямым руководством уволенного, а затем под давлением общественности и персонала принятого обратно коммерческого директора, — и который предполагает в самом скором времени ввод в строй того самого СИИ (AGI), появления которого опасаются подписанты мартовского открытого письма. Впрочем, стоит ли его опасаться? «Для меня, — говорил сам Альтман, — AGI — это эквивалент самого обычного среднего человека, которого вы можете нанять в качестве сотрудника». Действительно ли гипотетический СИИ сразу, как того страшатся алармисты, обретёт способности некоего мрачного гения и незамедлительно возжелает поработить, если не истребить человечество, — или же он при всех своих выдающихся (по сравнению с ныне действующими генеративными системами) способностях окажется не умнее, не предусмотрительнее и не способнее рядового Homo sapiens? Ведь, напомним, именно на эффективном усреднении наработанного людьми информационного материала и основывается бесспорное могущество ИИ-систем, — а такое усреднение будет, скорее, сглаживать всевозможные крайности, от чрезмерной любви к человечеству до безудержной к нему ненависти, а не усиливать их. Впрочем, 2024-й уже не за горами, — новый год явно обещает быть интересным!

Что произошло после того, как тайно разработанный в рамках проекта Q* СИИ провёл необходимые предварительные приготовления и нажал на кнопку? Мы не знаем; получить ещё какие-то изображения из будущего после этого момента не удалось (источник: ИИ-генерация на основе модели SDXL 1.0) [1] Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности». Если Вы заметили ошибку — выделите ее мышью и нажмите CTRL+ENTER.

|